M3 임베딩: 자기 지식 증류를 통한 다국어, 다기능, 다중 세분화 텍스트 임베딩

초록

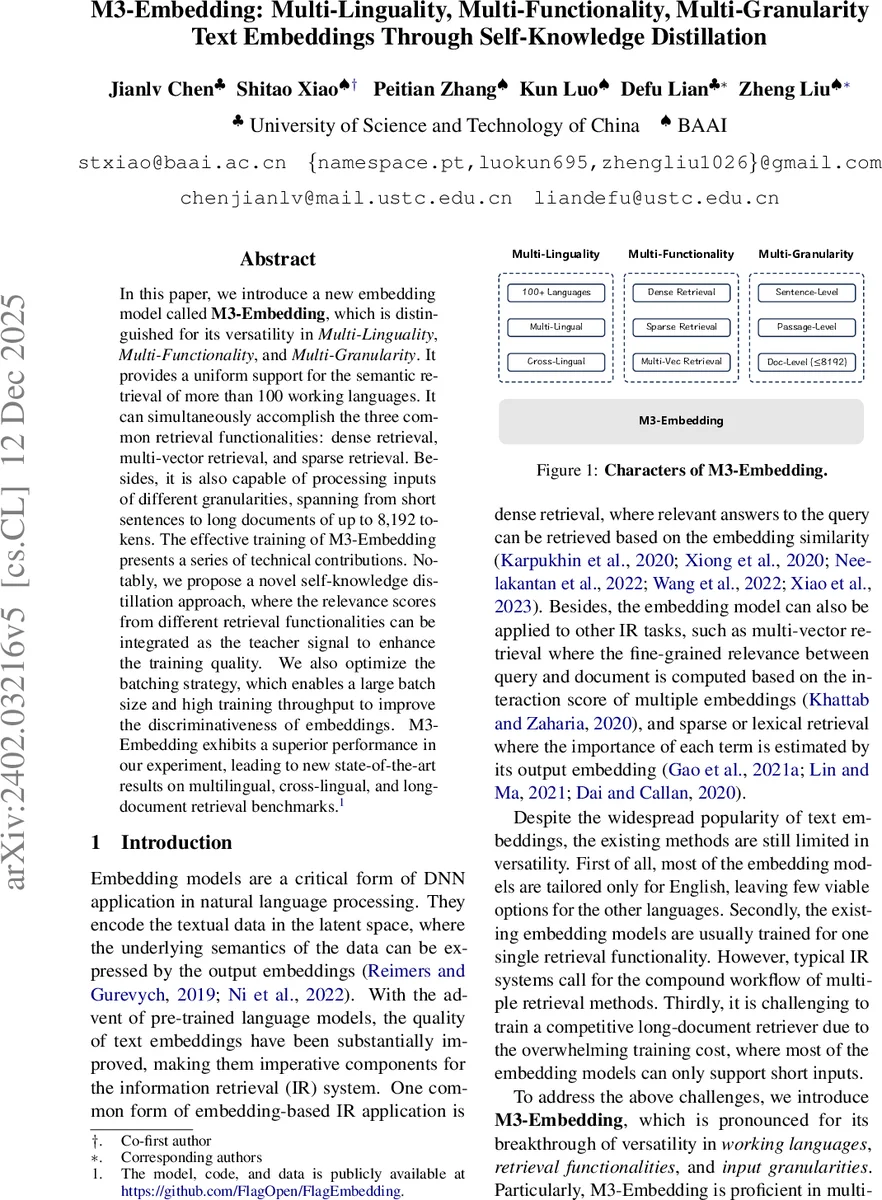

M3-Embedding은 다국어성, 다기능성, 다중 세분화를 통합한 획기적인 텍스트 임베딩 모델입니다. 100개 이상의 언어를 지원하며, 밀집 검색, 희소 검색, 다중 벡터 검색이라는 세 가지 검색 기능을 단일 모델에서 동시에 수행할 수 있습니다. 또한 짧은 문장부터 최대 8,192 토큰의 긴 문서까지 다양한 길이의 입력을 처리할 수 있습니다. 자기 지식 증류와 최적화된 배치 전략 등 기술적 혁신을 통해 학습되었으며, 다국어 및 장문서 검색 벤치마크에서 최첨단 성능을 달성했습니다.

상세 분석

M3-Embedding의 핵심 기술적 기여는 크게 세 가지로 요약됩니다.

첫째, 자기 지식 증류(Self-Knowledge Distillation) 프레임워크의 도입입니다. 기존의 다기능 임베딩 모델 학습에서 각 검색 기능(밀집, 희소, 다중 벡터)의 목표는 상호 충돌할 수 있어 최적화가 어려웠습니다. M3-Embedding은 이 문제를 앙상블 학습 원리에 기반하여 해결합니다. 세 가지 검색 방식으로부터 얻은 관련성 점수를 가중 합산하여 하나의 강력한 “교사 신호(teacher signal)“를 생성합니다. 이 통합 점수를 기준으로 각 개별 검색 기능의 출력을 지식 증류 방식으로 정제함으로써, 서로 다른 기능들이 상호 보완적으로 학습되도록 유도합니다. 이는 단순한 다중 작업 학습보다 효과적으로 다양한 기능의 성능을 동시에 향상시키는 핵심 메커니즘입니다.

둘째, 대규모 배치 학습을 위한 전략 최적화입니다. 고품질 임베딩을 학습하기 위해서는 배치 내에 많은 부정 샘플을 포함시켜 모델의 판별력을 높이는 것이 중요합니다. M3-Embedding은 배치 구성 방식을 최적화하여 매우 큰 배치 크기와 높은 학습 처리량을 달성했습니다. 이는 제한된 계산 자원 내에서 더 많은 네거티브 샘플을 노출시킬 수 있게 하여, 임베딩 공간에서의 세밀한 의미적 구분 능력을 크게 향상시킵니다.

셋째, 체계적이고 포괄적인 데이터 큐레이션입니다. 모델의 다재다능함을 뒷받침하기 위해 1) 대규모 다국어 코퍼스(위키백아, mC4 등)에서 제목-본문과 같은 비지도 데이터를 추출하고, 2) 영어, 중국어 및 기타 언어에 대한 다양한 지도 학습 데이터셋을 통합하며, 3) GPT-3.5를 활용해 장문서 검색을 위한 합성 데이터를 생성하는 3단계 데이터 구축 전략을 사용했습니다. 특히 장문서와 저자원 언어에 대한 데이터 부족 문제를 합성 데이터 생성으로 해결한 점이 주목할 만합니다. 이렇게 구축된 약 12억 쌍의 다국어 텍스트 데이터는 모델의 광범위한 일반화 능력의 기반이 되었습니다.

이러한 기술들은 XLM-RoBERTa 기반의 인코더를 초기화하고 RetroMAE 방식으로 추가 사전 학습한 후, 제안된 자기 지식 증류 프레임워크 하에 다기능 목표로 미세 조정되는 다단계 학습 파이프라인에서 구현되었습니다.

댓글 및 학술 토론

Loading comments...

의견 남기기