VeloDepth: 실시간 비디오 깊이 추정의 새로운 패러다임

초록

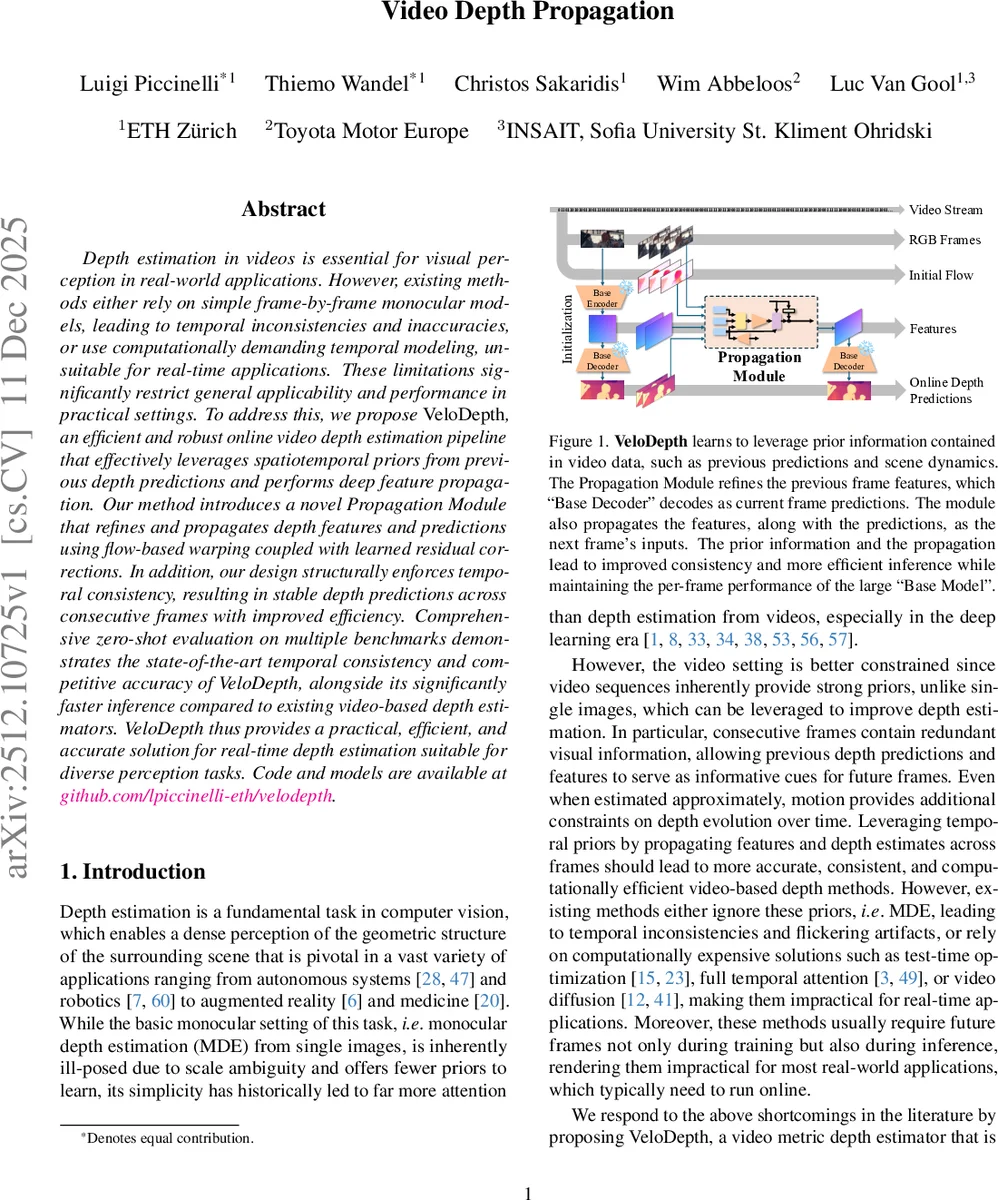

VeloDepth는 이전 프레임의 깊이 예측과 특징을 흐름 기반 워핑과 학습된 잔차 보정을 통해 전파하여, 시간적 일관성을 구조적으로 강화하는 효율적인 온라인 비디오 깊이 추정 파이프라인입니다. 제로샷 평가에서 최고 수준의 시간적 안정성과 경쟁력 있는 정확도를 보이며, 기존 비디오 기반 방법 대비 월등히 빠른 추론 속도를 자랑합니다.

상세 분석

VeloDepth의 핵심 기술적 기여는 ‘Propagation Module’의 설계에 있습니다. 이 모듈은 단순한 프레임별 독립 예측의 한계와 복잡한 전체 시퀀스 처리의 비효율성 사이에서 최적의 균형을 찾습니다. 구체적인 작동 원리는 다음과 같습니다.

-

다중 모달리티 융합 및 정제된 전파: 모듈은 현재 RGB 프레임, 이전 프레임의 깊이 맵, 그리고 두 프레임 간의 초기 광학 흐름을 입력으로 받습니다. 먼저, 가벼운 네트워크를 통해 초기 흐름을 정제(

O_t^{t-1})하여 저해상도 특징 공간에서의 워핑 정확도를 높입니다. 이 정제된 흐름을 사용해 이전 프레임의 깊이 특징(F_{t-1})과 깊이 예측값을 워핑합니다(PFW). 이 워핑된 정보는 현재 프레임에 대한 강력한 사전 정보(geometric prior) 역할을 합니다. -

게이트 메커니즘을 통한 상황 인식 보정: 단순 워피ng은 폐색 영역이나 흐름 오류에서 실패할 수 있습니다. VeloDepth는 이를 해결하기 위해 정교한 게이트 메커니즘을 도입합니다. RGB 특징(

F_I), 워핑된 깊이 특징(F_D^w), 흐름 특징(F_O)을 융합할 때, 흐름 특징에서 유도된 게이트(G_D)를 통해 신뢰할 수 없는 흐름 영역에서의 잘못된 깊이 정보 전파를 억제합니다. 최종적으로 생성된 보정 텐서(C)는 이전 프레임의 원본 특징(F_{t-1})과 연결(concatenation)된 후, 또 다른 흐름 기반 게이트(G_F)의 제어를 받으며 워핑된 특징에 잔차 형태로 더해집니다. 이 이중 게이트 구조는 모델로 하여금 “언제, 얼마나” 이전 정보를 신뢰하고 보정할지를 학습하게 만드는 핵심입니다. -

카메라 운동에 강인한 일관성 손실 함수: 기존 시간적 일관성 손실 함수는 카메라의 회전 및 병진 운동을 고려하지 않아 한계가 있었습니다. VeloDepth는 메트릭 방사 거리(radial distance)를 사용한 새로운 일관성 손실(

L_con)을 제안합니다. 이는 회전 운동에 불변(invariant)하며, 연속 프레임의 3D 점군 중앙값을 정렬하여 병진 운동을 보정합니다. 이로 인해 명시적인 카메라 외부 파라미터 없이도 강건한 시간적 일관성을 유도할 수 있습니다. -

효율성을 위한 키프레임 전략: 모델은 모든 프레임을 처음부터 예측하지 않습니다. 광학 흐름의 크기와 워핑 오차를 기반으로 한 휴리스틱을 사용해 장면 변화가 클 때만 키프레임으로 재초기화합니다. 장면이 정적일 경우 이전 예측을 재사용하여 계산 효율성을 극대화합니다.

이러한 설계는 큰 기반 모델(Base Model)의 단일 이미지 정확도를 유지하면서, 추론 시 추가되는 계산량을 최소화(Propagation Module은 가벼운 ConvNeXt-Tiny 기반)하고 시간적 안정성을 구조적으로 보장합니다. 결과적으로 VeloDepth는 실시간 적용 가능성(online)과 높은 정확도, 탁월한 일관성이라는 세 마리 토끼를 모두 잡은 실용적인 솔루션으로 평가받을 수 있습니다.

댓글 및 학술 토론

Loading comments...

의견 남기기