효율적인 비전 언어 내비게이션을 위한 훈련 부담 최소화 모델

초록

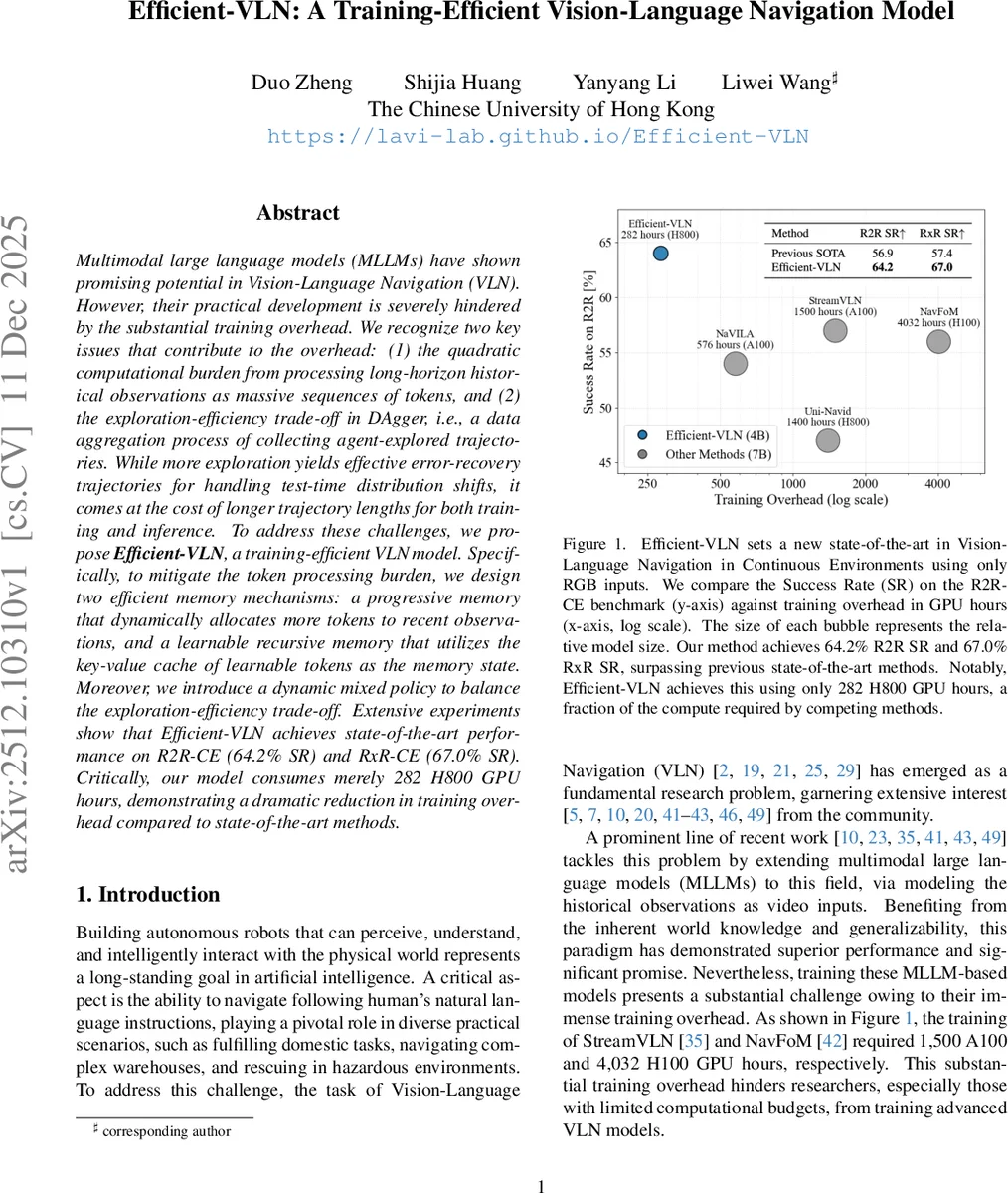

본 연구는 비전-언어 내비게이션(VLN)에서 멀티모달 대형 언어 모델(MLLM)의 실용화를 가로막는 방대한 훈련 오버헤드를 해결하는 Efficient-VLN 모델을 제안합니다. 긴 역사적 관찰을 처리하는 데 따른 계산 부담과 DAgger 데이터 수집 과정의 탐색-효율성 트레이드오프라는 두 가지 핵심 문제를 인식하고, 이를 위해 점진적 메모리, 학습 가능 재귀 메모리, 동적 혼합 정책을 도입했습니다. 그 결과, R2R-CE와 RxR-CE 벤치마크에서 최고 성능을 달성하면서도 기존 방법 대비 극적으로 적은 GPU 시간(282 H800 시간)만으로 훈련할 수 있음을 입증했습니다.

상세 분석

본 논문이 제안하는 Efficient-VLN의 기술적 핵심은 크게 두 가지로 요약됩니다: 효율적인 메모리 표현과 데이터 수집 전략의 최적화.

첫째, 메모리 표현의 효율화는 ‘점진적 메모리’와 ‘학습 가능 재귀 메모리’라는 두 가지 독창적인 메커니즘을 통해 이루어집니다. 점진적 메모리는 인간의 망각 메커니즘에서 착안하여, 시간적으로 가까운 관찰에는 많은 토큰을 할당하고 먼 관찰로 갈수록 공간적 압축 비율을 높여 토큰 수를 기하급수적으로 줄입니다. 이는 특히 RxR-CE와 같은 장기간 임무에서 효과적이었습니다. 학습 가능 재귀 메모리는 MLLM의 KV 캐시를 학습 가능한 토큰의 메모리 상태로 활용하는 새로운 접근법입니다. 고정된 크기의 메모리 상태를 단계별로 재귀적으로 업데이트하며, 출력 은닉 상태 대신 KV 캐시를 사용함으로써 깊은 모델에서의 장기간 그래디언트 전파 문제를 완화했습니다. 실험에서 이 방식은 짧은 궤적(R2R-CE)에서는 잘 작동했으나, 매우 긴 궤적에서는 한계를 보였습니다.

둘째, 데이터 수집 효율성을 높이기 위해 DAgger 알고리즘에 ‘동적 혼합 정책’을 도입했습니다. 기존의 고정 비율 혼합 정책은 오류 복구 데이터를 생성하지만 지나치게 긴 탐색 궤적을 초래했습니다. 제안된 정책은 학습 초기에는 학습 정책 비중을 높여 오류 누적을 유도하다가, 점차 오라클 정책 비중을 높여 임무를 완수하도록 설계되었습니다. 이를 통해 유의미한 오류 복구 데이터를 수집하면서도 불필요하게 긴 궤적 생성을 방지하여, 탐색 오버헤드를 56%나 줄이면서도 성공률을 높일 수 있었습니다.

또한, 모델의 공간 이해 능력을 강화하기 위해 2D 외관 특징에 3D 지오메트리 정보를 융합했습니다. 명시적 깊이 센서 없이 RGB 비디오에서 StreamVGGT와 같은 3D 지오메트리 인코더를 통해 기하학적 정보를 추출하여 주변 환경에 대한 보다 풍부한 표현을 가능하게 했습니다. 이 모든 개선 사항들은 Qwen2.5-VL 백본을 기반으로 구현되었으며, 종합적으로 볼 때 이 연구는 MLLM 기반 VLN의 실용적 배포를 위한 중요한 진전을 이루었습니다.

댓글 및 학술 토론

Loading comments...

의견 남기기