단일 영상으로부터 재조명 가능한 동적 가우시안 아바타 재구성

초록

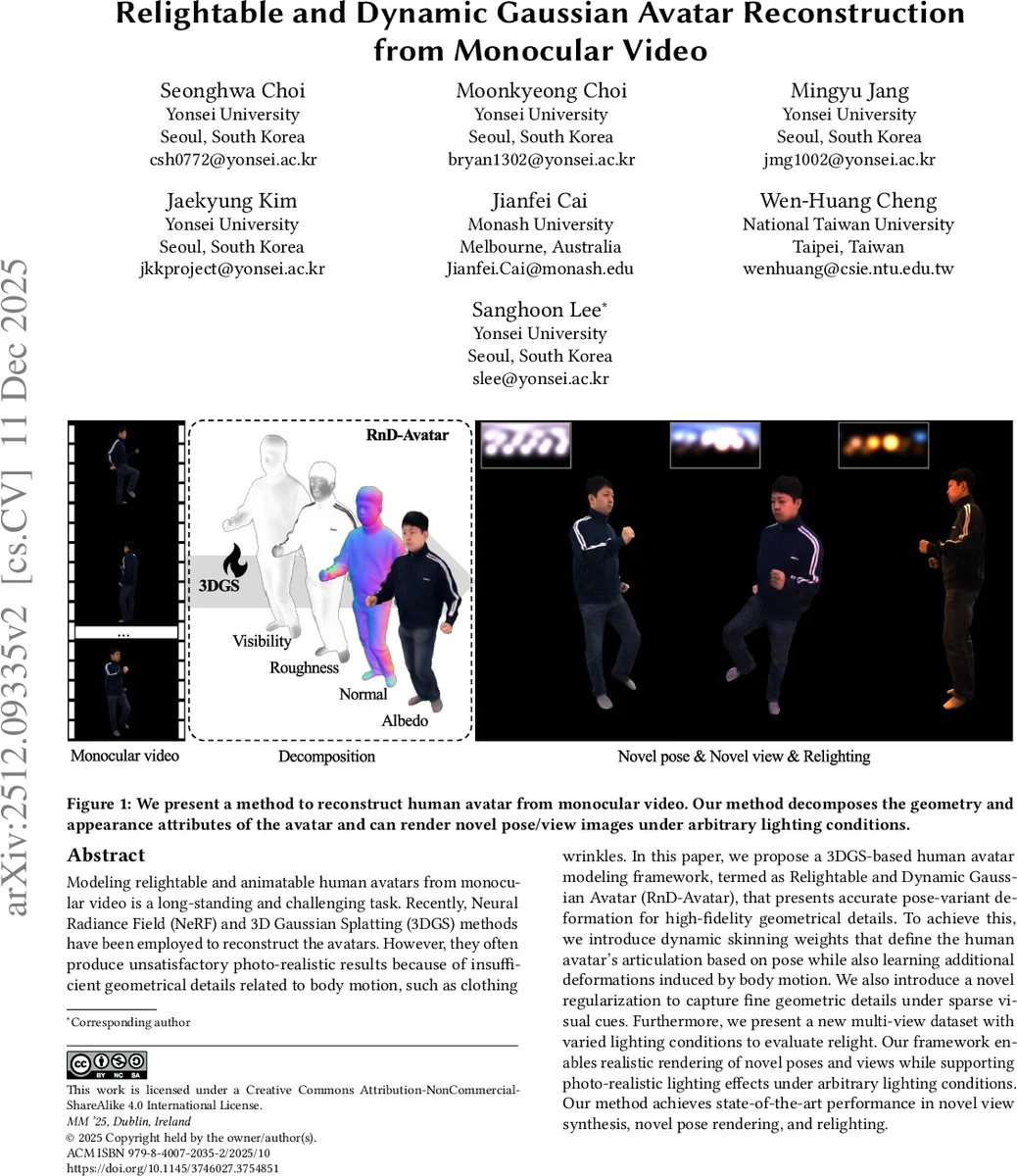

단일 카메라 영상으로부터 재조명과 애니메이션이 가능한 고품질 인간 아바타를 생성하는 새로운 프레임워크 ‘RnD-Avatar’를 제안한다. 기존 방법의 한계인 미세 기하학적 디테일 부족 문제를 해결하기 위해 포즈에 조건부인 동적 스키닝 가중치와 희소 시각 단서 하의 기하학 일관성을 위한 정규화 기법을 도입했다. 또한 다양한 조명 조건의 새로운 멀티뷰 데이터셋을 구축하여 정량적 평가를 가능하게 했으며, 새로운 포즈, 시점 합성 및 재조명 작업에서 최첨단 성능을 달성했다.

상세 분석

본 논문이 제안하는 RnD-Avatar의 기술적 핵심은 크게 두 가지로 요약된다: ‘동적 스키닝 가중치(Dynamic Skinning Weights)‘와 ‘기하학적 일관성 정규화(Geometric Consistency Regularization)‘이다.

첫째, 동적 스키닝 가중치는 기존 3DGS 기반 아바타 모델링의 근본적 한계를 해결한다. 기존 방법들은 정적 조건(예: 표준 공간에서의 가우시안 위치)에서 회귀된 고정된 스키닝 가중치를 사용하여 선형 블렌드 스키닝(LBS)을 적용했다. 이는 옷 주름과 같이 신체 움직임에 의해 유발되는 복잡한 포즈 종속 변형을 모델링하기 어렵게 만든다. RnD-Avatar는 포즈 시퀀스를 입력으로 받는 인코더 D_W를 설계하여, 시간적 주의 메커니즘으로 전역 운동 동역학을, 공간적 주의 메커니즘으로 국소 운동 동역학을 포착한다. 이를 통해 계산된 스키닝 가중치는 현재 몸의 동작에 적응적으로 변화하여, 보다 정확한 관절 가동과 함께 운동 유발 추가 변형까지 학습할 수 있다. 이는 단순한 관절 회전을 넘어서는 미세한 기하학적 디테일(예: 움직임에 따른 옷의 변형) 표현을 가능케 하는 핵심 기여점이다.

둘째, 단일 영상 학습의 고질적 문제인 희소한 시각 단서를 보완하기 위한 정규화 기법을 제안한다. 단일 시점에서는 깊이 정보와 같은 기하학적 단서가 제한되어, 특히 법선 벡터와 같은 깊이 관련 속성의 최적화가 불완전할 수 있다. 저자들은 두 렌더링 이미지의 특징 맵에서 교차 영역 내 특징 벡터를 샘플링하여, 양성 쌍(동일 지점) 간 유사성은 높이고 음성 쌍(다른 지점) 간 유사성은 낮추는 정규화 항을 도입한다. 이는 서로 다른 프레임에서 동일한 표면 점이 일관된 기하학적 특성을 가지도록 유도하여, 제한된 2D 관측으로부터 3D 기하학의 안정적인 학습을 촉진한다.

또한, 재조명 가능성을 위해 물리 기반 렌더링(PBR) 파이프라인을 통합했다. 가우시안의 속성을 기하학적(불투명도, 회전, 크기, 법선)과 외관적(알베도, 거칠기, SH 계수)으로 분리하고, Disney BRDF 모델과 학습 가능한 환경 맵 조명을 활용한다. 가시성(visibility)은 표준 공간에서의 위치와 법선을 기반으로 한 경량 MLP를 통해 뷰 종속적으로 모델링되어, 포즈 변화에 따른 그림자 효과를 처리한다. 두 단계(기하학 학습 → 외관 속성 학습)의 학습 전략은 모델이 먼저 안정적인 3D 구조를 학습한 후 외관과 조명 효과를 세밀하게 조정할 수 있게 한다.

마지막으로, 재조명 평가를 위한 데이터셋 부재라는 분야의 격차를 메우기 위해 다양한 색상 조명 조건 하의 멀티뷰 동영상 데이터셋을 새로 구축했다는 점도 중요한 공헌이다. 이를 통해 재조명 성능에 대한 정량적 비교 평가가 처음으로 가능해졌다.

댓글 및 학술 토론

Loading comments...

의견 남기기