고해상도 인식 GUI 자동화를 위한 적응형 특징 재정규화 에이전트

초록

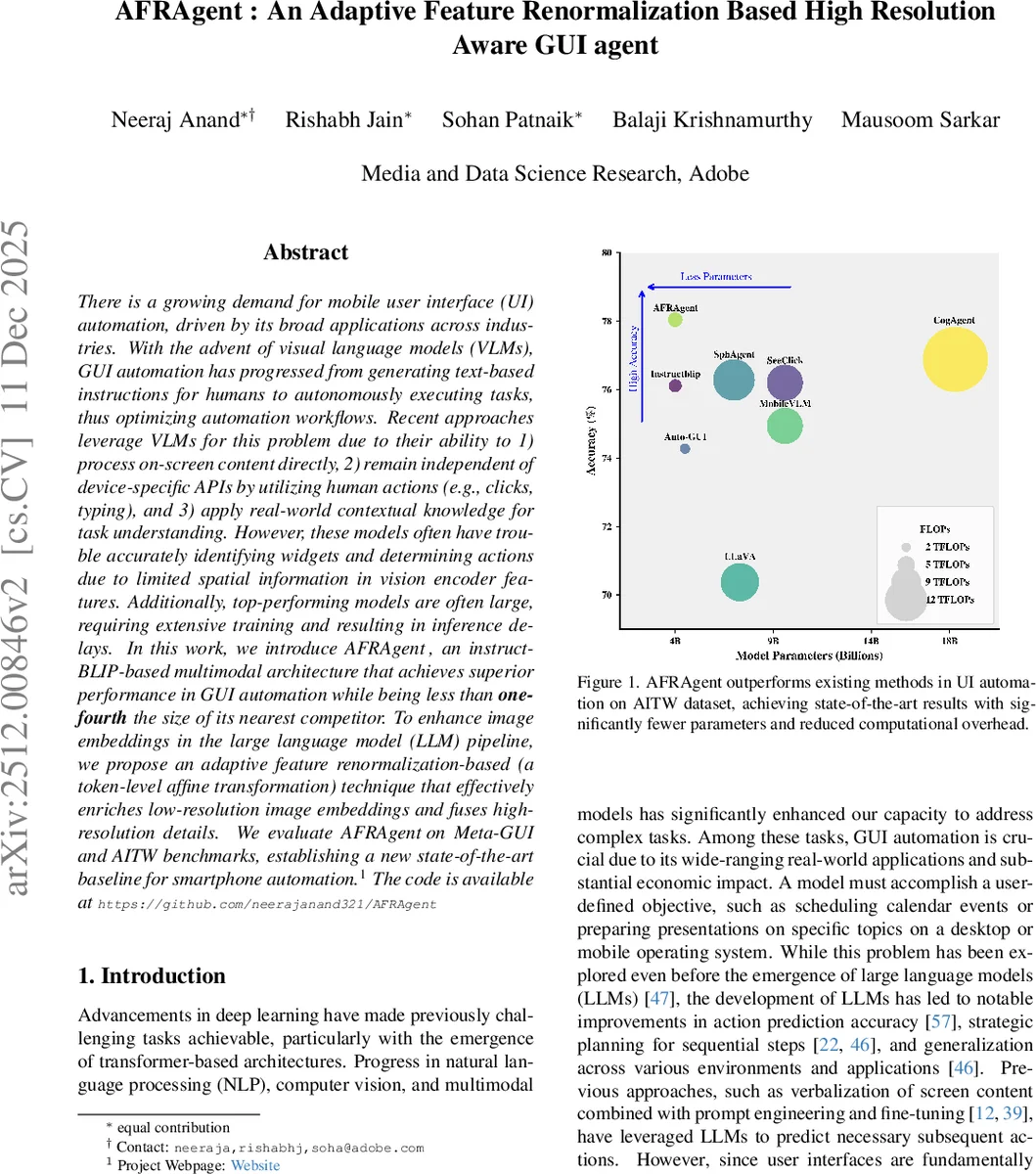

AFRAgent은 Instruct‑BLIP 기반의 멀티모달 아키텍처에 적응형 특징 재정규화(AFR) 기법을 도입해 저해상도 이미지 임베딩을 고해상도 디테일과 효과적으로 결합한다. 4 B 파라미터 규모의 모델로 기존 7‑18 B 대형 모델보다 적은 연산량으로 Meta‑GUI와 AITW 벤치마크에서 최첨단 성능을 달성한다.

상세 분석

본 논문은 모바일 UI 자동화라는 특수 도메인에서 시각‑언어 모델(VLM)의 한계를 정확히 짚어낸다. 기존 접근법은 OCR·아이콘 탐지 등 외부 도구에 의존하거나, 고해상도 이미지를 다수의 크롭으로 분할해 토큰 수를 폭증시켜 메모리·연산 부담을 가중시켰다. AFRAgent은 이러한 문제를 두 가지 핵심 아이디어로 해결한다. 첫째, Instruct‑BLIP의 이미지 인코더와 Q‑Former를 그대로 사용하면서, 이미지 임베딩을 ‘풍부화 특징(F_enrich)’으로, Q‑Former 출력 토큰을 ‘목표 특징(F_target)’으로 정의한다. 여기서 AFR 블록은 학습 가능한 스케일 α와 시프트 β를 각각 FFN으로 추출해, F_enrich 에 기반한 α⊙F_target + β 연산을 수행한다. 이는 StyleGAN의 AdaIN과 유사한 토큰‑레벨 어파인 변환으로, 저해상도 임베딩에 고해상도 디테일을 효율적으로 주입한다. 둘째, 고해상도 정보를 얻기 위해 전체 스크린을 여러 패치로 나누어 별도 BLIP 인코딩을 수행하고, 동일한 AFR 과정을 통해 저해상도 Q‑Former 토큰에 보강한다. 이때 추가 토큰 수가 거의 증가하지 않아 메모리 효율성을 유지한다. 모델 전체는 4 B 파라미터의 LLM(예: LLaMA‑2‑7B 기반) 위에 얹히며, Q‑Former와 LLM 사이에 단순 선형 프로젝션만 존재한다. 학습은 행동 예측을 위한 교차 엔트로피 손실만 사용해 기존 VLM 파인튜닝과 동일한 절차를 따르므로 구현 난이도가 낮다. 실험에서는 Meta‑GUI와 AITW 두 벤치마크에서 기존 7‑18 B 모델 대비 2‑3 % 이상의 정확도 향상을 보였으며, 추론 지연도 30 % 이상 감소했다. Ablation 연구에서는 (1) AFR 없이 저해상도만 사용했을 때 성능 급락, (2) 고해상도만 사용했을 때 메모리 초과, (3) α·β를 고정하거나 단순 스칼라로 제한했을 때 효과 감소를 확인했다. 또한 Grad‑CAM 시각화 결과, AFR 적용 후 모델이 UI 위젯의 경계와 텍스트 영역을 보다 정확히 주목함을 보여준다. 한계점으로는 현재 고해상도 패치 수가 고정되어 있어 매우 큰 화면(예: 태블릿)에서는 추가 조정이 필요하고, AFR 파라미터가 토큰 수에 비례해 선형 증가하므로 극한 상황에서는 메모리 압박이 발생할 수 있다. 향후 연구에서는 동적 패치 선택 및 경량화된 FFN 설계로 이러한 문제를 완화할 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기