온라인 클래스 증분 학습을 위한 균형 잡힌 이중 분류기 접근

초록

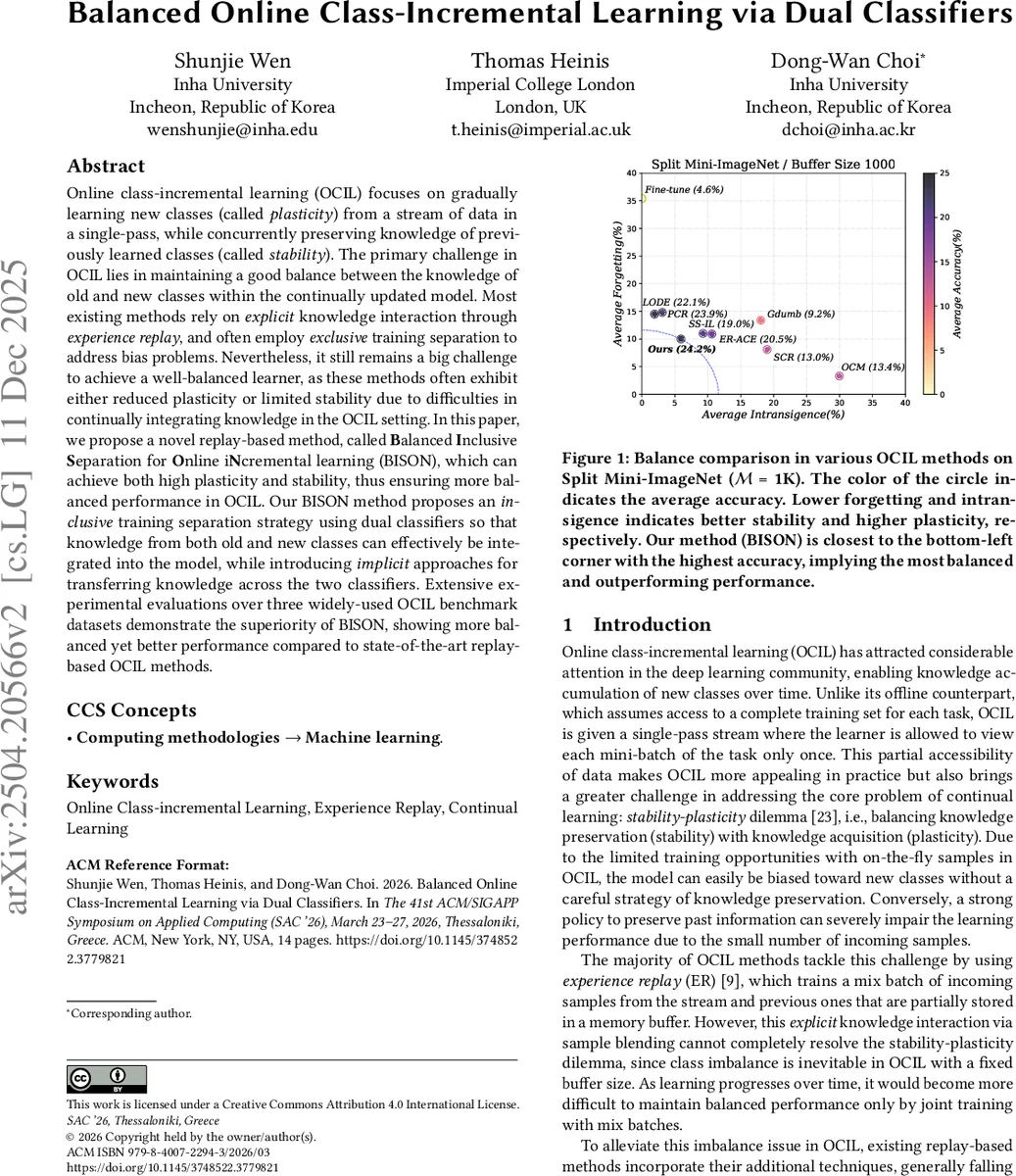

본 논문은 경험 재생 기반 온라인 클래스 증분 학습(OCIL)에서 플라스틱성과 안정성 사이의 균형을 맞추기 위해, 스트림 전용 분류기와 버퍼 전용 분류기로 구성된 이중 분류기 구조와, 프록시‑앵커 손실 및 프록시 정렬 피드백을 활용한 암시적 지식 교환 메커니즘을 제안한다. 제안 방법인 BISON은 기존의 배타적 학습 구분 방식의 한계를 극복하고, 새로운 클래스 학습과 기존 클래스 보존을 동시에 고효율로 수행한다. 세 가지 벤치마크 데이터셋에서 평균 정확도와 플라스틱·안정성 지표 모두에서 최신 방법들을 능가한다.

상세 분석

BISON은 온라인 클래스 증분 학습에서 가장 큰 난제인 ‘안정성‑플라스틱성 딜레마’를 해결하기 위해 두 가지 핵심 아이디어를 도입한다. 첫 번째는 모델 내부에 동일한 구조를 가진 두 개의 분류기(스트림 분류기와 버퍼 분류기)를 배치함으로써, 새로운 데이터와 버퍼에 저장된 과거 데이터를 각각 전용 파이프라인에서 처리하도록 설계한 ‘포괄적 학습 구분(inclusive separation)’이다. 이 구조는 기존 연구에서 사용된 단일 분류기에 서로 상충되는 손실을 적용하는 ‘배타적 구분(exclusive separation)’과 달리, 두 분류기가 동시에 모든 클래스에 대한 로짓을 출력하게 함으로써 클래스 간 관계 학습을 가능하게 한다. 특히 코사인 정규화 기반 로짓 계산을 사용해 클래스 간 스케일 차이를 완화하고, 학습 초기에 발생하기 쉬운 새로운 클래스 편향을 억제한다. 두 번째 핵심은 ‘암시적 지식 교환(implicit knowledge interaction)’ 메커니즘이다. 여기서는 기존 프록시‑앵커 손실(PAL)을 변형하여 스트림 분류기의 가중치를 학습 가능한 프록시로 취급함으로써, 피처 추출기가 과거 클래스의 프로토타입을 활용해 새로운 클래스 학습을 가속화한다(전방 전이). 반대로, 프로토타입 수준의 프록시 정렬 피드백(Alignment Feedback)을 도입해 스트림 분류기의 최신 프로토타입을 버퍼 분류기로 점진적으로 전달한다(후방 전이). 이 과정은 stop‑gradient 기법을 통해 버퍼 분류기의 파라미터가 직접 업데이트되지 않도록 하면서도, 두 분류기 사이에 지속적인 정보 흐름을 유지한다. 또한, 작업별 학습률을 조절하는 가변 파라미터 α를 도입해 스트림과 버퍼 손실 간의 비중을 동적으로 조정함으로써, 학습 단계마다 최적의 균형을 찾는다. 실험에서는 Split Mini‑ImageNet, Split CIFAR‑100, 그리고 Split Tiny‑ImageNet 세 데이터셋에 대해 버퍼 크기 1K를 고정하고, 평균 정확도, 평균 망각(forgetting) 및 평균 저항(intransigence) 지표를 측정했다. BISON은 기존 대표적인 방법들(ER, SCR, SS‑IL, OCM 등)보다 전체 정확도에서 1‑2%p 향상을 보였으며, 특히 망각과 저항을 동시에 최소화해 ‘좌하단 코너’에 가장 가깝게 위치함을 시각화하였다. 이는 이중 분류기와 프록시 기반 교환 메커니즘이 새로운 클래스 학습을 방해하지 않으면서도 과거 지식을 효과적으로 보존한다는 것을 의미한다. 전체적으로 BISON은 경험 재생 기반 OCIL에서 플라스틱성과 안정성을 동시에 극대화하는 새로운 패러다임을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기