사진과 동작 설명으로 환경 맞춤형 mmWave 신호를 생성하는 mmWEAVER

초록

**

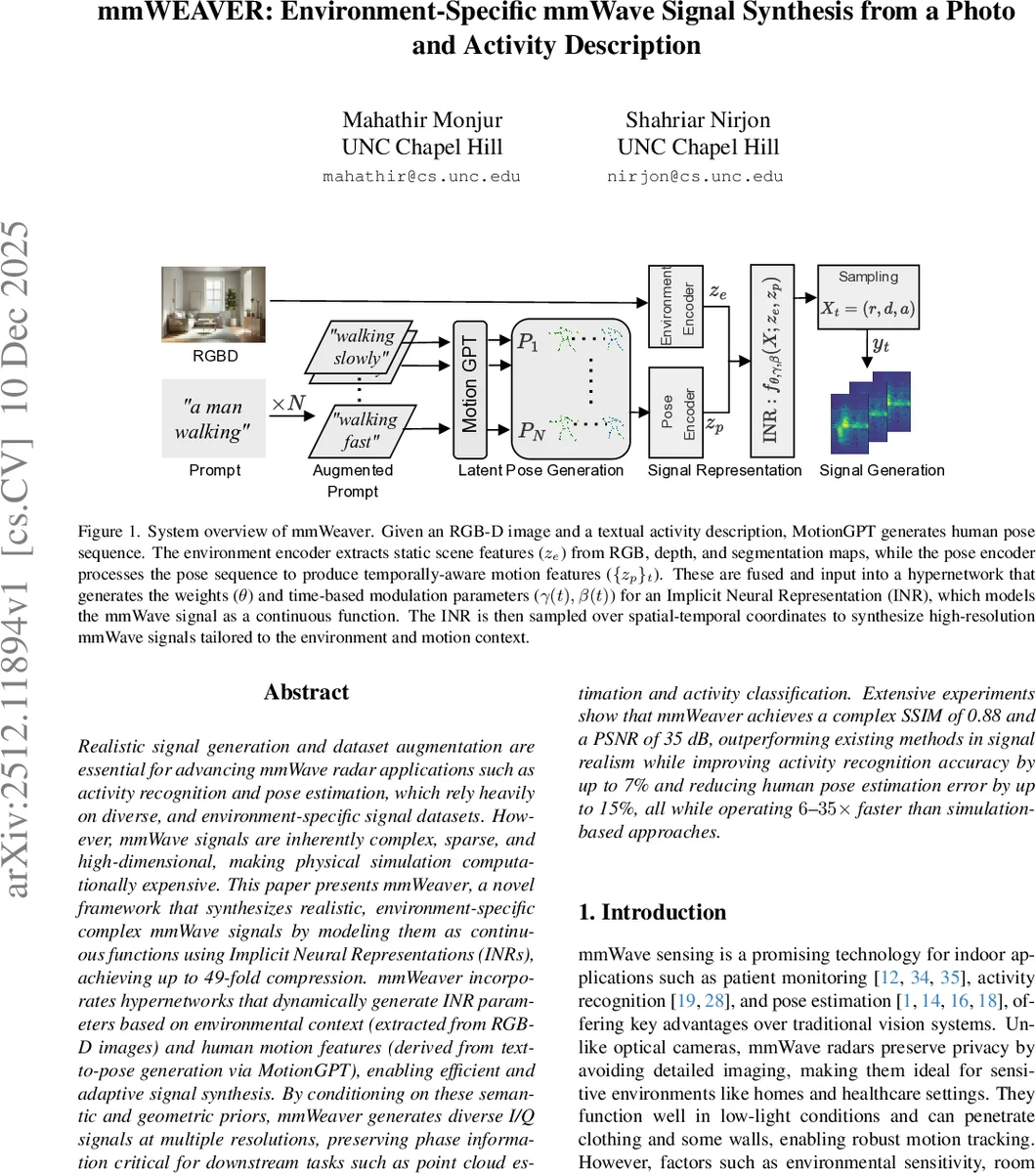

mmWEAVER는 RGB‑D 사진과 텍스트 활동 설명을 입력으로 받아, 환경 특성을 추출하고 MotionGPT가 만든 3D 포즈 시퀀스를 결합해 하이퍼네트워크가 INR 파라미터를 동적으로 생성한다. 이를 통해 복소수 I/Q 신호를 연속 함수 형태로 압축(최대 49배)하고, 다중 해상도로 샘플링해 실제 mmWave 레이더 데이터와 거의 구분이 안 될 정도의 품질(SSIM 0.88, PSNR 35 dB)을 제공한다. 합성 데이터는 활동 인식 정확도를 7 %까지, 포즈 추정 오류를 15 %까지 감소시키며, 전통적인 레이더 시뮬레이션보다 6‑35배 빠르게 동작한다.

**

상세 분석

**

mmWEAVER는 세 가지 핵심 기술을 결합해 기존 mmWave 신호 합성의 한계를 뛰어넘는다. 첫째, Implicit Neural Representation(INR)을 이용해 복소수 I/Q 데이터를 연속 함수로 모델링함으로써 저장 공간을 크게 절감하고, 좌표 기반 샘플링을 통해 해상도 자유도를 확보한다. 기존의 프레임‑별 INR 방식은 시간‑공간을 동시에 학습해야 하는 비효율성을 갖는데, 저자는 시간 모듈레이션 네트워크(γ(t), β(t))를 도입해 시간 정보를 별도 파라미터로 처리함으로써 파라미터 재사용성을 높이고, 8개의 푸리에 주파수를 사용한 Positional Encoding으로 고주파·저주파 성분을 모두 포착한다.

둘째, 하이퍼네트워크를 통해 환경 인코더와 포즈 인코더에서 추출된 512‑차원 특징(z_e)과 시계열 포즈 특징(z_p)을 결합한다. 환경 인코더는 EfficientNet‑B0 기반 CNN으로 RGB, 깊이, 객체 마스크를 동시에 처리해 실내 구조·재질 정보를 압축하고, 포즈 인코더는 3D 포즈 시퀀스를 두 단계 트랜스포머(공간·시간 어텐션)로 변환해 동적 움직임을 고차원 표현으로 만든다. 하이퍼네트워크는 이 결합 특징을 MLP에 입력해 INR 가중치 θ와 시간 모듈레이션 파라미터를 실시간으로 생성한다. 따라서 새로운 방이나 새로운 동작 프롬프트가 주어져도 별도 INR 재학습 없이 즉시 신호를 합성할 수 있다.

셋째, 데이터 생성 파이프라인에 MotionGPT를 활용한다. 텍스트 프롬프트(예: “walking slowly”)를 입력하면 고품질 3D 포즈 시퀀스를 자동으로 생성하고, 이를 포즈 인코더에 전달한다. 이렇게 하면 인간 동작 다양성을 크게 확대할 수 있어, 기존 데이터셋에 존재하지 않던 복합 동작·속도 변화를 손쉽게 합성한다.

실험 결과는 네 가지 관점에서 설득력을 제공한다. 신호 품질 측면에서 복소수 SSIM 0.88, PSNR 35 dB는 기존 RF‑Genesis(SSIM ~0.80)보다 현저히 우수하며, 압축률 49배는 저장·전송 비용을 크게 낮춘다. 다운스트림 작업인 활동 인식에서는 합성 데이터를 기존 데이터와 혼합했을 때 정확도가 최대 7 % 상승했고, 포즈 추정에서는 MPJPE가 15 % 감소했다. 특히 공개 HuPR 데이터셋에 적용했을 때도 10 % 수준의 성능 향상이 관찰되었다. 시간 효율성도 강조되는데, 평균 3.4 초(단일 활동)로 레이더 시뮬레이션(20 s‑2 min)보다 6‑35배 빠르게 신호를 생성한다.

한계점으로는 현재 환경 인코더가 정적인 RGB‑D 이미지에 의존한다는 점이다. 움직이는 물체나 조명 변화가 큰 환경에서는 추가적인 시계열 비전 모듈이 필요할 수 있다. 또한 하이퍼네트워크가 생성하는 INR 파라미터의 규모가 6‑7 M 정도로, 초경량 임베디드 디바이스에 직접 탑재하기엔 아직 부담이 있다. 향후 연구에서는 경량화된 하이퍼네트워크와 온라인 환경 업데이트 메커니즘을 도입해 실시간 적응성을 높이는 방향이 기대된다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기