다이나믹 이미지 프롬프트 어댑터, 제로샷 개인화 이미지 생성의 새로운 지평

초록

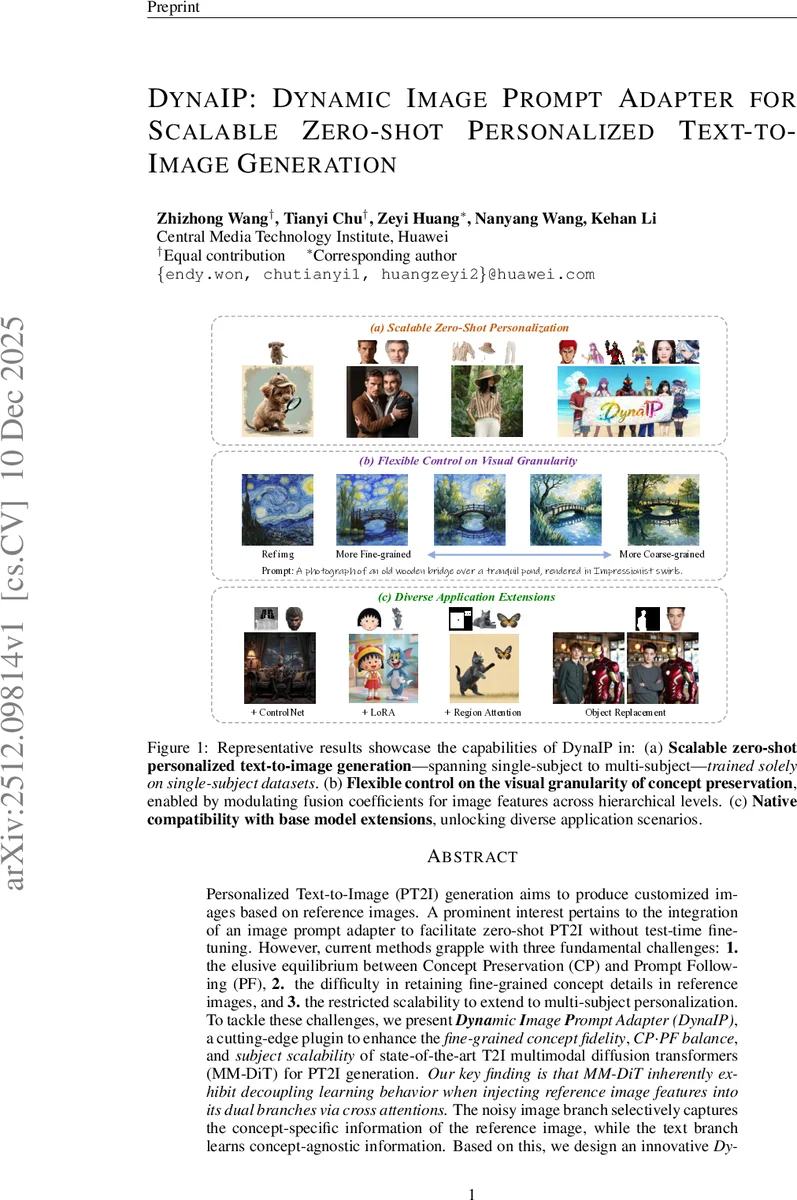

본 연구는 참조 이미지를 기반으로 맞춤형 이미지를 생성하는 제로샷 개인화 텍스트-이미지 생성(PT2I)의 핵심 과제인 개념 보존과 프롬프트 준수 간의 균형, 세부 정보 유지, 다중 주체 확장 문제를 해결하는 DynaIP를 제안합니다. MM-DiT 아키텍처의 고유한 디커플링 학습 특성을 활용한 동적 디커플링 전략과 CLIP의 계층적 특징을 활용한 혼합 전문가 특징 융합 모듈을 통해 기존 방법을 능가하는 성능과 확장성을 입증했습니다.

상세 분석

본 논문의 기술적 핵심은 두 가지 주요 혁신에 기반합니다. 첫째, MM-DiT(Multimodal Diffusion Transformer) 아키텍처 내에서 발견된 ‘디커플링 학습 행동’을 적극적으로 활용합니다. 저자들은 참조 이미지 특징을 MM-DiT의 이중 브랜치(노이즈 이미지 브랜치와 텍스트 브랜치)에 주입할 때, 노이즈 이미지 브랜치는 참조 대상의 ID, 모양, 질감 등 개념-특정 정보를 선택적으로 학습하는 반면, 텍스트 브랜치는 자세, 시점, 조명 등 개념-무관 정보를 학습한다는 것을 발견했습니다. 이 통찰을 바탕으로 설계된 ‘동적 디커플링 전략(Dynamic Decoupling Strategy)‘은 학습 시에는 두 브랜치 모두에 참조 특징을 주입하지만, 추론 시에는 오직 노이즈 이미지 브랜치와만 상호작용하도록 합니다. 이를 통해 생성 과정에서 개념-무관 정보의 간섭을 동적으로 제거함으로써, 기존 방법이 겪었던 개념 보존(CP)과 프롬프트 준수(PF) 간의 Trade-off를 극복하고, 다중 주체 구성 시 발생하는 시각적 통합 불일치 문제도 크게 완화합니다.

둘째, 세부 개념 충실도 향상을 위한 ‘계층적 혼합 전문가 특징 융합 모듈(Hierarchical Mixture-of-Experts Feature Fusion Module, HMoE-FFM)‘을 제안합니다. 기존 방법이 CLIP 인코더의 최종층 등 고수준 특징만 사용해 세부 정보가 유실되는 문제를 지적하며, CLIP의 얕은층, 중간층, 깊은층 특징이 각각 다른 수준의 세부성(예: 질감/윤곽, 형태, 의미 정보)을 담고 있음을 실험적으로 증명합니다. HMoE-FFM은 각 계층의 특징을 처리하는 전용 전문가 네트워크와, 입력 참조 이미지에 따라 이들의 융합 가중치를 동적으로 결정하는 라우팅 메커니즘으로 구성됩니다. 이는 단순한 특징 연결(Concatenation)보다 우수한 성능을 보이며, 사용자가 융합 계수를 조정하여 보존할 세부 정보의 수준(예: 매우 정교한 질감 vs. 대략적인 형태)을 유연하게 제어할 수 있는 기능도 제공합니다. 이 두 기법이 결합된 DynaIP는 단일 주체 및 다중 주체 PT2I 작업에서 기존 SOTA 어댑터 방법들을 큰 폭으로 능가하는 성능을 보여주며, 추가적인 다중 주체 데이터셋 학습 없이도 우수한 확장성을 입증했습니다.

댓글 및 학술 토론

Loading comments...

의견 남기기