다양한 형태 제어를 위한 지식 전환 기반 모듈형 트랜스포머

초록

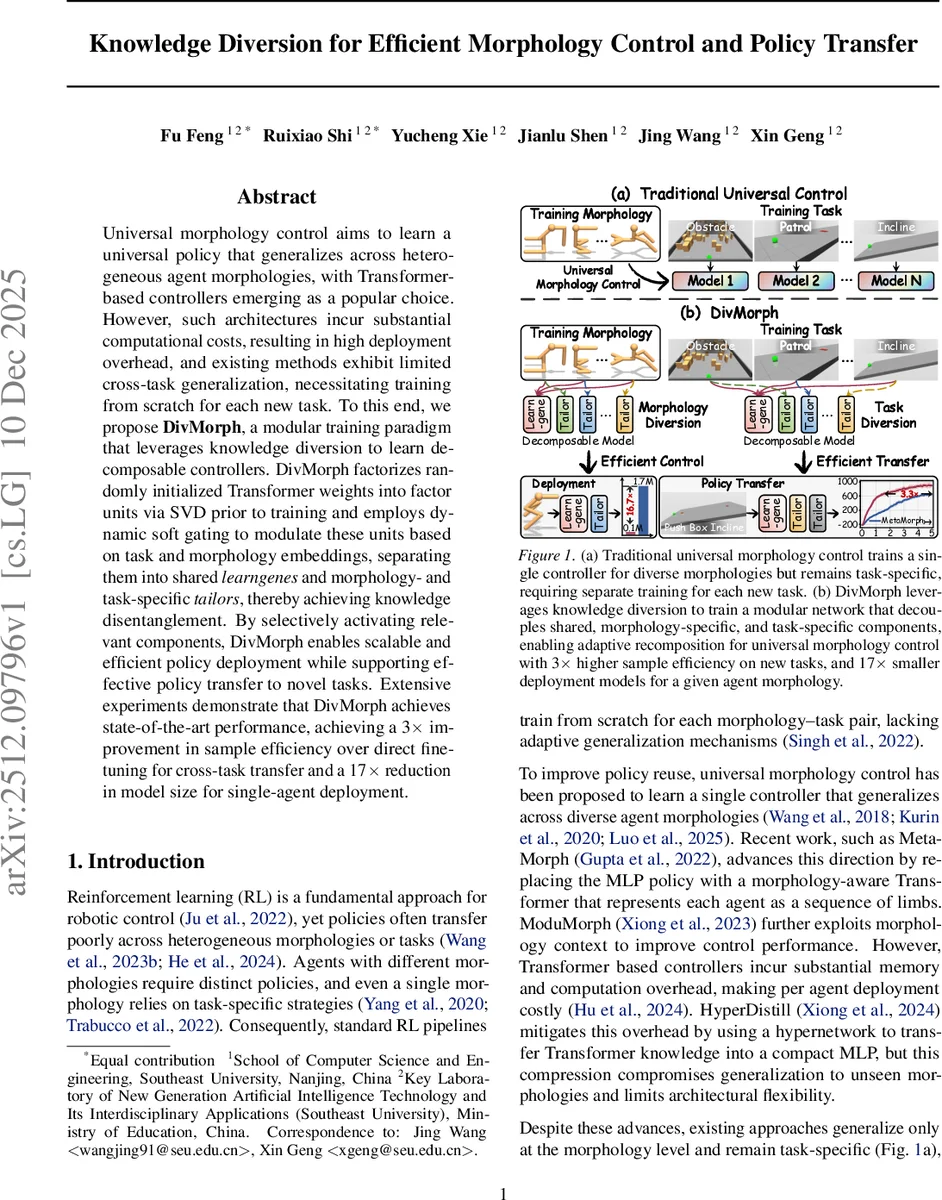

DivMorph는 무작위 초기화된 트랜스포머 가중치를 SVD로 분해한 뒤, 작업·형태 임베딩에 따라 동적 소프트 게이팅을 적용해 공유 ‘학습유전자(learngenes)’와 형태·작업 특화 ‘테일러(tailors)’를 구분한다. 이를 통해 모델 크기를 17배 축소하고, 새로운 작업에 대한 샘플 효율성을 3배 향상시키며, 기존 방식의 높은 연산 비용과 작업별 재학습 문제를 해결한다.

상세 분석

DivMorph는 기존의 범용 형태 제어에서 트랜스포머 기반 정책이 높은 연산 비용과 작업‑특화 재학습 필요성이라는 두 가지 근본적인 한계를 지적한다. 이를 극복하기 위해 제안된 핵심 아이디어는 ‘지식 전환(knowledge diversion)’이다. 구체적으로, 무작위 초기화된 트랜스포머 가중치를 Singular Value Decomposition(SVD)으로 분해해 다수의 ‘팩터 유닛(factor units)’을 만든다. 각 유닛은 선형 변환 공간에서 독립적인 차원을 담당하며, 이후 학습 과정에서 동적 소프트 게이팅(dynamic soft gating) 메커니즘을 통해 활성화된다. 게이팅은 두 종류의 임베딩—형태(morphology)와 작업(task)—을 입력받아, 해당 임베딩에 가장 적합한 유닛 집합을 선택한다.

이 과정에서 공유 파라미터는 ‘학습유전자(learngenes)’라 명명되며, 모든 형태와 작업에 공통적으로 사용된다. 반면, 특정 형태·작업에만 활성화되는 파라미터는 ‘테일러(tailors)’라 부른다. 이렇게 명확히 구분된 파라미터는 지식의 ‘분리(disentanglement)’를 가능하게 하며, 새로운 형태나 작업이 등장했을 때 기존 learngenes를 재사용하고, 필요한 tailor만 추가·조정하면 된다. 결과적으로 파라미터 재사용률이 크게 상승하고, 전체 모델 크기가 17배 감소한다는 실험적 증거를 제공한다.

학습 단계에서는 기존 트랜스포머와 동일한 RL 목표(예: PPO, SAC 등)를 사용하지만, 파라미터 업데이트가 두 서브셋(learngenes, tailors)으로 나뉘어 각각의 손실에 따라 독립적으로 최적화된다. 이는 gradient 흐름을 제어해 과도한 공유로 인한 성능 저하를 방지하고, 동시에 tailors가 특정 작업·형태에 맞춰 빠르게 적응하도록 만든다.

전이 학습 측면에서는, 새로운 작업에 대해 직접 fine‑tuning을 수행할 경우와 비교해 3배 이상의 샘플 효율성을 달성한다. 이는 기존 방법이 전체 모델을 재학습해야 하는 반면, DivMorph는 기존 learngenes를 고정하고 필요한 tailors만 학습하기 때문이다. 또한, 다양한 복합 형태(예: 다리 로봇, 팔 로봇 등)와 복수 작업(예: 장애물 회피, 물체 조작, 경사면 탐색)에서 일관된 성능 향상을 보이며, 복잡한 멀티태스크 환경에서도 정책 간 충돌 없이 안정적인 학습이 가능함을 실험으로 입증한다.

또한, 모델 압축 측면에서 SVD 기반 팩터 유닛은 저차원 근사로서 원본 트랜스포머의 표현력을 크게 손상시키지 않으며, 실제 배포 시 연산량과 메모리 사용량을 크게 낮춘다. 이는 로봇 현장 적용 시 실시간 제어와 전력 제한을 고려한 중요한 장점이다.

요약하면, DivMorph는 (1) 트랜스포머 가중치의 사전 분해를 통한 모듈화, (2) 형태·작업 임베딩 기반 동적 게이팅, (3) 공유와 특화 파라미터의 명확한 구분이라는 세 가지 혁신적인 메커니즘을 결합해, 범용 형태 제어의 효율성, 확장성, 그리고 전이 학습 능력을 크게 향상시킨다.

댓글 및 학술 토론

Loading comments...

의견 남기기