신경망의 숨겨진 질서: 매개변수 공간 대칭성의 비밀

초록

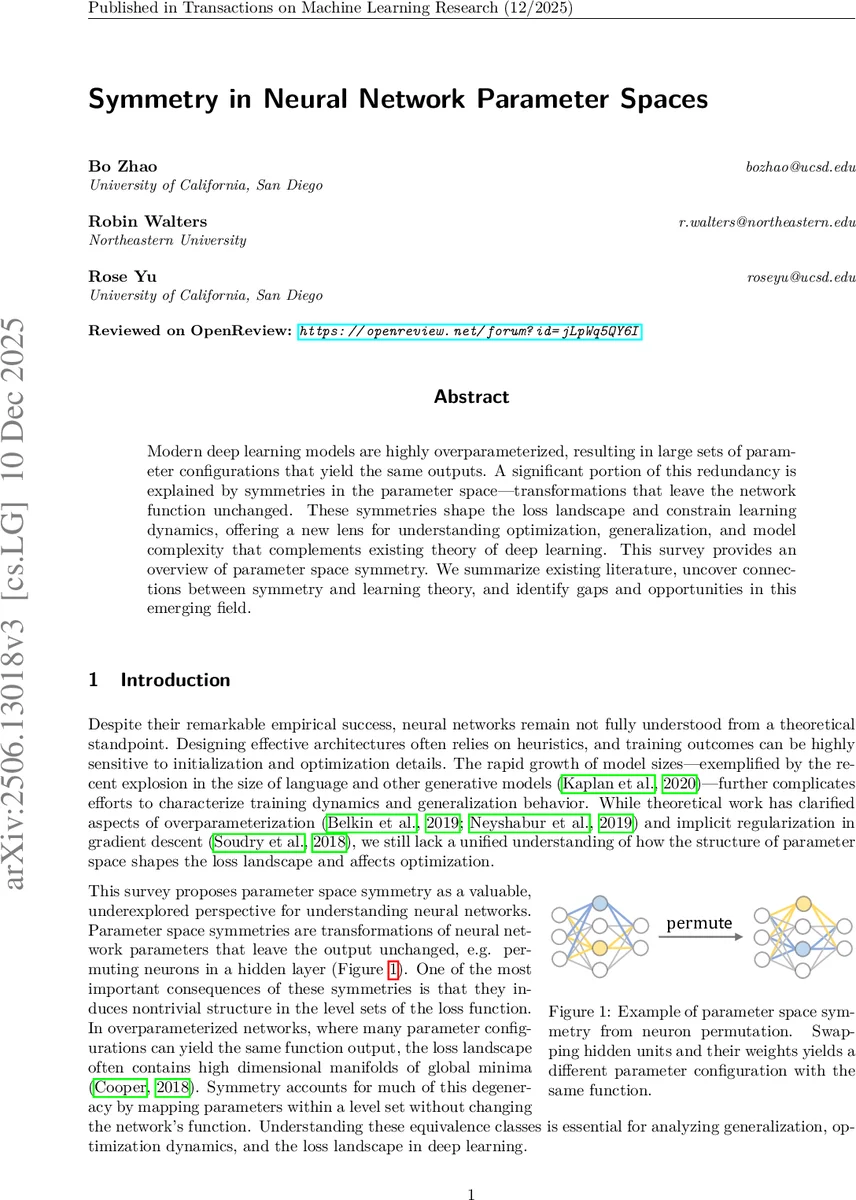

현대 과매개변수화된 딥러닝 모델에서, 서로 다른 매개변수 설정이 동일한 함수를 만들어내는 현상은 매개변수 공간의 대칭성으로 설명된다. 이 대칭성은 손실 지형을 형성하고 학습 동역학을 제약하며, 최적화와 일반화 이론을 이해하는 새로운 틀을 제공한다. 본 논문은 이러한 매개변수 공간 대칭성의 정의, 예시, 이론적 및 알고리즘적 함의를 종합적으로 조명한다.

상세 분석

이 논문은 딥러닝 이론에서 상대적으로 덜 조명받아 온 ‘매개변수 공간 대칭성’을 체계적으로 정리한 중요한 조사 연구이다. 핵심 통찰은 다음과 같다.

첫째, 대칭성을 군론의 프레임워크로 엄밀히 정의함으로써, 다양한 신경망 구성요소에서 나타나는 변환(예: 뉴런 치환, 스케일링, 회전)을 통합적으로 설명할 수 있는 수학적 기반을 마련했다. 이는 활성화 함수의 등변성이나 불변성 속성이 어떻게 매개변수 변환으로 이어지는지를 명확히 보여준다.

둘째, 대칭성이 야기하는 ‘매개변수 중복성’이 단순한 이론적 호기심을 넘어 실질적인 의미를 가짐을 강조한다. 동일한 함수에 매핑되는 매개변수들의 집합(준위 집합)은 고차원 다양체를 형성하며, 이는 손실 함수의 지형을 근본적으로 변화시킨다. 특히 글로벌 최솟값이 고립된 점이 아닌 연결된 공간으로 존재하게 만든다. 이는 모드 연결성이나 평면화된 최솟값 영역과 같은 현상을 이해하는 데 기여한다.

셋째, 대칭성에서 유도되는 ‘보존량’의 개념을 제시하며, 이가 그래디언트 흐름 하의 학습 동역학에 제약을 가함을 논의한다. 이는 신경망의 학습 궤적이 임의적이지 않고, 대칭성에 의해 결정된 특정 패턴을 따를 수 있음을 시사하며, 학습 과정의 예측 가능성과 해석 가능성을 높일 수 있는 잠재력을 보여준다.

넷째, 대칭성 인식을 통한 알고리즘적 개선 가능성을 제시한다. 예를 들어, 모델 평균화 시 대칭성에 따른 동등 클래스를 고려하거나, 베이지안 추론에서 대칭성-인식 샘플링을 수행함으로써 효율성과 정확성을 높일 수 있다. 이는 순수 이론을 넘어 실용적인 도구 개발로 이어질 수 있는 방향을 제시한다.

종합하면, 이 논문은 매개변수 공간 대칭성이 신경망의 표현력, 최적화 행동, 일반화 성능을 깊이 있게 통제하는 핵심 구조적 원리임을 설득력 있게 논증한다. 기하학적 딥러닝이 데이터 공간의 대칭성에 주목했다면, 이 연구는 ‘모델 자체의 내재적 대칭성’에 초점을 맞춤으로써 딥러닝 이론의 지평을 확장한다는 점에서 의미가 크다.

댓글 및 학술 토론

Loading comments...

의견 남기기