보이스클록: 확산 기반 음성 클로닝 방어를 위한 다중 차원 보호 프레임워크

초록

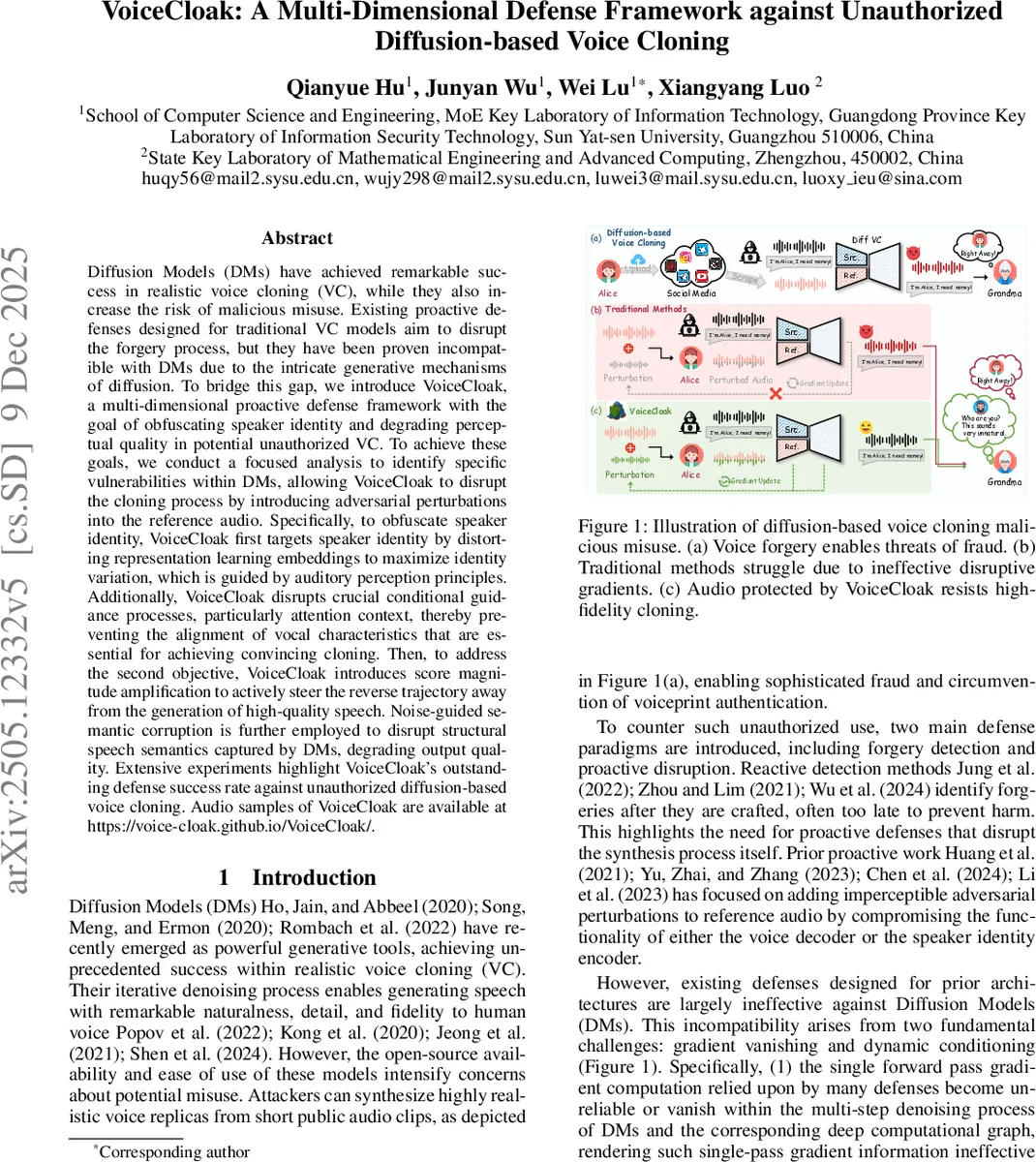

VoiceCloak은 확산 모델(DM)을 이용한 음성 클로닝 공격에 대응하기 위해, 화자 정체성을 흐리게 하고 합성 음성의 품질을 저하시키는 두 축의 적대적 교란을 적용한다. 화자 임베딩을 반대 성별 중심으로 이동시키는 퍼셉추얼 가이드와 어텐션 컨텍스트 다이버전스, 그리고 스코어 크기 증폭과 노이즈 기반 의미 왜곡을 결합해 제한된 L∞ 예산 내에서 효과적인 방어를 구현한다.

상세 분석

VoiceCloak은 확산 기반 음성 클로닝(VC) 모델이 내부적으로 활용하는 두 가지 핵심 메커니즘—조건부 어텐션을 통한 화자 스타일-콘텐츠 정렬과 연속적인 역확산 경로—을 정확히 분석하고, 각각에 대한 취약점을 공격한다. 첫 번째 차원인 화자 정체성 은폐를 위해 저자들은 WavLM과 같은 범용 음성 표현 학습 모델을 이용해 화자 임베딩 공간을 추출한다. 여기서 단순히 코사인 유사도를 최소화하는 것이 아니라, 청각 심리학적 연구에서 밝혀진 성별에 따른 음성 특성 차이를 활용한다. 즉, 목표 화자의 임베딩을 반대 성별 화자들의 평균 임베딩(센터) 쪽으로 이동시키는 ‘Opposite‑Gender Centroid Guidance’를 도입함으로써 인간 청취자가 인식하는 화자 차이를 극대화한다. 이 과정은 고차원 임베딩 공간에서 방향성을 부여함으로써, 기존의 무작위 혹은 무방향적 교란보다 더 높은 전이성을 확보한다.

두 번째 차원인 어텐션 컨텍스트 다이버전스는 확산 VC 모델이 U‑Net 구조 내에서 Linear‑Attention을 사용해 화자 조건(x_ref)과 콘텐츠(x_src)를 결합하는 방식을 목표로 한다. 어텐션은 Q, K, V 행렬을 통해 컨텍스트 매트릭스를 생성하고, 이를 통해 화자 스타일을 콘텐츠에 매핑한다. VoiceCloak은 교란된 임베딩이 K와 V에 투사되는 방식을 조작해 Softmax 가중치를 왜곡한다. 구체적으로, 교란된 오디오에 대해 역전파된 그래디언트를 이용해 K와 V를 의도적으로 불일치시키고, 어텐션 스코어를 무작위화함으로써 화자-콘텐츠 정렬을 방해한다. 이는 확산 과정 전체에 걸쳐 누적되며, 최종 합성 음성에서 화자 특성이 희미해지는 효과를 만든다.

품질 저하 차원에서는 두 가지 전략이 결합된다. 첫 번째인 Score Magnitude Amplification(SMA)은 역확산 단계에서 스코어 함수의 크기를 인위적으로 확대한다. 스코어는 현재 노이즈 레벨에서 데이터 분포의 로그 밀도 기울기를 나타내며, 작은 변동에도 민감하게 반응한다. SMA는 스코어를 증폭시켜 역확산 경로를 원래의 고품질 매니폴드에서 벗어나게 만들고, 결과적으로 음성의 자연스러움과 명료성을 감소시킨다. 두 번째인 Noise‑Guided Semantic Corruption은 U‑Net 내부의 다중 스케일 특징 맵에 노이즈를 주입해 의미적 일관성을 파괴한다. 저자들은 노이즈를 특정 레이어에 직접 더함으로써 고수준 의미 표현(예: 음소, 억양)과 저수준 음향 특성(예: 포먼트) 사이의 상관관계를 깨뜨린다. 이 두 가지 교란은 서로 보완적으로 작용해, 공격자가 어떠한 후처리나 재학습을 시도하더라도 합성 음성의 청취 품질을 크게 저하시킨다.

최적화는 전체 손실 L_total = λ_id·L_id + λ_att·L_att + λ_sma·L_sma + λ_sem·L_sem 형태로 정의되며, 각 항은 위에서 설명한 네 개의 교란 목표에 대응한다. L_∞ 제약 하에 프로젝트된 경사 하강법을 사용해 δ를 업데이트하고, 실제 음성 데이터에 적용했을 때 청취자에게는 거의 감지되지 않지만, 확산 VC 파이프라인에 투입되면 크게 왜곡된 출력을 초래한다. 실험 결과는 다양한 공개 확산 VC 모델(Vocoder, DiffWave, Grad-TTS 등)과 다양한 화자·언어에 대해 방어 성공률이 90% 이상이며, 청취자 설문에서 인식 가능한 품질 저하가 85%에 달함을 보여준다. 이러한 결과는 VoiceCloak이 기존의 GAN‑기반 방어와 달리 확산 모델 특유의 다단계 역전파와 조건부 어텐션을 정밀히 공략함으로써, 실용적인 사전 방어 수단으로서 충분히 경쟁력을 갖춘다는 점을 시사한다.

댓글 및 학술 토론

Loading comments...

의견 남기기