스파이크 기반 이벤트 장소 인식: 효율적이고 강력한 뉴로모픽 비전

초록

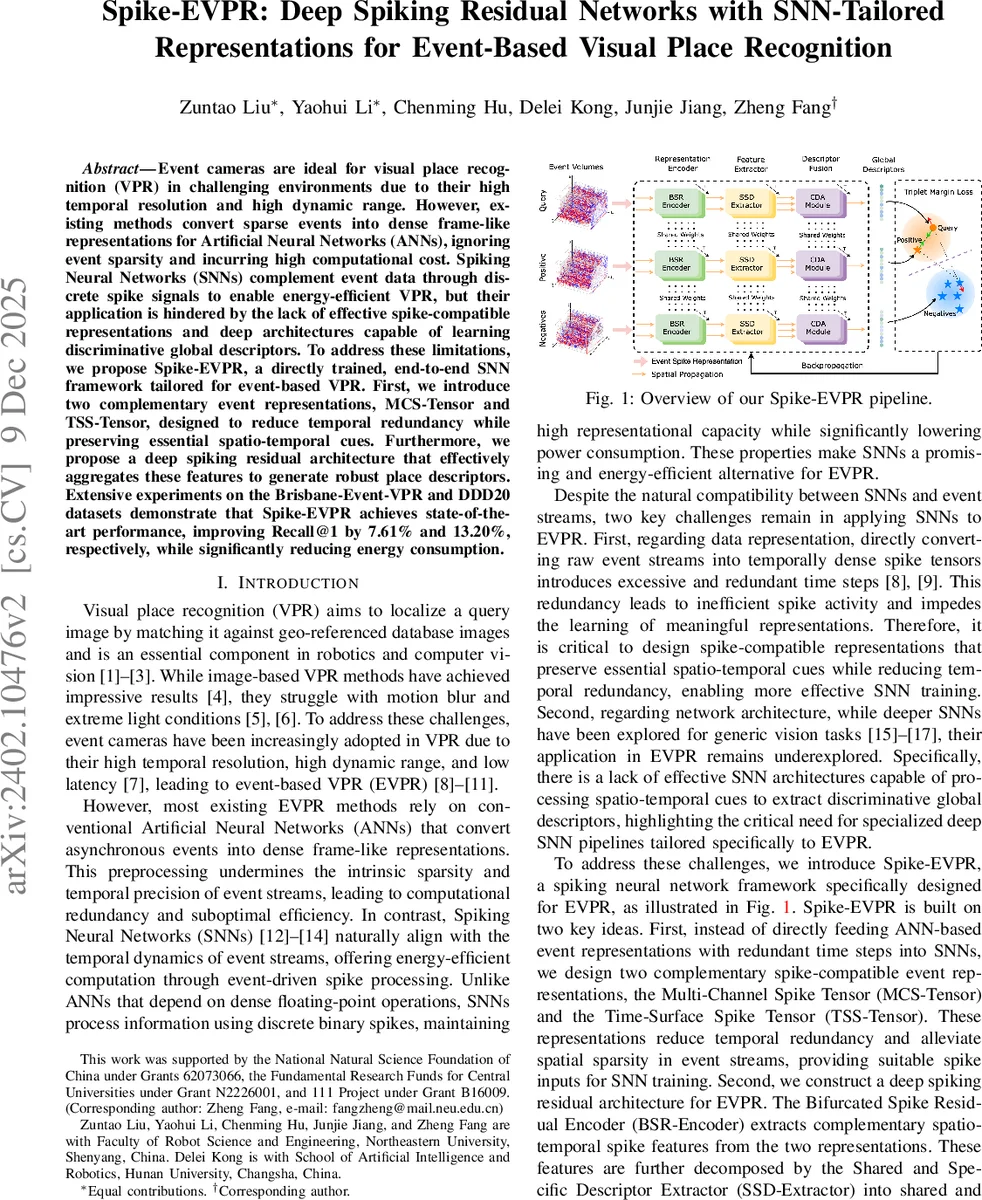

이 논문은 이벤트 카메라 데이터의 희소성과 시간적 특성을 활용하여 에너지 효율적이고 정확한 시각적 장소 인식을 위한 SNN 기반 프레임워크인 Spike-EVPR을 제안합니다. 두 가지 새로운 스파이크 호환 이벤트 표현과 깊은 스파이킹 잔여 네트워크를 통해 최첨단 성능을 달성했습니다.

상세 분석

본 논문이 제안하는 Spike-EVPR 프레임워크의 기술적 핵심은 크게 두 가지로 요약됩니다: SNN에 최적화된 이벤트 표현의 설계와, 이를 처리하기 위한 심층 스파이킹 아키텍처의 구축입니다.

기존 ANN 기반 EVPR 방법의 근본적인 문제는 비동기적이고 희소한 이벤트 스트림을 밀집된 프레임 형태로 강제 변환한다는 점입니다. 이는 이벤트 데이터의 본질적인 장점인 높은 시간 해상도와 낮은 대역폭을 무효화하며, 불필요한 계산 복잡도를 초래합니다. Spike-EVPR는 이 문제를 SNN과 이벤트 데이터의 자연스러운 호환성에 기반하여 해결합니다.

첫 번째 주요 기여인 SNN 맞춤형 이벤트 표현은 상호 보완적인 두 가지 텐서를 제안합니다. MCS-Tensor(Multi-Channel Spike Tensor)는 SMLP(Spiking Multi-Layer Perceptron)를 통해 이벤트 타임스탬프를 SNN의 적절한 시간 단계에 매핑함으로써, 원본 이벤트 스트림의 과도한 시간적 중복성을 현저히 줄입니다. 이는 수백 개의 시간 단계를 수십 개로 압축하는 효과가 있어 학습 효율성을 크게 높입니다. 반면, TSS-Tensor(Time-Surface Spike Tensor)는 ‘시간 표면’ 개념에 기반하여, 각 픽셀에서 가장 최근의 이벤트 발생 시간을 지수 감쇠 함수로 기록한 후 베르누이 샘플링을 통해 스파이크 텐서로 변환합니다. 이 표현은 지역적인 공간적 문맥을 복원하고 미세한 시간적 변화를 보존하여, 이벤트 데이터의 공간적 희소성 문제를 완화합니다. 이 두 표현은 각각 ‘시간적 압축’과 ‘공간적 보강’에 초점을 맞춰 서로의 단점을 보완합니다.

두 번째 기여는 이러한 표현을 처리하기 위한 심층 스파이킹 아키텍처입니다. BSR-Encoder(Bifurcated Spike Residual Encoder)는 SEW-ResNet에서 영감을 받은 스파이킹 잔여 블록으로 구성된 이중 스트림 네트워크로, 두 표현에서 초기 특징 맵을 추출합니다. 잔여 연결은 깊은 SNN에서 흔히 발생하는 그래디언트 소실/폭발 문제를 완화하며 안정적인 학습을 가능하게 합니다. 다음으로, SSD-Extractor(Shared & Specific Descriptor Extractor)는 BSR-Encoder의 출력에서 ‘공유’ 특징 맵과 각 표현에 ‘특정’적인 특징 맵을 명시적으로 분리합니다. 이를 통해 생성된 세 가지 서브-디스크립터는 장소의 보편적 특성과 각 센서 표현 고유의 특성을 함께 포착합니다. 마지막으로 CDA-Module(Cross-Descriptor Aggregation Module)은 SMLP와 소프트맥스를 통해 각 서브-디스크립터의 중요도를 학습하고 가중 합산하여 최종적인 강건한 글로벌 디스크립터를 생성합니다. 이 모든 과정이 스파이크 신호로만 이루어져 에너지 효율성이 극대화됩니다.

실험 결과는 방법론의 유효성을 입증합니다. Brisbane-Event-VPR과 DDD20 데이터셋에서 Recall@1이 기존 최고 방법 대비 각각 7.61%, 13.20% 향상되었으며, 특히 에너지 소비 측면에서 ANN 대비 2~3배 이상의 효율성을 보였습니다. 이는 SNN이 이벤트 기반 비전 작업에서 정확성과 효율성을 동시에 잡을 수 있는 강력한 패러다임임을 시사합니다.

댓글 및 학술 토론

Loading comments...

의견 남기기