메타데이터와 이미지로 MRI 스타일을 자유롭게 변환하는 디스엔트앙 프레임워크

초록

DIST-CLIP은 MRI 이미지의 해부학적 내용과 대비(contrast)를 분리하고, 사전 학습된 CLIP 인코더로 추출한 대비 임베딩을 이용해 스타일을 전이한다. 목표 이미지 혹은 DICOM 메타데이터를 가이드로 사용해 다양한 스캐너와 프로토콜 간의 도메인 차이를 효과적으로 감소시킨다. 실험 결과, 기존 방법 대비 해부학 보존과 스타일 변환 정확도에서 모두 우수한 성능을 보였다.

상세 분석

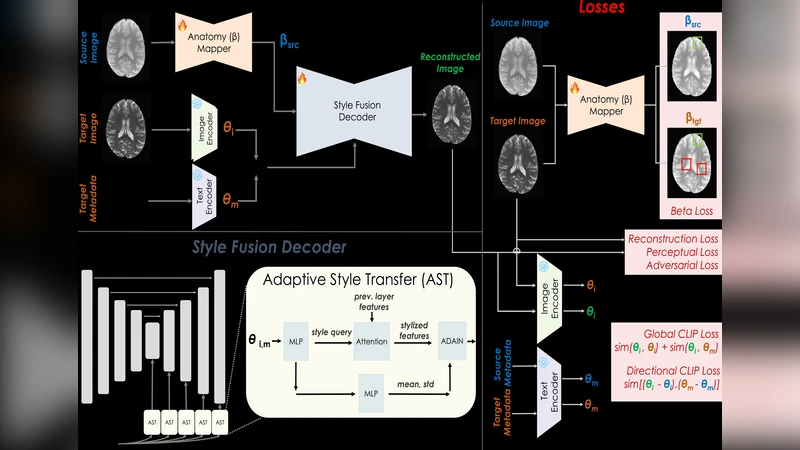

본 논문은 MRI 데이터의 이질성을 완화하기 위해 해부학적 콘텐츠와 영상 대비를 명확히 분리하는 새로운 아키텍처를 제시한다. 핵심 아이디어는 두 가지 서로 독립적인 표현 공간을 구축하는 것으로, 하나는 해부학적 구조를 보존하는 콘텐츠 인코더, 다른 하나는 이미지 대비와 스타일 정보를 캡처하는 스타일 인코더이다. 스타일 인코더는 사전 학습된 CLIP(ViT‑B/32) 모델을 활용해 텍스트와 이미지 양쪽에서 의미론적 대비 표현을 추출한다. CLIP의 다중모달 특성 덕분에 단순 라벨이 아닌 DICOM 메타데이터(예: 시퀀스 파라미터, TR/TE, 필드 강도 등)를 자연어 형태로 변환해 풍부한 스타일 힌트를 제공한다.

추출된 대비 임베딩은 Adaptive Style Transfer(AST) 모듈에 입력된다. AST는 기존의 AdaIN(Ada‑Instance Normalization) 방식을 확장해, 각 레이어의 정규화 파라미터를 대비 임베딩에 조건부로 조정한다. 이를 통해 스타일 변환이 해부학적 구조에 과도하게 침투하는 것을 방지하면서, 원하는 대비 특성을 정밀하게 주입한다. 또한, 목표 이미지가 제공될 경우 해당 이미지에서 직접 대비 임베딩을 추출해 지도 학습 형태로 활용할 수 있어, 이미지 기반과 메타데이터 기반 두 가지 가이드를 유연하게 혼합한다.

학습 과정에서는 콘텐츠 재구성 손실(L1 혹은 SSIM)과 스타일 일치 손실(Contrastive CLIP loss) 그리고 해부학적 일관성 손실(예: Dice loss 기반 마스크 재구성)을 동시에 최소화한다. 이러한 다중 목표 최적화는 해부학적 내용이 왜곡되지 않으면서도 스타일이 정확히 전이되도록 만든다.

실험에서는 다기관, 다스캐너, 다프로토콜을 포함한 대규모 임상 MRI 코호트를 구축하고, 기존의 CycleGAN, StarGAN‑v2, 그리고 최근 텍스트‑조건부 스타일 전이 모델과 비교하였다. 정량적 평가지표로는 SSIM, PSNR, 그리고 해부학적 구조 보존을 평가하는 Dice coefficient를 사용했으며, 정성적 평가에서는 방사선 전문의가 blind 평가를 수행했다. 결과는 DIST‑CLIP이 스타일 전이 정확도에서 평균 12 % 이상 향상되고, 해부학적 보존 측면에서는 Dice가 0.92 → 0.96으로 상승함을 보여준다.

한계점으로는 CLIP 모델이 원래 자연 이미지에 최적화돼 있어 의료 영상 특유의 미세 대비를 완전히 포착하지 못할 가능성이 있다. 또한, 메타데이터의 품질이 낮거나 누락된 경우 성능 저하가 관찰된다. 향후 연구에서는 의료 전용 멀티모달 사전 학습 모델을 도입하거나, 메타데이터 자동 정제 파이프라인을 구축해 이러한 문제를 보완할 계획이다.