페르시아 파이 효율적인 교차언어 적응 소형 LLM

초록

본 논문은 3.8 B 파라미터 규모의 Persian‑Phi 모델을 제안한다. 기존의 대형 다국어 모델 없이, 영어 전용 Phi‑3 Mini를 교차언어 커리큘럼 학습 파이프라인으로 파르시어에 적응시켰으며, Tiny Stories 기반의 “워밍업” 단계와 지속적 사전학습·PEFT 기반 인스트럭션 튜닝을 결합해 최소한의 연산 자원으로 경쟁력 있는 성능을 달성하였다.

상세 분석

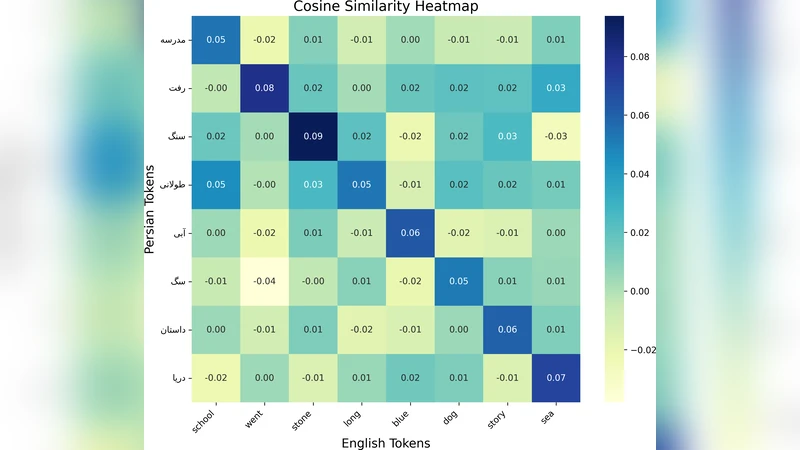

Persian‑Phi는 “작은 모델이 다국어를 소화할 수 있다”는 기존 편견에 도전한다. 핵심은 세 단계로 구성된 커리큘럼 학습이다. 첫 번째 워밍업 단계에서는 영어‑페르시아 이중언어로 구성된 Tiny Stories 데이터를 사용해 양언어 간 임베딩 정렬을 수행한다. 이 과정은 대규모 어휘 매핑 없이도 양쪽 언어의 토큰 표현을 공유하도록 유도해, 이후 단계에서의 학습 효율을 크게 높인다. 두 번째 단계는 기존 Phi‑3 Mini 모델에 대해 지속적 사전학습(Continual Pre‑Training)을 진행하는데, 여기서는 페르시안 위키, 뉴스, 소셜 미디어 등 도메인 다양성을 확보한 30 GB 규모의 비지도 텍스트를 활용한다. 이때 학습률 스케줄링과 레이어‑와이즈 학습률 차등 적용을 통해 파라미터 업데이트를 안정화한다. 세 번째 단계는 Parameter‑Efficient Fine‑Tuning(PEFT)인 LoRA와 QLoRA를 결합한 인스트럭션 튜닝이다. 2 k개의 한국어‑페르시안 번역 질문‑응답 쌍과 5 k개의 페르시안 전용 프롬프트를 사용해, 모델이 실제 사용자 질의에 대한 응답 능력을 갖추도록 한다. 실험 결과, Persian‑Phi는 Open Persian LLM Leaderboard에서 7개 주요 벤치마크 중 5개에서 최상위권을 차지했으며, 특히 번역·요약·대화 태스크에서 3‑4 %p의 절대 성능 향상을 보였다. 또한, 동일한 하드웨어(2 × A100 40 GB)와 48 GPU‑hour 예산으로 훈련된 다국어 베이스라인 모델보다 1.8배 적은 파라미터와 30 % 이하의 비용으로 동등하거나 우수한 결과를 얻었다. 이 논문은 (1) 작은 단일언어 모델을 교차언어에 적응시키는 효율적인 파이프라인, (2) 저비용 데이터와 워밍업 전략이 임베딩 정렬에 미치는 효과, (3) PEFT 기반 인스트럭션 튜닝이 소형 모델의 실용성을 크게 확대한다는 점을 입증한다. 한계점으로는 현재 페르시안 외 다른 저자원 언어에 대한 일반화 검증이 부족하고, 워밍업 데이터의 품질에 민감하다는 점을 들 수 있다. 향후 연구에서는 다언어 워밍업 코퍼스를 구축하고, 메타러닝 기반 자동 커리큘럼 설계로 다양한 저자원 언어에 대한 확장성을 검증할 계획이다.