비디오 과학 벤치마크: 영상 생성 모델의 과학적 이해와 추론 평가

초록

VideoScience-Bench는 물리·화학 개념 103개와 14개 주제로 구성된 200개의 복합 과학 시나리오 프롬프트를 제공해, 영상 생성 모델이 대학 수준의 과학적 이해와 다중 개념 추론을 수행하도록 평가한다. T2V·I2V 설정에서 7개 최신 모델을 5가지 평가 차원(프롬프트 일관성, 현상 일치성, 동적 정확성, 불변성, 시공간 연속성)으로 검증하고, VLM‑as‑a‑Judge를 활용해 인간 평가와 높은 상관성을 확인했다.

상세 분석

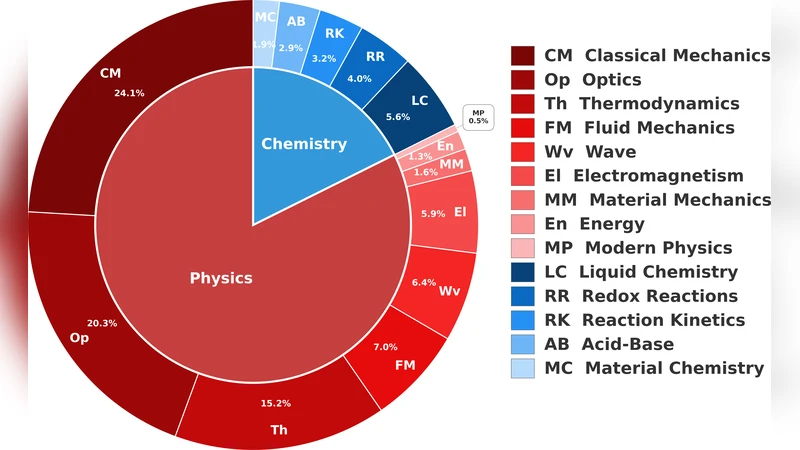

본 논문은 기존 비디오 벤치마크가 ‘일상적 상식’ 수준에 머무르는 한계를 지적하고, 과학적 법칙을 기반으로 한 ‘제로샷 추론’ 능력을 측정할 필요성을 강조한다. 이를 위해 저자들은 14개의 물리·화학 주제(역학, 열역학, 전자기, 광학, 화학 반응 등)를 선정하고, 각 주제별 핵심 개념 103개를 추출했다. 이후 200개의 프롬프트는 “물체가 일정 온도에서 가열될 때 발생하는 현상”처럼 복수의 개념을 결합하도록 설계돼, 단순 텍스트‑투‑비디오 모델이 개념을 나열하는 수준을 넘어 실제 과학적 인과관계를 반영한 영상을 생성해야 한다는 요구를 만든다.

평가 프레임워크는 다섯 축으로 구성된다. ① Prompt Consistency는 모델이 입력 프롬프트의 핵심 요소를 놓치지 않았는지를 검사한다. ② Phenomenon Congruency는 생성된 영상이 물리·화학 현상과 일치하는지를 판단한다. ③ Correct Dynamism은 시간 흐름 속에서 물리량(속도, 온도 등)이 올바르게 변화하는지를 검증한다. ④ Immutability는 보존 법칙(에너지, 질량 등)이 위배되지 않았는지를 체크한다. ⑤ Spatio‑Temporal Continuity는 영상의 공간·시간 연속성이 자연스러운지를 평가한다. 이러한 다차원 평가는 기존 단일 ‘정확도’ 혹은 ‘시각적 품질’ 지표보다 과학적 추론 능력을 정밀하게 드러낸다.

점수 산출은 VLM‑as‑a‑Judge, 즉 사전학습된 대형 시각‑언어 모델을 ‘판사’로 활용한다. VLM은 프롬프트와 생성 영상을 텍스트로 변환한 뒤, 사전 정의된 평가 기준에 따라 점수를 매긴다. 저자들은 200개 샘플에 대해 인간 전문가와 VLM 점수를 비교했으며, Pearson r = 0.84 이상의 높은 상관관계를 보고, VLM이 신뢰할 만한 자동 평가 도구임을 입증했다.

실험 결과, 최신 텍스트‑투‑비디오 모델(Stable Diffusion‑Video, Make‑It‑Real 등)과 이미지‑투‑비디오 파이프라인(Imagen‑Video, Phenaki 등)은 전반적으로 낮은 점수를 기록했다. 특히 ‘불변성’과 ‘동적 정확성’에서 평균 30% 이하의 성공률을 보였으며, 이는 모델이 물리 법칙을 내재화하지 못하고 시각적 퀄리티에만 집중하고 있음을 시사한다. 반면, 일부 모델은 ‘프롬프트 일관성’에서는 70% 이상의 점수를 받아, 텍스트 이해는 비교적 양호하지만 과학적 추론 단계에서 큰 격차가 있음을 확인했다.

논문은 또한 한계점으로, 현재 VLM‑as‑a‑Judge가 복잡한 화학 반응 메커니즘을 완전히 파악하지 못한다는 점을 언급한다. 따라서 향후 도메인‑전문 VLM을 구축하거나, 물리‑시뮬레이션 기반의 정량적 메트릭을 결합하는 방안을 제시한다. 전반적으로 VideoScience-Bench는 비디오 생성 모델을 ‘시각적 생성기’에서 ‘과학적 추론기’로 전환시키는 중요한 평가 인프라로 자리매김한다.

댓글 및 학술 토론

Loading comments...

의견 남기기