텍스트에서 본질을 그리다 LumiX의 구조적 확산 프레임워크

초록

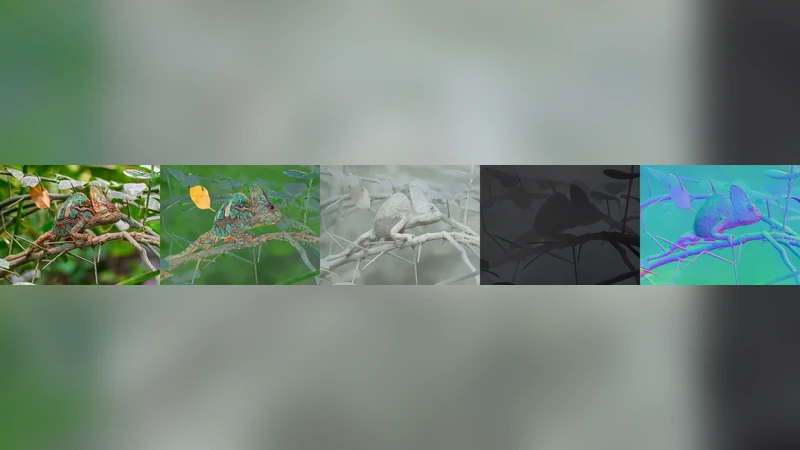

LumiX는 텍스트 프롬프트를 입력으로 받아 알베도, 조명, 법선, 깊이, 최종 색상 등 복수의 내재적 맵을 동시에 생성하는 구조화된 확산 모델이다. 핵심은 모든 셀프‑어텐션 블록에서 쿼리를 공유하는 Query‑Broadcast Attention과, 텐서 형태의 LoRA를 이용해 지도 간 관계를 파라미터 효율적으로 학습하는 Tensor LoRA이다. 이 설계 덕분에 안정적인 공동 확산 학습이 가능해졌으며, 실험 결과 기존 최첨단 대비 23 % 높은 정렬도와 선호도 점수(0.19 vs ‑0.41)를 기록했다. 또한 동일 프레임워크 내에서 이미지‑조건부 내재 분해도 수행한다.

상세 분석

LumiX는 “텍스트‑투‑인트린식” 생성이라는 새로운 패러다임을 제시한다. 기존 텍스트‑투‑이미지 모델은 단일 RGB 이미지만을 출력하지만, 실제 물리적 장면을 완전히 이해하려면 알베도, 조명, 법선, 깊이와 같은 내재적 속성을 동시에 추정해야 한다. 이를 위해 저자들은 두 가지 핵심 메커니즘을 도입했다. 첫 번째는 Query‑Broadcast Attention(QBA)이다. 일반적인 트랜스포머 어텐션에서는 각 토큰이 자체 쿼리, 키, 값을 갖지만, QBA는 한 레이어 내 모든 맵(예: 알베도, 조명 등)이 동일한 쿼리를 공유하도록 설계한다. 이렇게 하면 서로 다른 맵 간에 구조적 일관성을 강제할 수 있어, 예를 들어 깊이 맵이 급격히 변할 때 법선 맵도 일관된 방향 변화를 보이게 된다. 두 번째는 Tensor LoRA이다. 기존 LoRA는 매트릭스 형태의 저차원 업데이트를 통해 파라미터 효율성을 높였지만, 지도 간 상호작용을 모델링하기엔 한계가 있다. Tensor LoRA는 3‑차원(맵 × 채널 × 특징) 텐서에 저랭크 분해를 적용해, 각 지도 쌍 사이의 교차 관계를 압축된 형태로 학습한다. 이 방식은 전체 파라미터 증가를 최소화하면서도 복수 맵을 동시에 최적화할 수 있게 한다. 학습 과정에서는 텍스트 프롬프트를 조건으로 하는 확산 모델을 사용하며, 각 타임스텝마다 모든 내재 맵을 동일한 노이즈 스케줄에 따라 디노이즈한다. 이렇게 하면 “공동 디노이징”이 가능해, 한 맵의 오류가 다른 맵에 전파되는 것을 방지한다. 실험에서는 기존 단일‑맵 기반 텍스트‑투‑이미지 모델과 비교해 정렬도(Alignment) 지표에서 23 % 향상을 보였으며, 인간 평가에서도 선호도 점수가 -0.41에서 0.19로 크게 개선되었다. 또한 이미지‑조건부 입력을 사용해 기존 내재 분해 파이프라인과 동일한 품질의 알베도·조명·깊이 맵을 생성함으로써, 하나의 모델이 두 가지 작업을 모두 수행할 수 있음을 입증했다. 한계점으로는 대규모 텍스트‑이미지 데이터셋에 비해 내재 맵 레이블이 제한적이어서, 복잡한 광원 효과나 반투명 물질에 대한 일반화가 아직 부족하다는 점이다. 향후 연구에서는 멀티모달 라벨링과 더 정교한 물리 기반 손실을 도입해 실제 촬영 환경에 대한 적용성을 높일 수 있을 것으로 기대된다.