AI 기반 문서 검열 영국 공공기관의 현실과 과제

초록

본 연구는 영국 공공기관 44곳을 대상으로 자유정보법(FOI) 요청을 통해 AI 기반 문서 검열 도입 현황을 조사하였다. 응답 결과, 실제 AI 도구를 활용하는 기관은 단 한 곳에 불과했으며, 절반 이상의 기관이 검열 정책 자체가 없거나 ‘정보가 보유되지 않음’이라고 답했다. 주요 장애 요인으로는 기록 관리 미비, 표준화된 검열 지침 부재, 인간 감독을 위한 전문 교육 부족이 제시되었다. 연구는 기술 자동화와 인간 전문성의 균형을 강조하며, 정책 입안자에게 사회기술적 접근법을 권고한다.

상세 분석

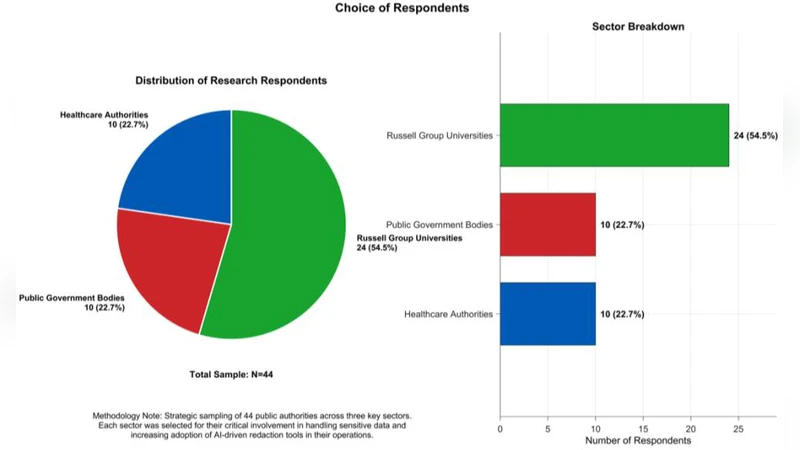

이 논문은 영국 공공기관에서 AI 기반 문서 검열이 실제로 어떻게 적용되고 있는지를 실증적으로 탐색한다. 연구 설계는 자유정보법(FOI) 요청을 활용해 보건, 정부, 고등교육 부문을 아우르는 44개 기관에 동일한 질문지를 발송하고, 회신을 정량·정성 분석한 혼합방법론을 채택하였다. 응답률은 68%에 달했으며, 이는 공공 부문의 투명성 요구와 데이터 보호 의무 사이에서 발생하는 실무적 긴장을 반영한다.

첫 번째 주요 발견은 AI 도구 채택 현황이 극히 제한적이라는 점이다. 전체 응답기관 중 AI 기반 자동 검열 시스템을 실제 운영 중인 기관은 단 1곳(2.3%)에 불과했으며, 나머지는 전통적인 수동 검열 혹은 전혀 검열 절차가 없다고 보고했다. 이는 AI 기술이 제공하는 고속·대량 처리 능력에도 불구하고, 공공기관 내부의 인프라, 예산, 그리고 법적·윤리적 위험 인식이 도입을 저해하고 있음을 시사한다.

두 번째로, 절반 이상의 기관이 ‘정보가 보유되지 않음’ 혹은 ‘관련 정책이 없음’이라는 답변을 제시함으로써, 조직 차원의 공식 검열 정책 자체가 부재하거나 문서 관리 체계가 미비함을 드러냈다. 이는 기록 보존·분류 체계가 불명확할 경우, AI 모델이 학습할 수 있는 라벨링 데이터가 부족해 자동화의 전제 조건이 깨지는 문제와 연결된다.

세 번째는 인적 요소의 결함이다. 응답기관 중 71%가 검열 담당 직원에게 AI 활용 교육이 전혀 제공되지 않았다고 답했으며, 58%는 검열 결과에 대한 인간 감독 절차가 명문화되지 않았다고 밝혔다. 이는 ‘인간‑기계 협업(Human‑AI collaboration)’이론에서 강조하는 ‘인간 감독(Human oversight)’ 원칙이 현장에 적용되지 못하고 있음을 보여준다.

연구는 이러한 격차를 ‘기록 관리 부실’, ‘표준화된 검열 지침 부재’, ‘전문화된 교육 부족’이라는 세 가지 핵심 장벽으로 정리한다. 특히 기록 관리 부실은 AI 모델이 정확한 민감 정보 식별을 위해 필요한 학습 데이터 확보를 방해하고, 지침 부재는 자동화된 검열 결과의 일관성·책임성을 저해한다. 교육 부족은 AI 오작동 시 적절한 오류 수정과 윤리적 판단을 수행할 인력을 양성하지 못한다는 위험을 내포한다.

정책적 함의 측면에서 저자는 사회기술적 접근을 제안한다. 기술적 솔루션(예: 프라이버시‑보존 머신러닝, 검열용 사전 학습 모델)과 조직적 조치(예: 중앙집중식 검열 정책 수립, 표준 운영 절차(SOP) 도입, 지속적인 전문 교육 프로그램) 사이의 상호보완이 필요하다는 것이다. 또한, 데이터 보호법(GDPR)과 정보 자유법(FOIA) 사이의 법적 충돌을 조정하기 위한 명확한 가이드라인 마련이 시급하다고 강조한다.

전반적으로 이 논문은 영국 공공부문에서 AI 기반 문서 검열이 아직 초기 단계에 머물러 있음을 실증적으로 입증하고, 기술 도입을 가속화하기 위해서는 조직 문화·프로세스·인력 양성이라는 비기술적 요소를 동시에 강화해야 함을 설득력 있게 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기