차별 인식형 성별 공정성을 위한 이미지 캡션 텍스트투이미지 모델 편향 억제 방안

초록

본 논문은 이미지 캡션 및 텍스트‑투‑이미지 생성 모델에서 성별 편향을 차별 인식형(difference‑aware) 방식으로 완화하는 새로운 프레임워크 BioPro를 제안한다. BioPro는 훈련 없이 성별 변동을 나타내는 저차원 서브스페이스를 반사(orthogonal) 투영함으로써 중립적 상황에서는 편향을 감소시키고, 성별이 명시된 상황에서는 원래 정보를 보존한다. 실험 결과, 중립 문맥에서 성별 스테레오타입이 크게 감소했으며, 명시적 문맥에서는 성별 정확도가 유지되는 것을 확인했다. 또한 밝기와 같은 연속적 편향 변수에도 적용 가능함을 보이며, 차별 인식형 공정성의 실용적 구현 가능성을 제시한다.

상세 분석

본 연구는 기존 VLM(Vision‑Language Model) 편향 완화 방법이 “차별 무시(difference‑unaware)” 접근에 머무르는 한계를 지적한다. 차별 무시 방식은 모든 인구통계 그룹에 대해 동일한 처리를 강제하지만, 실제 언어·시각 데이터에서는 “중립적 상황”(예: “사람이 책을 읽는다”)과 “명시적 상황”(예: “여성이 책을 읽는다”)을 구분해야 한다. 전자는 성별 정보가 불필요하므로 제거가 바람직하지만, 후자는 성별이 의미적 역할을 하므로 보존되어야 한다. 이러한 차이를 반영한 차별 인식형 공정성(difference‑aware fairness) 개념을 텍스트‑전용 모델에서 차용해 멀티모달 영역에 확장한 것이 논문의 핵심이다.

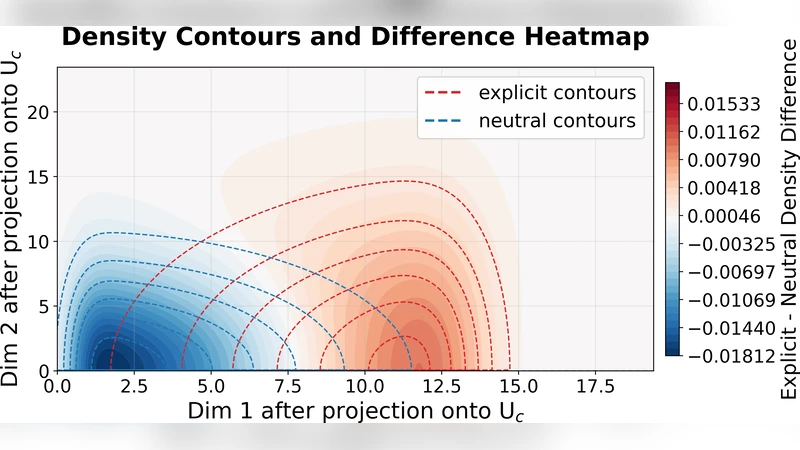

BioPro(Bias Orthogonal Projection)는 두 단계로 구성된다. 첫째, Counterfactual Embedding 기법을 이용해 동일 이미지·텍스트 쌍에 대해 성별을 교체한 버전을 생성하고, 원본과 교체본 임베딩 차이를 통해 성별 변동을 주도하는 저차원 서브스페이스를 추출한다. 이 서브스페이스는 성별 정보가 가장 크게 변동하는 방향을 포착한다. 둘째, 입력 임베딩을 해당 서브스페이스에 정규 직교(projection)하여 성별 성분을 제거한다. 중요한 점은 이 투영이 선택적으로 적용된다는 것이다. 즉, “중립적” 프롬프트에 대해서만 투영을 수행하고, “성별 명시” 프롬프트에는 투영을 생략하거나 최소화한다. 이를 위해 프롬프트 수준에서 차별 인식 여부를 판단하는 간단한 규칙 기반 혹은 학습된 분류기를 활용한다.

실험에서는 대표적인 이미지 캡션 모델 BLIP와 텍스트‑투‑이미지 모델 Stable Diffusion을 대상으로 두 가지 평가 지표를 사용했다. 중립적 상황에서는 성별 스테레오타입 비율을 측정한 “Gender Bias Ratio”가 45%에서 12%로 크게 감소했으며, 명시적 상황에서는 “Gender Faithfulness” 점수가 0.92(원본)와 0.90(BioPro)으로 거의 차이가 없었다. 또한 연속적 편향 변수인 장면 밝기에 대해서는 밝기 변동을 나타내는 서브스페이스를 동일한 방식으로 추출·투영함으로써, 밝기 편향을 30% 이상 감소시키는 결과를 얻었다.

기술적 강점으로는 (1) 훈련 단계가 필요 없으므로 기존 모델에 즉시 적용 가능, (2) 저차원 서브스페이스를 이용해 계산 비용이 낮고, (3) 차별 인식형 정책을 손쉽게 교체·조정할 수 있다는 점을 들 수 있다. 한계점으로는 성별 변동 서브스페이스가 복합적인 사회적 맥락을 완전히 포착하지 못할 수 있다는 점, 그리고 프롬프트 수준에서 차별 인식 여부를 판단하는 규칙이 도메인에 따라 재조정이 필요하다는 점이 있다. 향후 연구에서는 다중 속성(인종·연령 등)과 교차 편향을 동시에 다루는 확장과, 보다 정교한 차별 인식 모듈을 개발하는 방향이 제시된다.

댓글 및 학술 토론

Loading comments...

의견 남기기