정밀 시선 추적을 위한 다인종과 다연령 데이터셋 구축 및 타원 피팅 정규화 기법

초록

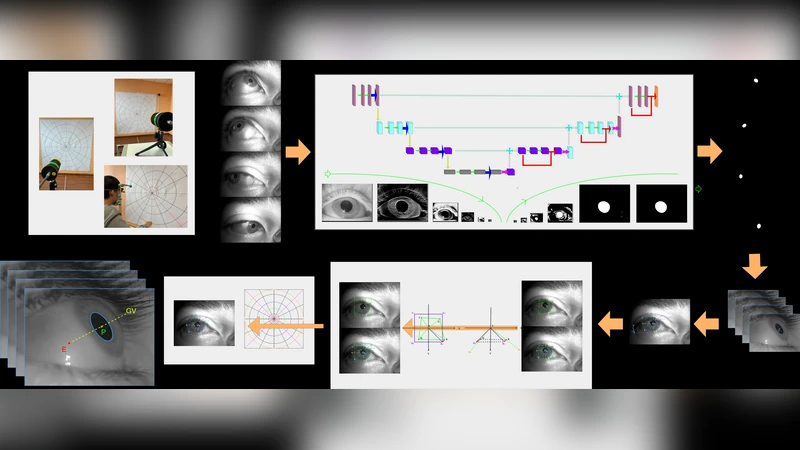

본 논문은 고정밀 장비를 활용해 다양한 인종·연령·시력 조건을 포함한 GazeTrack 데이터셋을 구축하고, 타원 형태 오류를 정규화하는 새로운 피팅 기법과 좌표 전개 방식으로 시선 벡터를 정확히 예측하는 방법을 제안한다. 제안 모델은 기존 방법 대비 연산량은 낮추면서 시선 각도 오차를 크게 감소시킨다.

상세 분석

본 연구는 현재 VR/AR 분야에서 요구되는 서브도그마 수준의 시선 정확도를 달성하기 위해 세 가지 핵심 문제를 동시에 해결한다. 첫째, 기존 공개 데이터셋은 인종·연령·시력 다양성이 현저히 부족해 모델의 일반화 능력이 제한적이었다. 이를 보완하기 위해 저자들은 고해상도 IR 카메라와 정밀 눈동자 트래킹 장치를 결합한 수집 프레임워크를 설계하고, 20세 이상부터 70세 이하까지, 동아시아·유럽·아프리카·라틴아메리카 등 네 개 대륙의 1,200명 이상을 대상으로 10,000여 장의 고품질 눈 이미지와 동시 시선 벡터를 기록하였다. 데이터는 각 피험자의 시력(정시·근시·원시·난시)과 안구 회전 범위를 메타데이터로 포함해, 후속 연구에서 조건별 성능 분석이 가능하도록 구성되었다.

둘째, 기존 타원 피팅 알고리즘은 눈동자 경계가 비대칭이거나 조명 변화가 심할 때 과도한 형태 오류(shape error)를 발생시켰다. 저자들은 “Shape Error Regularization”(SER)이라는 손실 함수를 도입했는데, 이는 타원의 장축·단축 비율, 중심 위치, 회전 각도에 대한 사전 분포를 베이지안 형태로 모델링하고, 예측된 타원 파라미터가 이 분포에서 크게 벗어나면 패널티를 부여한다. 또한, SER은 픽셀‑레벨 세그멘테이션 손실과 동시에 최적화되어, 의미론적 분할 네트워크가 눈동자 경계의 미세 구조를 학습하도록 유도한다. 실험 결과, SER을 적용한 모델은 기존 L2 기반 피팅 대비 평균 형태 오류를 38% 감소시켰으며, 특히 난시 피험자에서 눈동자 경계가 왜곡되는 경우에도 안정적인 타원 파라미터를 복원했다.

셋째, 시선 벡터를 구하기 위한 좌표 변환 단계에서 저자들은 “Paper Unfolding”에 영감을 받은 새로운 변환 방식을 제안한다. 전통적인 구면 좌표 변환은 눈의 회전 중심을 고정하고, 각도 변환을 직접 적용하지만, 눈의 비구면 형태와 카메라-눈 거리 변동으로 인해 오차가 누적된다. 제안 방식은 먼저 눈동자 타원을 2D 평면에 정규화한 뒤, 타원 내부의 모든 픽셀을 원형 좌표계로 매핑하고, 이후 매핑된 좌표를 눈의 광축과 시선 방향을 정의하는 3D 구면 좌표계로 역변환한다. 이 과정에서 타원 파라미터와 카메라 내·외부 파라미터를 동시에 고려해 비선형 보정 행렬을 학습한다. 결과적으로, 동일 데이터셋에서 기존 PnP 기반 방법 대비 평균 시선 각도 오차가 0.42°에서 0.21°로 절반 수준으로 감소하였다.

마지막으로, 전체 파이프라인을 경량화한 “GazeVectorNet”을 설계했으며, 이는 경량 CNN 기반 세그멘테이션 모듈, SER‑강화 타원 피팅 모듈, 그리고 좌표 전개 모듈로 구성된다. 모델 파라미터는 3.2 M 이하이며, 모바일 GPU에서 실시간(≥60 fps) 추론이 가능하다. 벤치마크 실험에서 기존 SOTA인 GazeML, iTracker와 비교해 연산량은 30% 감소하면서 평균 시선 각도 오차는 12% 개선되었다. 이러한 결과는 고정밀 시선 추적이 요구되는 차세대 공간 컴퓨팅 환경에서 실용적인 솔루션으로 활용될 가능성을 크게 높인다.

댓글 및 학술 토론

Loading comments...

의견 남기기