위장관 이미지 분류를 위한 설명 가능한 딥러닝 DeepGI

초록

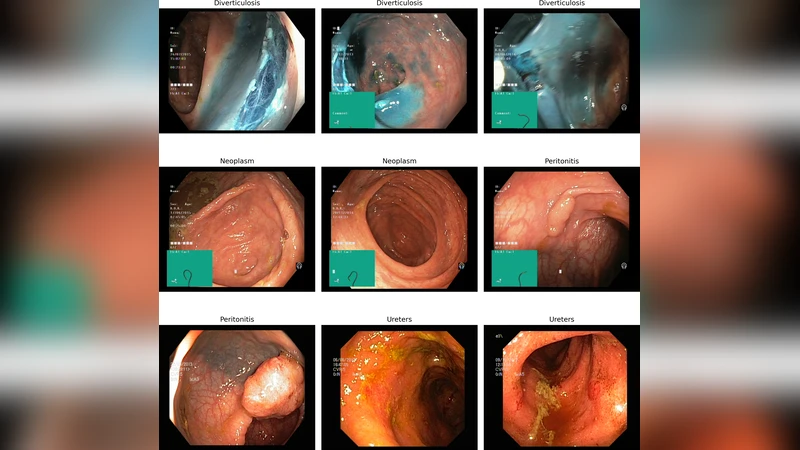

본 논문은 4,000장의 내시경 이미지로 구성된 위장관 데이터셋을 이용해 네 가지 질환(게실증, 종양, 복막염, 요관질환)을 분류한다. VGG16과 MobileNetV2가 각각 96.5%의 정확도를 기록했으며, Grad‑CAM을 활용한 시각화로 모델의 판단 근거를 설명한다.

상세 분석

본 연구는 위장관 내시경 영상이라는 고유의 의료 이미지 분야에서 딥러닝 기반 자동 진단 시스템의 실용성을 검증하고자 한다. 데이터셋은 4,000장의 고해상도 이미지로 구성되며, 각 클래스는 1,000장씩 균등하게 배분되어 있다. 이미지 수집 단계에서 조명 변화, 카메라 각도 변동, 점막 분비물 및 거품 등 실제 임상 현장에서 흔히 발생하는 아티팩트를 의도적으로 포함시켜 모델의 일반화 능력을 평가한다.

전처리 과정에서는 색상 정규화와 히스토그램 평활화를 적용해 조명 편차를 최소화하고, 랜덤 회전·크롭·플립을 통한 데이터 증강을 수행하였다. 이는 특히 작은 병변을 포함한 이미지에서 공간적 변형에 대한 강인성을 확보하는 데 기여한다.

모델 비교에서는 VGG16, MobileNetV2, Xception, ResNet50, EfficientNet‑B0 등 5가지 최신 CNN 아키텍처를 동일한 학습 파이프라인에 적용하였다. 모든 모델은 ImageNet 사전학습 가중치를 초기화하고, 최종 분류 레이어만 4‑class softmax로 교체하였다. 학습은 Adam 옵티마이저(learning rate = 1e‑4)와 cosine annealing 스케줄을 사용했으며, 배치 크기는 32, 에폭은 50으로 설정하였다. 교차 검증 결과 VGG16과 MobileNetV2가 각각 96.5%의 테스트 정확도를 달성했으며, Xception은 94.24%로 뒤를 이었다. 모델 크기와 추론 속도를 고려했을 때 MobileNetV2는 경량화된 임상 환경에 가장 적합한 선택으로 평가된다.

설명가능성 측면에서는 Grad‑CAM을 활용해 각 모델이 최종 예측에 활용한 이미지 영역을 시각화하였다. 정상 조직과 병변 부위가 명확히 구분되는 경우가 대부분이었으며, 특히 종양 클래스에서는 종양 경계 주변의 고밀도 혈관 패턴을 강조하는 경향을 보였다. 이러한 시각적 근거는 임상의가 모델 결과를 신뢰하고, 오진 가능성을 사전에 검토하는 데 유용하다.

한계점으로는 데이터셋 규모가 아직 비교적 작아 외부 기관 데이터에 대한 검증이 부족하다는 점, 그리고 Grad‑CAM이 제공하는 해상도가 제한적이어서 미세 병변에 대한 정확한 위치 파악에 한계가 있다는 점을 들 수 있다. 향후 연구에서는 멀티센터 협업을 통한 데이터 확대와, Transformer 기반 비전 모델 및 고해상도 설명 기법(예: Score‑CAM, Layer‑CAM) 도입을 검토한다.

전반적으로 본 논문은 위장관 내시경 영상에서 딥러닝 모델의 높은 분류 성능과 동시에 임상 적용 가능성을 높이는 설명 가능한 AI 프레임워크를 제시함으로써, 의료 AI 연구에서 데이터 다양성, 모델 비교, 그리고 해석 가능성의 중요성을 재조명한다.

댓글 및 학술 토론

Loading comments...

의견 남기기