효율적인 비전 언어 모델을 위한 정보 이론 기반 적응형 구조 프루닝

초록

InfoPrune은 정보 병목 원리를 이용해 비전‑언어 모델(VLM)의 구조를 정량적으로 평가하고, 엔트로피 기반 유효 랭크(eRank)와 Kolmogorov‑Smirnov 거리(KS)를 결합한 프루닝 기준을 제시한다. 헤드 프루닝은 학습 단계에서 정보 손실 목표를 최소화하도록 진행하고, FFN 압축은 훈련 없이 적응형 저‑랭크 근사로 수행한다. VQAv2, TextVQA, GQA에서 FLOP 3.2배 감소와 1.8배 가속을 달성하면서 성능 저하를 최소화한다.

상세 분석

InfoPrune은 기존 프루닝 기법이 주로 경험적 중요도 점수에 의존하고, 정보 보존에 대한 이론적 근거가 부족하다는 문제점을 인식한다. 이를 해결하기 위해 저자들은 Information Bottleneck(IB) 프레임워크를 모델 구조 압축에 직접 적용한다. IB는 입력 X와 출력 Y 사이의 상호 정보 I(X;Y)를 유지하면서, 중간 표현 Z와 입력 X 사이의 상호 정보 I(X;Z)를 최소화하는 최적화 목표를 제시한다. VLM에서는 멀티모달 어텐션 헤드와 Feed‑Forward Network(FFN)가 주요 구조적 요소이며, 각각이 입력 이미지와 텍스트 토큰 사이의 의미적 연결을 담당한다.

헤드 중요도 측정에 InfoPrune은 두 가지 통계량을 도입한다. 첫째, 각 어텐션 헤드의 출력 분포에 대한 엔트로피 기반 유효 랭크(eRank)를 계산한다. eRank는 헤드의 출력 행렬 A에 대한 특이값 σ_i를 이용해 eRank = exp(−∑_i p_i log p_i) (여기서 p_i = σ_i / ∑_j σ_j) 로 정의되며, 높은 eRank는 정보가 고르게 분산된 헤드를 의미한다. 둘째, 원본 모델과 후보 압축 모델 사이의 출력 분포 차이를 Kolmogorov‑Smirnov 거리로 정량화한다. KS 거리 D_KS는 두 누적 분포 함수 F_original, F_compressed 의 최대 절대 차이로, 값이 작을수록 구조적 변형이 원본의 통계적 특성을 잘 보존한다는 뜻이다.

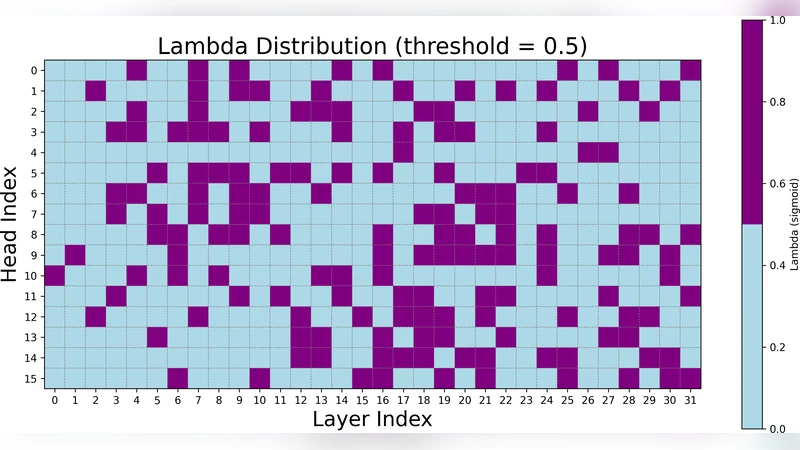

이 두 지표를 가중합한 통합 프루닝 스코어 S = λ·eRank + (1−λ)·(1−D_KS) 를 정의하고, λ는 작업 특성에 따라 조정한다. 학습 기반 헤드 프루닝 단계에서는 전체 손실 L = L_task + β·∑_heads (1−S) 을 최소화한다. 여기서 L_task는 VQA 등 다운스트림 태스크의 교차 엔트로피 손실이며, β는 정보 손실 규제 강도이다. 최적화 과정에서 스코어가 낮은 헤드를 순차적으로 마스크하고, 마스크된 헤드에 대한 파라미터는 역전파에서 차단한다.

FFN 압축은 완전 연결 레이어의 가중치 행렬 W 에 대해 적응형 저‑랭크 근사를 적용한다. 저자들은 SVD 기반 근사 대신, 목표 정보 손실 ΔI = I(X;Z)−I(X;Ẑ) 을 직접 최소화하는 방법을 제안한다. 구체적으로, 각 레이어마다 허용 가능한 ΔI 임계값을 설정하고, 그 이하가 되도록 최소 차원 r 을 선택한다. 이 과정은 사전 훈련된 모델에 대해 한 번만 수행되며, 추가 학습 없이 바로 배포 가능하다.

실험 결과는 세 가지 벤치마크(VQAv2, TextVQA, GQA)에서 FLOP를 평균 3.2배, 지연 시간을 1.8배 줄이면서 정확도 손실을 0.5% 이하로 유지함을 보여준다. Ablation study에서는 λ와 β의 민감도 분석, eRank와 KS 거리 각각을 단독 사용했을 때의 성능 저하를 확인해, 두 지표의 결합이 정보 보존에 필수적임을 입증한다. 또한, 기존 헤드 중요도 기반 프루닝(예: L1‑norm, Grad‑CAM) 대비 1.3%~2.1% 높은 정확도를 기록한다.

이러한 설계는 정보 이론적 근거를 바탕으로 구조적 압축을 수행함으로써, 대규모 VLM을 제한된 연산·메모리 환경에 효율적으로 적용할 수 있는 길을 연다. 다만, 현재는 Transformer 기반 VLM에만 적용 가능하고, 복합적인 멀티모달 어키텍처(예: CLIP‑Fusion, Flamingo)에는 추가적인 확장이 필요하다.