멀티 이미지 융합으로 제어 가능한 3D 자산 생성 Fuse3D

초록

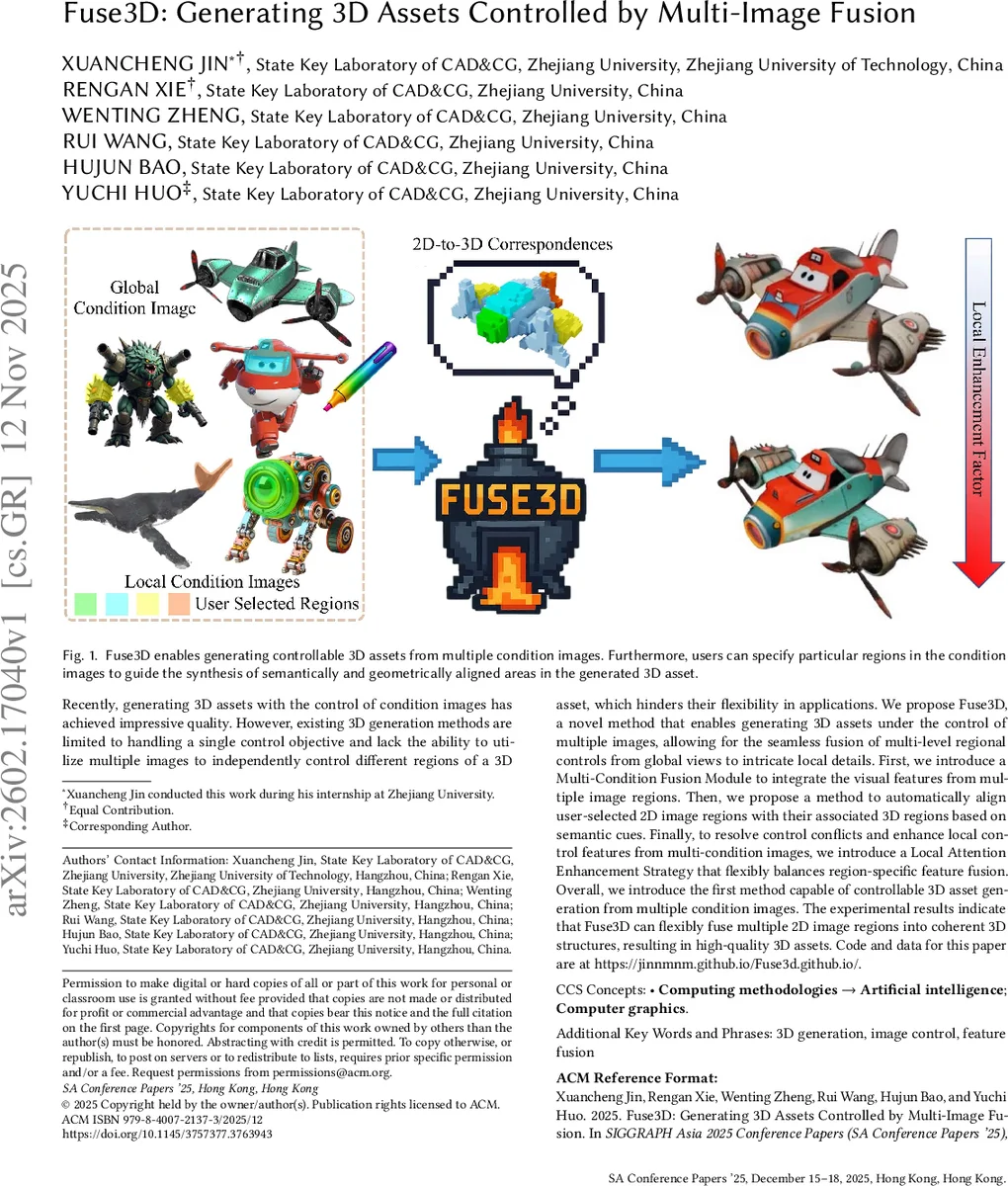

Fuse3D는 여러 장의 조건 이미지에서 선택된 영역을 자동으로 3D 공간에 매핑하고, 이를 다중 조건 융합 모듈과 지역‑주의 강화 전략으로 결합해 전역부터 세부까지 자유롭게 제어 가능한 3D 모델을 빠르게 생성한다.

상세 분석

Fuse3D는 기존 3D 생성 모델이 단일 이미지 혹은 전역 텍스트 조건에만 의존하던 한계를 극복한다는 점에서 의미가 크다. 핵심 기술은 세 가지로 나뉜다. 첫째, DINOv2 기반의 Multi‑Condition Fusion Module(MCFM)은 사용자가 지정한 2D 마스크를 이용해 각 이미지 영역의 시맨틱·위치 토큰을 추출하고, 마스크 가중치를 통해 토큰을 정밀히 결합한다. 이 과정에서 토큰 간의 공간 일관성을 유지하면서도 서로 다른 이미지가 제공하는 디테일을 손실 없이 보존한다. 둘째, TRELLIS의 cross‑attention 구조를 활용한 3D Semantic‑Aware Alignment Strategy는 전역 이미지로부터 얻은 저해상도 voxel 흐름과 지역 이미지 토큰 사이의 양방향 매핑을 수행한다. 전방 매핑은 지역 토큰을 해당 voxel에 연결하고, 역방향 매핑은 전역 토큰을 아직 매핑되지 않은 voxel에 할당함으로써 전체 3D 구조에 균형 잡힌 제어 신호를 분배한다. 셋째, Local Attention Enhancement는 앞서 얻은 2D‑3D 대응 관계를 기반으로 region‑specific attention 스케일링을 적용한다. 이는 서로 겹치는 제어 영역 간 충돌을 완화하고, 중요한 지역 특징을 강조하면서도 부드러운 블렌딩을 가능하게 한다. 모델은 TRELLIS의 SLaT latent 공간에 직접 조건 토큰을 주입하고, VAE 디코더를 통해 최종 메쉬·텍스처를 복원한다. 실험에서는 20초 이내의 추론 시간에 전역 형태와 세부 디테일을 동시에 만족하는 고품질 3D 자산을 생성함을 보였다. 그러나 현재는 사용자 마스크 입력에 크게 의존하고, DINOv2와 TRELLIS의 사전 학습 모델에 종속적이며, 복잡한 장면이나 다중 객체에 대한 확장성 검증이 부족한 점이 한계로 남는다. 전반적으로 Fuse3D는 2D 이미지 기반 지역 제어를 3D 생성에 자연스럽게 연결한 최초의 시도이며, 향후 인터랙티브 디자인·AR/VR 콘텐츠 제작 등에 큰 파급 효과를 기대한다.

댓글 및 학술 토론

Loading comments...

의견 남기기