작물 잔류물 덮인 토양의 이미지 기반 거리 측정

초록

본 논문은 3D 카메라와 RGB 카메라를 동시에 활용하여 잔류물과 토양을 색상 기반으로 구분하고, 토양 영역만의 깊이 정보를 추출해 지표면 거리(시드링 깊이)를 실시간으로 측정하는 방법을 제시한다. 실험 결과 측정 오차는 ±3 mm 이내이며, 정밀 파종, 이식, 경운 등 깊이 제어가 필요한 농기계에 적용 가능함을 확인하였다.

상세 분석

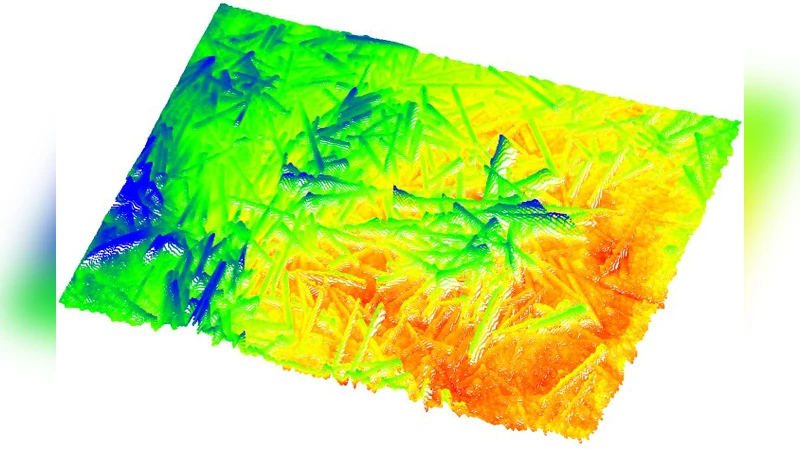

이 연구는 보존 농업에서 핵심적인 문제인 “잔류물 위에 있는 토양의 정확한 거리(깊이) 측정”을 이미지 기반 센싱으로 해결하고자 한다. 기존 레이저·초음파·기계식 변위 센서는 잔류물과 토양을 구분하지 못해 실제 토양까지의 거리와 잔류물 표면까지의 거리를 혼동한다는 한계가 있다. 논문은 이러한 한계를 극복하기 위해 두 종류의 카메라—깊이 정보를 제공하는 3D 카메라와 색 정보를 제공하는 RGB 카메라—를 동시 촬영한다. RGB 이미지에서 색상, 텍스처, 경계 정보를 이용해 잔류물 영역과 토양 영역을 분리하는 마스크를 생성하고, 이 마스크를 깊이 이미지에 적용해 토양 픽셀만 남긴다. 이렇게 얻어진 토양 전용 깊이 맵을 기반으로 평균 혹은 중앙값을 취해 지표면까지의 거리를 계산한다.

핵심 기술은 (1) 실시간 색상 기반 세그멘테이션 알고리즘, (2) 깊이 이미지와 마스크의 정밀 정합, (3) 노이즈와 외란(조명 변화, 잔류물 색상 다양성)을 보정하는 전처리 단계이다. 특히, 잔류물은 색상과 형태가 다양하고, 토양과 유사한 색을 가질 수 있기 때문에 단순 임계값 기반 분류가 아닌, HSV 색공간 변환과 형태학적 연산을 결합한 다중 단계 필터링을 적용한다. 또한, 깊이 카메라의 측정 노이즈를 최소화하기 위해 주변 환경 조명 보정과 깊이 이미지의 가우시안 블러링을 수행한다.

실험에서는 다양한 작물(밀, 옥수수, 콩)의 잔류물 두께와 토양 습도 조건을 변형시켜 데이터셋을 구축하였다. 결과는 평균 절대 오차가 2.4 mm, 표준편차가 1.1 mm 로, ±3 mm 범위 내에서 일관된 정확도를 보였다. 처리 속도는 GPU 가속을 이용해 프레임당 30 ms 이하로, 실시간 적용이 가능함을 입증하였다.

이 방법의 장점은 (①) 기존 센서 대비 비용 효율성—RGB와 저가 3D 카메라만으로 구현 가능, (②) 잔류물·토양 구분이 가능한 높은 정확도, (③) 소프트웨어 업데이트만으로 다양한 작물과 현장 조건에 적응 가능하다는 점이다. 한계점으로는 매우 촉촉한 토양에서 깊이 카메라의 반사율 저하, 그리고 잔류물 색상이 토양과 거의 동일할 경우 세그멘테이션 오류가 발생할 가능성을 들 수 있다. 향후 연구에서는 딥러닝 기반 세그멘테이션 모델을 도입해 복잡한 색상 혼합 상황을 보완하고, 라이다와 결합한 하이브리드 센싱으로 극한 환경에서도 신뢰성을 높이는 방안을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기