LLM 기반 시간적 사용자 프로파일링의 효과와 한계

초록

본 논문은 대형 언어 모델(LLM)을 활용해 사용자의 단기·장기 선호를 자연어 요약으로 분리하고, 이를 BERT 임베딩과 어텐션 융합으로 통합해 추천 정확도와 투명성을 동시에 향상시키는 방법을 제안한다. 영화·TV와 비디오 게임 두 도메인에서 실험한 결과, 사용자 활동이 활발한 영화·TV 분야에서는 Recall@10과 NDCG@10에서 각각 17%·14%의 개선을 보였으며, 활동이 적은 게임 분야에서는 개선 폭이 제한적이었다. 또한, 생성된 텍스트 프로파일과 어텐션 가중치를 통해 추천 근거를 설명할 수 있는 내재적 해석 가능성을 제공한다.

상세 분석

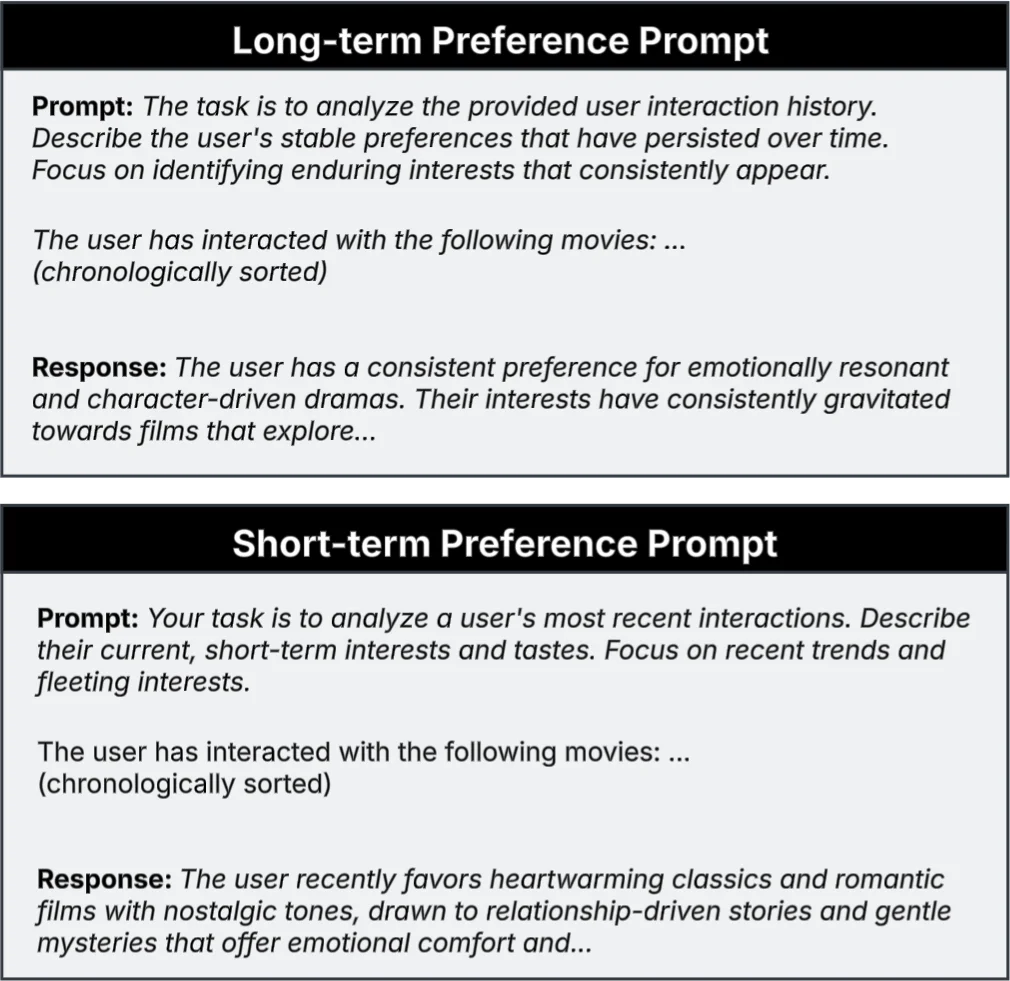

본 연구는 기존의 사용자 프로파일링이 단기와 장기 선호를 구분하지 못하고 평균화된 임베딩에 의존하는 한계를 지적한다. 이를 극복하기 위해 저자들은 각 사용자의 전체 인터랙션 히스토리를 두 차례 LLM에 입력하여(짧은 기간을 강조하는 프롬프트와 전체 기간을 강조하는 프롬프트) 각각 단기·장기 선호를 자연어 텍스트로 요약한다. 이 텍스트는 사전학습된 BERT(MiniLM‑L6‑v2) 모델을 통해 384‑차원 벡터로 변환되고, 학습 가능한 어텐션 레이어를 통해 가중치 αshort와 αlong을 계산한다. 최종 사용자 임베딩은 αshort·rshort + αlong·rlong 형태로 결합되며, 아이템 임베딩과 결합해 MLP에 입력해 상호작용 확률을 예측한다.

실험 설정은 Amazon의 Movies&TV와 Video Games 두 도메인을 사용했으며, 각각 평균 프로파일 길이가 11.79와 4.55로 차이를 보인다. 베이스라인으로는 단순 평균 임베딩(Centric), 인기 기반, 행렬분해(MF), 그리고 텍스트 없이 시간 융합만 수행하는 Temp‑Fusion을 선정했다. 결과는 Movies&TV에서 LLM‑TP가 Centric 대비 Recall@10 17%, NDCG@10 14% 향상을 기록했으며, Temp‑Fusion보다도 우수했다. 반면 Video Games에서는 Recall@20에서만 소폭 우위가 있었고, 다른 지표에서는 Temp‑Fusion이 더 좋은 성능을 보였다. 이는 사용자 활동 빈도가 낮을수록 선호가 안정적이며, 단기·장기 구분이 크게 의미가 없다는 가설을 뒷받침한다.

또한, 어텐션 가중치가 학습 과정에서 자동으로 조정되어 단기와 장기 선호의 상대적 중요도를 드러낸다. 이는 모델이 “최근에 본 영화”와 “오랫동안 좋아한 장르” 중 어느 쪽에 더 의존했는지를 해석 가능하게 만든다. 텍스트 프로파일 자체도 인간이 읽을 수 있는 형태이므로, 향후 사용자에게 직접 설명을 제공하는 인터페이스와 연결하기에 적합하다.

한계점으로는 LLM 호출 비용과 추론 지연이 크게 증가한다는 점이다. 특히 대규모 서비스 환경에서는 실시간 프로파일 생성이 부담이 될 수 있다. 또한, 텍스트 요약의 품질이 도메인마다 다를 수 있으며, 프롬프트 설계가 성능에 민감하게 작용한다는 점도 주목할 필요가 있다. 향후 연구에서는 경량화된 LLM(예: distil‑LLM) 적용, 프롬프트 자동 최적화, 그리고 사용자 설문을 통한 설명 만족도 평가가 제안된다.

전반적으로 본 논문은 LLM을 이용한 시간적 사용자 프로파일링이 높은 사용자 활동 도메인에서 추천 정확도와 해석 가능성을 동시에 개선할 수 있음을 실증했으며, 도메인 특성에 따른 적용 가능성을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기