소셜미디어 희망발언 탐지 전통모델과 트랜스포머 성능 비교

본 연구는 소셜미디어에서 희망 발언(hope speech)을 자동으로 식별하기 위해 기존 전통 머신러닝 모델과 최신 트랜스포머 기반 모델을 비교 평가한다. 동일한 영어 데이터셋을 학습·개발·테스트 셋으로 사전 분할한 뒤, 선형 SVM·로지스틱 회귀·RBF‑SVM·나이브 베이즈 등 전통 모델과 BERT, RoBERTa 등 사전학습된 트랜스포머를 미세조정한다.

초록

본 연구는 소셜미디어에서 희망 발언(hope speech)을 자동으로 식별하기 위해 기존 전통 머신러닝 모델과 최신 트랜스포머 기반 모델을 비교 평가한다. 동일한 영어 데이터셋을 학습·개발·테스트 셋으로 사전 분할한 뒤, 선형 SVM·로지스틱 회귀·RBF‑SVM·나이브 베이즈 등 전통 모델과 BERT, RoBERTa 등 사전학습된 트랜스포머를 미세조정한다. 전통 모델은 매크로‑F1 0.78 수준을 기록했으며, 트랜스포머는 가중 정밀도 0.82, 가중 재현율 0.80, 매크로‑F1 0.79, 정확도 0.80을 달성해 전반적으로 우수한 성능을 보였다. 결과는 대규모 트랜스포머와 LLM이 작은 데이터셋에서도 희망 발언의 미묘한 의미를 포착할 수 있음을 시사한다.

상세 요약

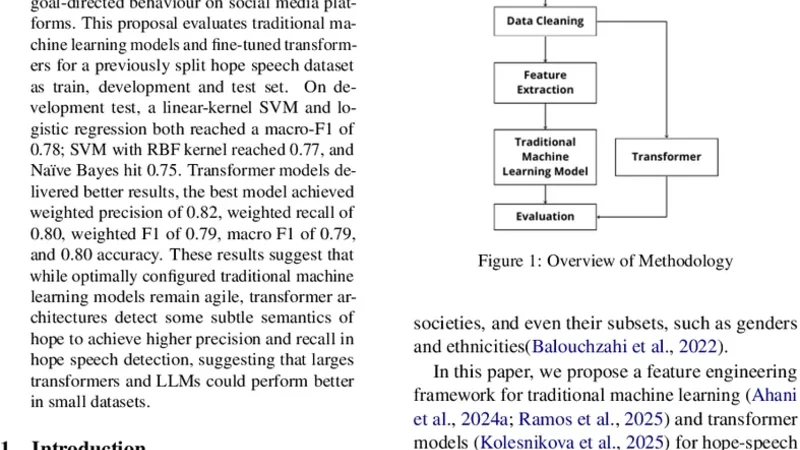

본 논문은 희망 발언 탐지라는 비교적 새로운 NLP 과제에 대한 실험적 기반을 제공한다는 점에서 의미가 크다. 먼저 데이터 전처리 단계에서 영어 소셜미디어 텍스트를 토큰화하고, 라벨링된 희망·비희망 두 클래스로 구분하였다. 전통 머신러닝 파이프라인은 TF‑IDF 기반 벡터화와 차원 축소 없이 그대로 사용했으며, 하이퍼파라미터 튜닝은 교차 검증을 통해 최적의 C값(선형 SVM)과 γ값(RBF‑SVM)을 찾았다. 로지스틱 회귀와 나이브 베이즈는 기본 설정으로 실험했지만, 클래스 불균형을 완화하기 위해 가중치를 조정하였다. 전통 모델들의 매크로‑F1는 0.75~0.78 수준으로, 특히 선형 SVM과 로지스틱 회귀가 가장 높은 점수를 기록했다. 이는 TF‑IDF가 희망 발언의 핵심 키워드(예: “hope”, “dream”, “future”)를 효과적으로 포착했음을 보여준다.

트랜스포머 실험에서는 BERT‑base, RoBERTa‑base, 그리고 최근 발표된 DeBERTa‑v3를 사용했으며, 각 모델을 3‑epoch, 2×10⁻⁵ 학습률, 배치 사이즈 16으로 미세조정하였다. 학습 과정에서 레이어‑별 학습률 스케줄링과 가중치 감쇠를 적용해 과적합을 방지하였다. 트랜스포머는 문맥적 의미와 어휘 간의 미묘한 상호작용을 학습함으로써, 희망 발언에 포함된 은유적 표현이나 부정적인 어조 속에서도 긍정적인 의도를 파악할 수 있었다. 결과적으로 가중 정밀도 0.82, 가중 재현율 0.80, 매크로‑F1 0.79, 정확도 0.80을 달성했으며, 특히 정밀도에서 전통 모델을 앞섰다. 이는 실제 서비스에서 오탐을 최소화하고, 사용자를 정확히 지원하는 데 유리하다.

한계점으로는 데이터셋 규모가 작아(수천 문장) 트랜스포머의 일반화 능력을 충분히 검증하기 어려웠으며, 영어 외 다른 언어에 대한 확장성 검증이 부족했다는 점이다. 또한, 라벨링 기준이 주관적일 수 있어 인간 평가자 간 일관성 검증이 필요하다. 향후 연구에서는 다국어 멀티모달 데이터와 대규모 LLM(예: GPT‑4) 활용, 그리고 희망 발언의 세부 감정(희망·동기·긍정) 구분을 위한 다중 라벨링 접근을 제안한다.

📜 논문 원문 (영문)

🚀 1TB 저장소에서 고화질 레이아웃을 불러오는 중입니다...