도시 마이크로모빌리티를 위한 비전 언어 액션 모델 UrbanVLA

초록

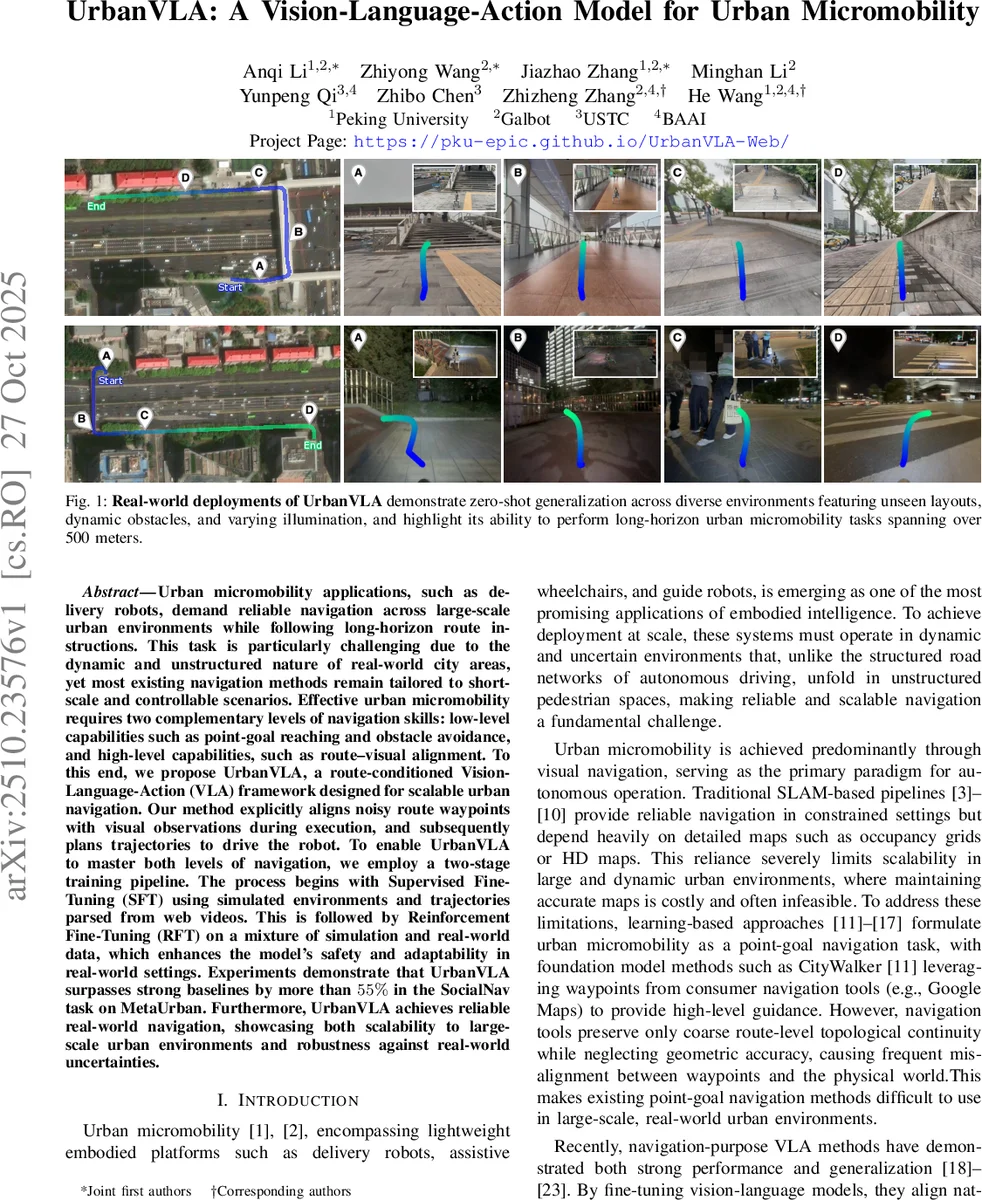

UrbanVLA는 고수준 경로(roadbook)를 시각 관측과 정렬해 로봇이 장거리 도시 환경을 안전하게 주행하도록 설계된 비전‑언어‑액션 프레임워크이다. 시뮬레이션·웹 영상 데이터로 감독학습(SFT)하고, 시뮬‑실 데이터에 IQL 기반 강화학습(RFT)을 적용해 장애물 회피·보행자 상호작용·교통 규칙 준수를 강화한다. MetaUrban의 SocialNav 테스트에서 55 % 이상 성능 향상을 기록했으며, 실제 500 m 이상 길이의 도시 구간에서도 제로샷 일반화를 입증한다.

상세 분석

UrbanVLA는 기존 도시 내 로봇 내비게이션이 직면한 두 가지 근본적 한계를 동시에 해결한다. 첫째, 고수준 네비게이션 툴(예: 구글 맵)에서 제공되는 거친 경로 정보를 ‘roadbook’ 형태의 구조화된 언어 명령으로 변환하고, 이를 시각 입력과 교차 정렬한다는 점이다. 논문에서는 경로를 일정 거리 간격(d = 2 m)으로 샘플링하고, 코너 검출을 통해 블록 단위 거리·방향 힌트를 추출해 템플릿에 삽입한다. 이렇게 만든 언어 토큰 EL과 멀티뷰 RGB 시퀀스(Ovis)를 각각 DINOv2·SigLIP 기반 비전 인코더와 Qwen2 LLM 백본에 입력해, 언어·시각 토큰을 통합한 상태 표현 s를 만든다.

둘째, 두 단계 학습 파이프라인이다. SFT 단계에서는 메타버스 시뮬레이터(MetaUrban)와 웹 영상( Sekai)에서 얻은 전문가 궤적을 활용한다. 여기서 핵심은 ‘Heuristic Trajectory Lifting(HTL)’이다. 실제 궤적은 노이즈와 불규칙성을 포함하므로, Savitzky‑Golay 필터로 평활화하고, 코너 검출 후 가우시안 잡음을 주입해 고수준 경로를 추출한다. 이렇게 만든 (roadbook, 시각, 목표 궤적) 삼중항을 MSE 손실로 학습함으로써, 모델이 순수히 시각적 단서에 의존하도록 유도한다.

RFT 단계에서는 시뮬‑실 혼합 데이터에 IQL(Implicit Q‑Learning)을 적용한다. IQL은 오프라인 RL에서 과도한 Q값 추정 문제를 완화하고, OOD 샘플에 대한 보수적 업데이트를 제공한다. 보상 함수는 (1) 궤적 효율성(거리·시간 최소화)과 (2) 안전성(충돌·보행자 위반·교통 신호 위반 페널티)을 동시에 고려한다. 결과적으로 모델은 장애물 회피, 보행자 양보, 신호등 준수 등 복합적인 사회적 규범을 내재한다.

실험에서는 MetaUrban‑test와 MetaUrban‑unseen 두 벤치마크에서 기존 NavFoM·CityWalker 기반 베이스라인 대비 55 %·56 %의 성공률 향상을 보였다. 특히 ‘SocialNav’ 과제에서 장거리(>500 m) 경로를 따라도 목표 도착률이 0.78에 달했으며, 실세계 로봇(3 kg 배달 로봇) 테스트에서도 동적 보행자와 조명 변화에 강인한 주행을 구현했다.

주요 기여는 (1) 최초의 경로‑조건화 VLA 설계, (2) HTL을 통한 시뮬‑실 데이터 정규화, (3) IQL 기반 안전 강화 학습이다. 한계로는 현재 고정된 카메라 배열에 의존하고, 복합적인 교통 규칙(예: 일방통행·자전거 전용 차선)까지는 완전히 다루지 못한다는 점이다. 향후 다중 센서 융합과 규칙 기반 추론 모듈을 결합하면 더욱 일반화된 도시 마이크로모빌리티가 가능할 것이다.

댓글 및 학술 토론

Loading comments...

의견 남기기