특징 추출 기반 확산 모델로 구현하는 인간‑AI 인터랙티브 댄스 생성

초록

본 논문은 단일 인물 모션 캡처 데이터를 활용해, 저주파 움직임은 인간 파트너를 따라가고 고주파 움직임은 확산 모델이 창의적으로 생성하도록 설계된 인터랙티브 댄스 생성 시스템을 제안한다. EDGE 기반의 디노이징 확산 모델에 ILVR 스타일 전이와 모션 인페인팅을 결합해 실시간으로 움직임을 이어가며, 저주파‑고주파 분리를 통해 유연한 모방 강도와 다양성을 조절한다. 평가에서는 생성된 모션의 특징 분포가 테스트 세트와 수렴함을 보이며, 인간 파트너와의 동기화 및 창의적 편차를 동시에 달성한다.

상세 분석

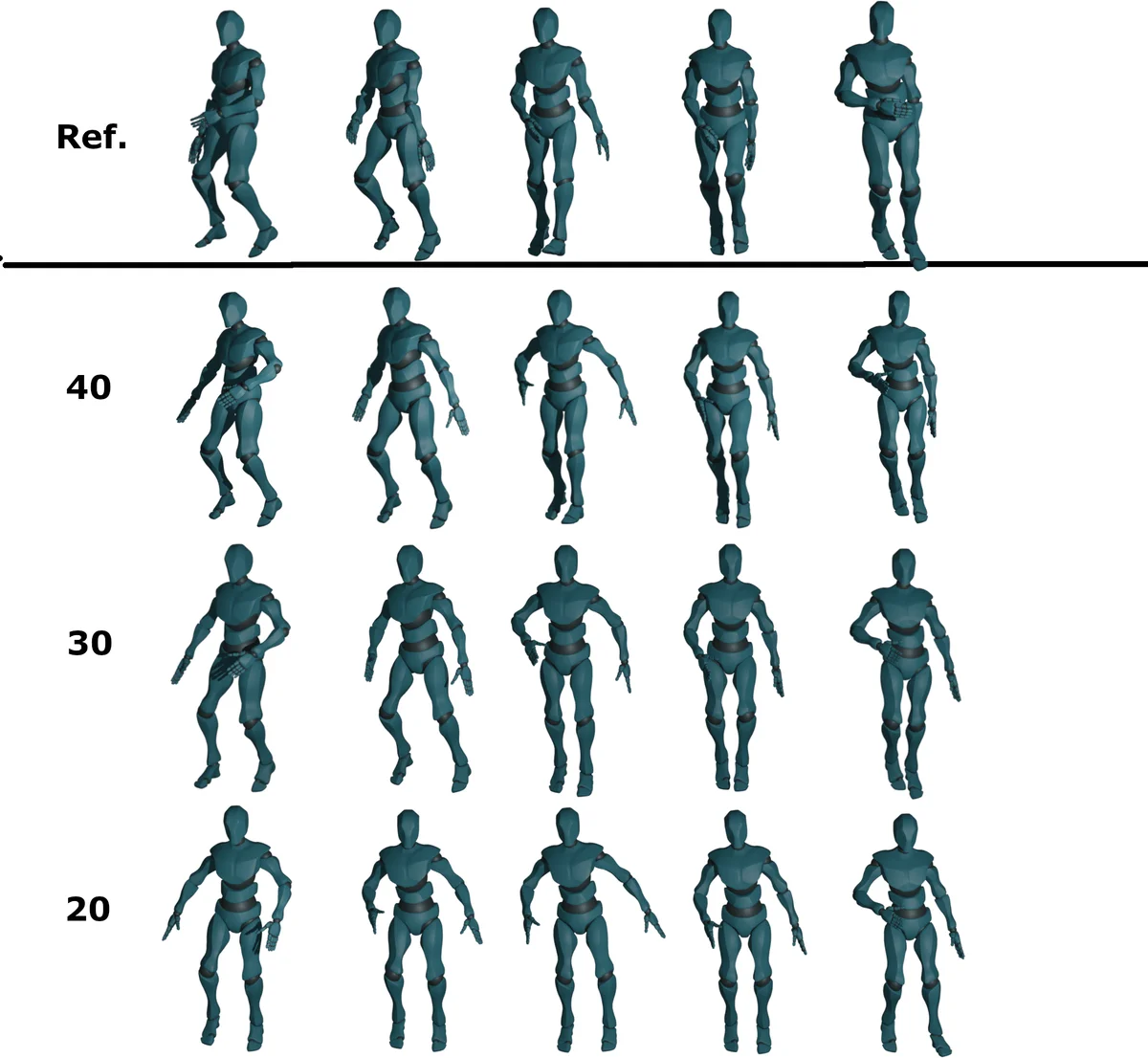

이 연구는 기존 듀엣 데이터에 의존하는 인간‑인간 협동 모델의 한계를 극복하고자, 단일 인물 모션 데이터만을 이용해 인간‑AI 파트너십을 구현한다는 점에서 혁신적이다. 핵심 아이디어는 입력된 모션 시퀀스를 저주파와 고주파 성분으로 분해하고, 저주파는 그대로 따라가면서 고주파는 디노이징 확산 모델(EDGE)을 통해 새롭게 샘플링한다는 것이다. 이를 위해 저주파를 추출하는 저역통과 필터(φ_L)와 고역통과 필터(φ_H)를 적용하고, ILVR(Iterative Latent Variable Refinement) 과정을 통해 목표 레퍼런스 모션의 저주파 성분을 단계별로 재삽입한다. ILVR의 반복 횟수는 ‘모방 강도’를 정량적으로 조절할 수 있게 해 주며, 실험 결과 일정 횟수 이상에서는 유사도 향상이 포화되고 다양성은 유지되는 것을 확인한다.

또한, 모션 인페인팅 기법을 활용해 현재 시점까지 관찰된 인간 파트너의 움직임을 시퀀스의 앞부분에 고정하고, 뒤쪽을 자연스럽게 이어가는 방식으로 시간적 일관성을 확보한다. 이는 기존의 마크오프 기반 샘플링보다 효율적인 DDIM(Deterministic Diffusion Implicit Models) 스케줄을 사용해 추론 속도를 20배 가량 가속화하면서도 품질 저하를 방지한다.

보조 손실로는 속도 손실과 발 접촉 손실을 도입해 관절 진동을 억제하고 바닥 미끄러짐을 방지함으로써 물리적 현실성을 높였다. 전체 학습 목표는 L_total = L_denoise + λ_vel·L_vel + λ_fc·L_fc 형태이며, λ 값은 EDGE 구현과 동일하게 설정한다.

평가에서는 AIST++ 데이터셋을 사용해 다양성 지표(FID, Diversity)와 파트너 정렬 지표(Alignment Score)를 측정했으며, 생성된 모션의 특징 분포가 테스트 세트와 통계적으로 수렴함을 보였다. 특히, ILVR 단계 수를 조절함으로써 ‘따라하기’와 ‘창의적 변형’ 사이의 트레이드오프를 실시간으로 제어할 수 있다는 점이 실용적인 인터랙션 설계에 큰 장점을 제공한다.

한계점으로는 현재 실시간 인터랙션을 위한 지연 시간이 아직 연구 단계 수준이며, 복합적인 음악-동작 동기화나 다중 파트너 상황에 대한 확장성이 부족하다. 향후 연구에서는 멀티모달 조건(음악, 감정)과 더 큰 규모의 단일 인물 데이터셋을 활용해 모델의 일반화 능력을 강화하고, 하드웨어 최적화를 통해 실시간 공연 수준의 응답성을 달성하는 것이 목표이다.

댓글 및 학술 토론

Loading comments...

의견 남기기