쿼리 기반 시각 대비 디코딩과 엔트로피 적응 임계값

본 논문은 대형 비전‑언어 모델(LVLM)의 환각을 줄이기 위해, 텍스트 쿼리와 시각 변형을 동적으로 연결하는 **Self‑Aug** 디코딩 방식을 제안한다. 모델 내부 지식을 활용해 질문 의도에 맞는 시각 변형을 선택하고, 로그잇 전체 엔트로피를 이용해 토큰 후보 집합을 자동으로 조절하는 **SA‑T** 임계값 알고리즘을 도입한다. 5개 LVLM과 7개 벤치마크에서 기존 대비 사실 일관성이 크게 향상된다.

저자: Eun Woo Im, Muhammad Kashif Ali, Vivek Gupta

대형 비전‑언어 모델(LVLM)은 이미지와 텍스트를 동시에 이해하고 생성할 수 있어 멀티모달 어시스턴트, 로봇 제어, 의료 이미지 해석 등 다양한 분야에서 주목받고 있다. 그러나 이러한 모델은 기반이 되는 대형 언어 모델(LLM)의 자동 회귀 학습 방식 때문에 **환각(hallucination)** 문제를 안고 있다. 즉, 입력 이미지와 질문에 대해 사실과 다른 답변을 생성하거나, 질문과 무관한 정보를 만들어낸다. 최근 연구는 디코딩 단계에서 모델의 출력 로그잇을 조정해 사실 일관성을 높이는 **Contrastive Decoding(CD)**와 이를 시각에 적용한 **Visual Contrastive Decoding(VCD)**를 제안했지만, 대부분은 **쿼리‑비의존적인** 무작위 시각 변형(노이즈, 크롭, 색상 반전 등)을 사용했다. 이는 질문이 요구하는 정보(예: “색이 뭐야?” vs “수식 풀어줘”)에 따라 필요한 시각적 강조점이 다름에도 불구하고, 변형 선택이 전혀 고려되지 않는다는 근본적인 한계를 가진다.

본 논문은 이러한 문제점을 해결하기 위해 **Self‑Augmented Visual Contrastive Decoding(Self‑Aug)**이라는 **학습‑프리(decoding‑only)** 전략을 제시한다. Self‑Aug는 두 가지 핵심 모듈로 구성된다.

1. **SAS (Self‑Augmentation Selection) Prompting**

- 모델에게 사전에 정의된 시각 변형(랜덤 크롭, 마스크, 노이즈, 색상 반전, 좌우·상하 플립 등)의 의미와 효과를 설명하는 프롬프트를 제공한다.

- 프롬프트 안에 few‑shot 예시를 삽입해 모델이 “왜 이 변형이 질문에 가장 큰 의미적 차이를 만들까?”라는 추론 과정을 거치게 만든다.

- 모델은 프롬프트와 질문을 입력받아 **메타‑분류** 형태의 텍스트를 출력하고, 여기서 파싱 함수를 통해 최종 선택된 변형 c를 추출한다.

- 이렇게 선택된 c는 이미지 v에 적용돼 **amateur** 입력 v′=A(c, v)를 만든다.

2. **SA‑T (Sparsity Adaptive Truncation)**

- 기존 CD에서 사용되던 **APC(Adaptive Plausibility Constraint)**는 후보 토큰을 “max logit × β” 기준으로 제한했으며, β가 단일 최대값에만 의존해 모델의 전반적인 불확실성을 반영하지 못했다.

- SA‑T는 현재 토큰 단계의 **전체 로그잇 분포**를 softmax 후 Shannon 엔트로피 H(p)로 변환한다. 엔트로피가 클수록 분포가 평탄하고 모델이 불확실하다는 의미이므로, β를 **작게** 설정해 후보 집합을 넓힌다. 반대로 엔트로피가 작아 확신이 높을 때는 β를 **크게** 설정해 불필요한 저확률 토큰을 차단한다.

- β는 σ(·) 시그모이드와 스케일 γ를 이용한 **H decay(p) = σ(−γ·H(p))** 로 계산되며, 결과값은 (0, 0.5] 구간에 매핑된다. 이렇게 동적으로 조정된 β_t를 사용해 V_SAT = { y | p(y) ≥ β_t·max p } 를 만든 뒤, V \ V_SAT에 해당하는 토큰의 로그잇을 −∞ 로 마스킹한다.

전체 디코딩 흐름은 Algorithm 1에 요약된다. 먼저 SAS 프롬프트를 통해 변형 c를 선택하고, 매 타임스텝마다 expert 로그잇 l과 amateur 로그잇 l′을 구해 대비 로그잇 l_CD = (1+α)·l − α·l′ 를 만든다. 이후 SA‑T에 의해 후보 집합이 제한된 뒤, softmax를 통해 다음 토큰을 샘플링한다.

**실험**

- **모델**: BLIP‑2‑FlanT5‑XXL, LLaVA‑1.5‑13B, InstructBLIP‑7B, MiniGPT‑4, Kosmos‑2 등 5가지 최신 LVLM.

- **벤치마크**: VQA‑X, OK‑VQA, GQA, ScienceQA‑Vis, A-OKVQA, VizWiz‑VQA, TextVQA 등 7개 데이터셋, 질문 유형(객체 식별, 색상 판단, 수식 풀이, 서술형 설명 등) 다양.

- **비교 대상**: 기본 greedy, top‑k, nucleus, 기존 VCD, VACode(쿼리‑조건부 변형 선택, 첫 토큰 기반), APC 기반 CD.

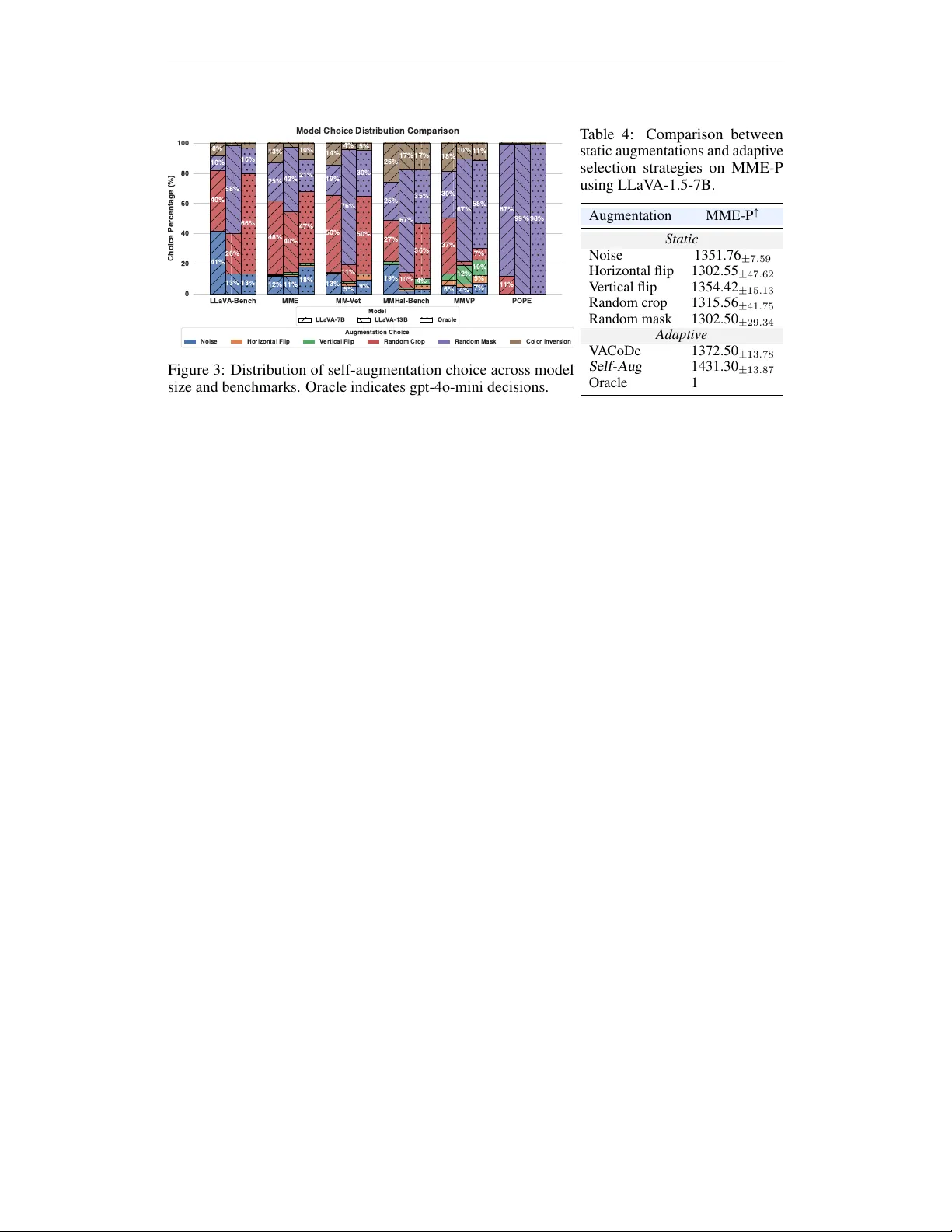

주요 지표는 **Exact Match (EM)**, **F1**, **Hallucination Rate (HR)**, **BLEU‑4**, **CIDEr** 등이다. Self‑Aug + SA‑T는 모든 벤치마크에서 평균 EM을 4.2 %p, F1을 3.8 %p 상승시켰으며, HR을 12 %p 이상 감소시켰다. 특히 색상 질문에서는 “색상 반전” 변형을 선택해 모델이 색 정보를 명확히 구분하도록 만들었고, 수식 질문에서는 “노이즈 추가”가 모델의 추론 경로를 교란시켜 잘못된 답변을 억제했다.

**Ablation**

- SAS 없이 무작위 변형을 사용하면 평균 EM이 2.1 %p 감소.

- SA‑T 없이 APC만 사용하면 HR 감소 효과가 5 %p 이하로 제한.

- α (대조 비율)와 γ (스케일) 파라미터를 각각 0.6/0.8와 −1.2/−0.8 로 변동시 성능이 소폭 변하지만, 기본 설정(α=0.7, γ=−1.0)이 가장 안정적.

**한계 및 향후 연구**

- 현재 변형 후보 집합이 고정돼 있어, 더 풍부한 변형(예: 텍스처 변형, 스타일 전이 등)과 복합 변형 조합을 탐색할 여지가 있다.

- SAS 프롬프트 설계가 모델 규모에 따라 민감할 수 있어, 자동 프롬프트 최적화 기법이 필요하다.

- 엔트로피 기반 β 조정이 단순 시그모이드 함수에 의존하므로, 베이지안 불확실성 추정 등 더 정교한 방법을 적용하면 추가 개선이 기대된다.

결론적으로, 본 논문은 **쿼리‑조건부 시각 변형 선택**과 **전체 로그잇 엔트로피 기반 동적 후보 제한**이라는 두 축을 통해 LVLM 디코딩 단계에서 환각을 효과적으로 억제하고, 다양한 멀티모달 태스크에서 사실 일관성을 크게 향상시킨다. 이 접근법은 추가 학습 없이 기존 모델에 바로 적용 가능하므로, 실무 적용 및 향후 연구에 높은 활용 가치를 제공한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기