경량형 실어증 전용 자동음성인식 프레임워크 ASASR

초록

**

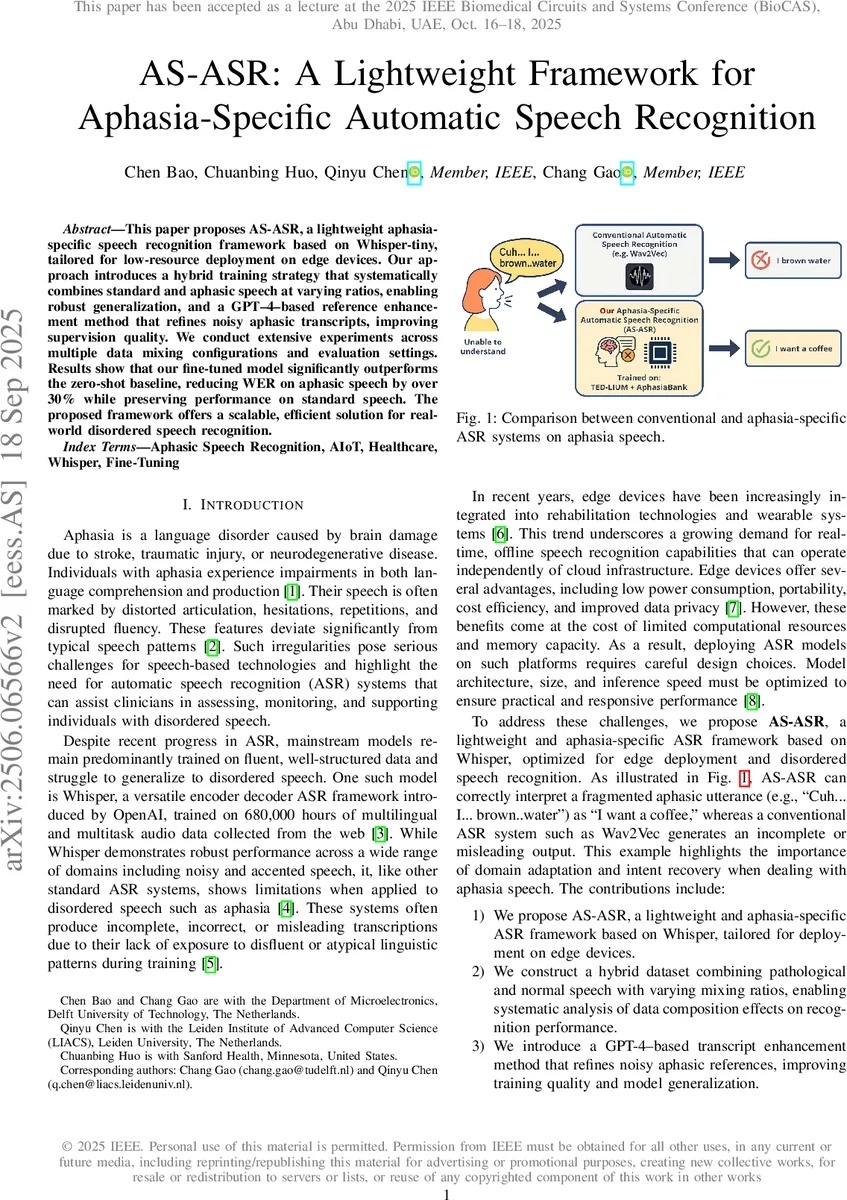

본 논문은 Whisper‑tiny 모델을 기반으로 실어증 환자 음성을 인식하도록 경량화하고, 표준 음성·실어증 음성을 다양한 비율로 혼합한 하이브리드 학습과 GPT‑4를 이용한 전사 보강 기법을 도입한다. 실험 결과, 파인튜닝된 모델은 제로샷 기준 대비 실어증 음성에서 30 % 이상 WER를 감소시키면서도 표준 음성 성능을 유지한다.

**

상세 분석

**

AS‑ASR은 현재 상용 ASR이 정상 발화에 최적화돼 실어증과 같은 언어 장애 음성에 취약한 점을 해결하고자 설계되었다. 핵심 설계는 세 가지 축으로 나뉜다. 첫째, 모델 선택 단계에서 Whisper‑tiny‑en(약 39 M 파라미터, 1 GB VRAM 요구)을 채택함으로써 엣지 디바이스(예: Jetson Nano)에서도 실시간 추론이 가능하도록 했다. 이는 기존 Whisper‑large와 같은 수백 MB 규모 모델에 비해 10배 가량 빠른 추론 속도를 제공한다.

둘째, 데이터 구성 전략이다. AphasiaBank에서 추출한 5개 서브코퍼스와 TED‑LIUM v2를 각각 14 000개 세그먼트 규모로 맞춘 뒤, 10 %:90 %부터 90 %:10 %까지 5가지 비율로 혼합하였다. 각 비율마다 훈련·검증·테스트를 80 %:10 %:10 %로 동일하게 분할해 비교 가능성을 확보했다. 이 과정에서 “Hybrid Data Fine‑tuning Strategy”가 제시되며, 실어증 음성의 특수한 발화 패턴(불완전, 반복, 끊김 등)을 모델이 학습하도록 설계되었다.

셋째, 전사 보강 단계이다. AphasiaBank 원본 전사는 .cha 포맷으로 제공되며, 비언어적 표기와 청크 마크업이 다량 포함돼 있다. 저자들은 GPT‑4에 “문맥을 유지하면서 표준 영어 문장으로 교정하라”는 프롬프트를 전달해, 의미를 변형하지 않는 수준에서 문법·유창성을 개선한 보강 전사를 생성한다. 표 Ⅱ의 사례에서 보듯, 일부 경우 과도한 보강이 원 발화의 진단적 특징을 소실시킬 위험이 있음을 인지하고, 보강 전사와 원본 전사를 병행 사용한다는 점이 실용적이다.

실험 결과는 크게 두 부분으로 나뉜다. Baseline‑2에서는 Whisper‑large가 실어증 데이터에서 가장 낮은 WER(0.622)를 기록했지만, 메모리·연산 요구량이 현저히 높아 엣지 배포에 부적합함을 확인했다. 반면 Whisper‑tiny‑en은 0.787이라는 다소 높은 WER에도 불구하고, 파인튜닝 후 실어증 테스트에서 0.4300.454로 크게 개선되었다. 특히, 표 Ⅴ에서 보듯 표준 TED‑LIUM 테스트에서는 성능 저하가 거의 없으며(0.116 vs 0.119), 혼합 도메인에서도 0.1620.170 수준으로 안정적인 결과를 보여준다.

데이터 비율 분석(Fig. 2)에서는 실어증 비중이 증가할수록 실어증 WER는 감소하지만, 반대로 표준 음성 WER는 서서히 상승한다는 전형적인 트레이드오프가 관찰된다. 50 %:50 % 혹은 70 %:30 % 비율이 두 도메인 모두에서 균형 잡힌 성능을 제공한다는 점은, 실제 임상 현장에서 다양한 발화 상황을 동시에 처리해야 하는 시스템 설계에 중요한 시사점을 제공한다.

마지막으로, 저자들은 향후 임상의 피드백을 통한 전사 보강 품질 검증, 전용 하드웨어 가속기 설계, 그리고 LLM‑기반 실시간 교정 인터페이스 개발 등을 제안한다. 이는 현재 연구가 모델 수준에 머무르지 않고, 실제 의료·재활 현장에 적용 가능한 엔드‑투‑엔드 솔루션으로 확장될 가능성을 시사한다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기