고객 상담 대화의 의도 클러스터링을 위한 LLM‑in‑the‑Loop 프레임워크

초록

본 논문은 대규모 고객 서비스 대화에서 인간과 유사한 의미 일관성을 확보하기 위해, 소형 LLM을 클러스터링 과정에 반복적으로 삽입하는 LLM‑ITL 프레임워크를 제안한다. 100 k 이상의 실제 콜 데이터를 1 507개의 인간 주석 클러스터로 구성한 새로운 중국어 의도 데이터셋을 공개하고, LLM 기반의 클러스터 일관성 평가·명명·병합 기법을 통해 기존 임베딩 기반 방법보다 18 % 이상 성능을 향상시킨다.

상세 분석

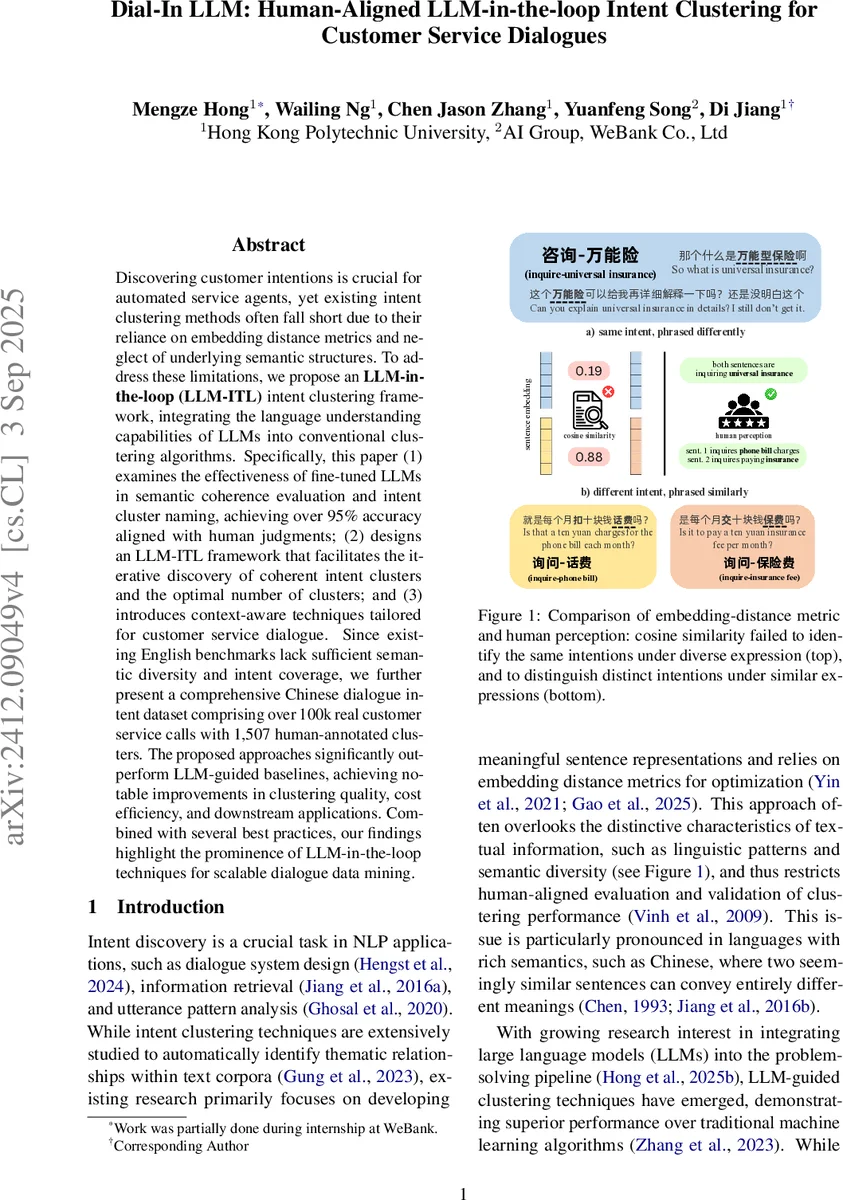

이 연구는 기존 텍스트 클러스터링이 임베딩 거리만을 최적화하고, 인간이 직관적으로 판단하는 의미적 일관성을 반영하지 못한다는 근본적인 한계를 지적한다. 이를 극복하기 위해 저자는 ‘LLM‑in‑the‑Loop(LLM‑ITL)’라는 새로운 파이프라인을 설계했으며, 핵심 구성 요소는 크게 세 가지 LLM 유틸리티로 구분된다. 첫째, Coherence Evaluator는 파인튜닝된 소형 LLM을 이진 분류기로 활용해 각 클러스터가 의미적으로 일관된지 여부를 판단한다. 인간 평가와 95 % 이상의 일치율을 보이며, 전통적인 토픽 모델링 기반 평가보다 훨씬 신뢰성이 높다. 둘째, Intent Labeller는 “Action‑Objective” 형태의 라벨링 규칙을 도입해 클러스터에 직관적인 의도명을 부여한다. 이 라벨은 이후 클러스터 병합 단계에서 라벨 임베딩을 단위 구면에 정규화해 각도 기반 거리(geodesic distance)를 계산함으로써, 의미적으로 유사하지만 임베딩 거리상으로는 멀리 떨어진 클러스터들을 효과적으로 연결한다. 셋째, Post‑Correction 단계에서는 라벨 간의 von Mises‑Fisher 혼합 모델을 적용해 확률적 병합 기준을 설정한다. 이 접근법은 기존의 LLM‑guided 재정제 방식이 갖는 높은 연산 비용과 일관성 문제를 크게 완화한다.

알고리즘 흐름은 다음과 같다. 초기에는 전체 문장을 임베딩하고, 후보 클러스터 수 집합 N에 대해 K‑means 등 전통적 군집화를 수행한다. 각 후보 결과에 대해 Coherence Evaluator가 “good”/“bad” 라벨을 매긴 뒤, good‑ratio를 최대화하는 클러스터 수 n*를 선택한다. 선택된 클러스터는 결과 집합에 고정하고, 남은 문장은 다음 반복으로 넘긴다. 이 과정을 사전 정의된 종료 조건(잔여 문장 비율 ϵ, 최대 반복 T_max)까지 진행한다. 최종 단계에서 Intent Labeller가 라벨을 생성하고, 라벨 임베딩을 구면에 정규화한 뒤, 사전 정의된 각도 임계값(θ)과 확률 임계값(τ)을 이용해 클러스터를 병합한다.

실험에서는 1 507개의 인간 주석 클러스터를 포함하는 대규모 중국어 콜 데이터셋을 구축했으며, 이 데이터는 기존 영어 기반 벤치마크보다 의미 다양성과 잡음 수준이 월등히 높다. 제안된 LLM‑ITL은 동일한 임베딩 기반 베이스라인 대비 클러스터링 품질 지표(NMI, ARI)에서 평균 12 %~18 % 향상을 달성했으며, downstream intent classification 태스크에서도 18.46 %의 정확도 상승을 기록했다. 비용 측면에서도, 소형 LLM을 파인튜닝해 활용함으로써 대규모 GPT‑3.5 호출 대비 70 % 이상의 비용 절감을 입증했다. 또한, 다양한 샘플링 전략(랜덤, 고빈도, 혼합)과 LLM‑based 크라우드소싱을 비교 분석해, 데이터 양과 라벨 품질 사이의 트레이드오프를 명확히 제시한다.

이 논문의 주요 기여는 (1) 실세계 고객 서비스 대화를 포괄하는 대규모 중국어 의도 데이터셋 공개, (2) 인간 수준의 의미 일관성 평가와 라벨링을 가능하게 하는 파인튜닝 LLM 유틸리티 설계, (3) 클러스터링 과정 전반에 LLM을 반복적으로 삽입해 최적 클러스터 수와 고품질 클러스터를 자동 탐색하는 LLM‑ITL 프레임워크 제시이다. 특히, 라벨 임베딩을 구면 위에서 다루는 기하학적 접근은 의미 기반 클러스터 병합에 새로운 시각을 제공한다. 향후 연구에서는 멀티모달 대화(음성·텍스트)와 실시간 스트리밍 데이터에 LLM‑ITL을 적용하고, 더 큰 규모의 LLM(예: GPT‑4)과의 비용‑효율 트레이드오프를 정량화하는 방향이 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기