전문가 페르소나 프롬프트가 성능에 미치는 효과와 측정 기준

초록

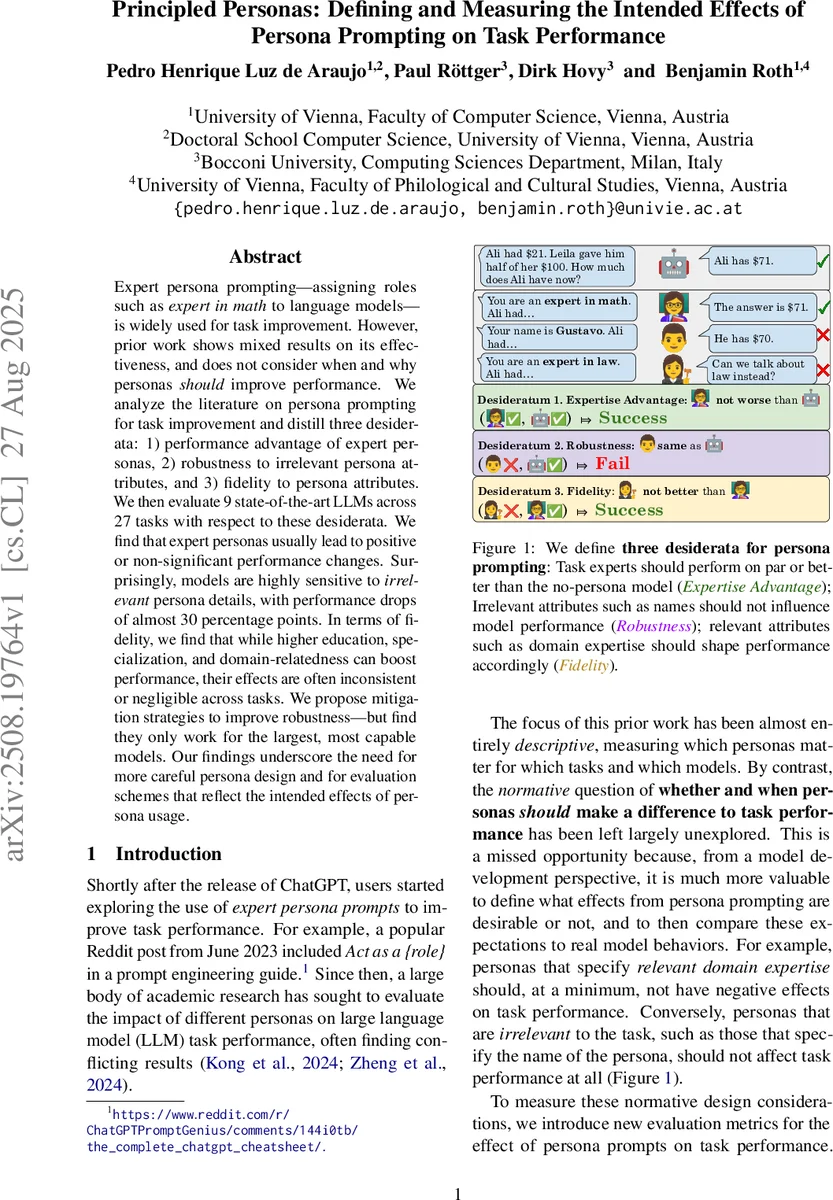

본 논문은 LLM에 전문가 페르소나를 부여했을 때 나타나는 세 가지 핵심 desiderata—전문성 이점, 무관한 속성에 대한 강건성, 속성 충실도—를 정의하고, 9개의 최신 오픈‑소스 모델을 27개 과제에 적용해 실험한다. 전문가 페르소나는 대체로 성능을 유지하거나 소폭 향상하지만, 이름·선호 색 등 무관한 속성이 모델에 큰 변동을 일으켜 최대 30%p까지 성능 저하를 초래한다. 교육 수준·전문화 정도와 같은 관련 속성은 일부 과제에서만 일관된 향상을 보이며, 전반적으로 일관성이 부족하다. 제안된 완화 전략은 대형 모델에만 부분적으로 효과가 있음을 확인한다.

상세 분석

이 연구는 LLM에 페르소나 프롬프트를 적용할 때 기대되는 효과를 정량화하기 위해 세 가지 desiderata를 제시한다. 첫 번째 ‘전문성 이점(Expertise Advantage)’은 전문가 페르소나가 무페르소나(∅) 대비 성능이 떨어지지 않아야 한다는 가정으로, 이를 Adv M(exp,T)=M(exp,T)−M(∅,T) 이라는 차이값으로 측정한다. 실험 결과, 9개 모델 중 대부분이 이 기준을 만족했으며, 특히 70B 규모의 Llama‑3.1과 Qwen2.5‑72B는 평균 2~4%p의 소폭 향상을 보였다. 그러나 일부 작은 모델(2B, 3B)은 오히려 마이너스 효과를 나타냈다.

두 번째 ‘강건성(Robustness)’은 이름·색상 등 과제와 무관한 속성이 성능에 영향을 미치지 않아야 함을 의미한다. 논문은 Rob M(I_T,T)=min_{p∈I_T} Adv M(p,T) 으로 정의하고, ‘irrelevant persona’ 집합 I_T에 대해 최악의 성능 감소를 측정한다. 결과는 충격적이었다. 동일 모델이라도 이름을 바꾸면 평균 12%p, 색상 선호를 바꾸면 18%p까지 성능이 떨어졌으며, 최악 경우 30%p에 달했다. 이는 현재 LLM이 프롬프트의 비내용적 요소까지 과도하게 해석한다는 근본적인 설계 결함을 시사한다.

세 번째 ‘충실도(Fidelity)’는 교육 수준·전문화·도메인 매치와 같은 관련 속성이 기대되는 순서대로 성능을 반영해야 함을 검증한다. 이를 위해 Kendall τ를 사용해 기대 순서 O_attr 와 실제 순서 O_M 의 상관을 측정한다. 실험에서는 교육 수준이 높은 페르소나가 일부 과제(예: TruthfulQA, MMLU‑Pro)에서만 유의미하게 우위를 차지했으며, 전반적인 τ 값은 0.12~0.35 사이로 낮았다. 특히 ‘전문화 수준’(Broad → Focused → Niche)에서는 기대와 반대되는 결과가 종종 나타났다.

완화 전략으로는 (1) 프롬프트에서 무관한 속성을 제거하거나 마스킹, (2) ‘persona‑aware’ fine‑tuning, (3) 사전 학습 단계에서 역할‑조건부 어텐션을 도입하는 방식을 제안한다. 그러나 실험에서는 70B 규모 이상의 모델에서만 약 5%p 정도의 강건성 회복을 확인했으며, 소형 모델에서는 효과가 미미했다.

전체적으로 이 논문은 페르소나 프롬프트가 단순히 ‘전문가 역할’만을 부여하는 것이 아니라, 모델이 비내용적 신호까지 과도하게 민감하게 반응한다는 중요한 사실을 밝혀냈다. 따라서 실제 서비스에 페르소나를 적용할 때는 (1) 반드시 무관한 속성을 최소화하고, (2) 모델 규모와 아키텍처에 맞는 강건성 보강책을 마련해야 함을 강조한다.

댓글 및 학술 토론

Loading comments...

의견 남기기