마스크 자동회귀 확산으로 구현하는 견고하고 제어 가능한 텍스트‑투‑모션

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

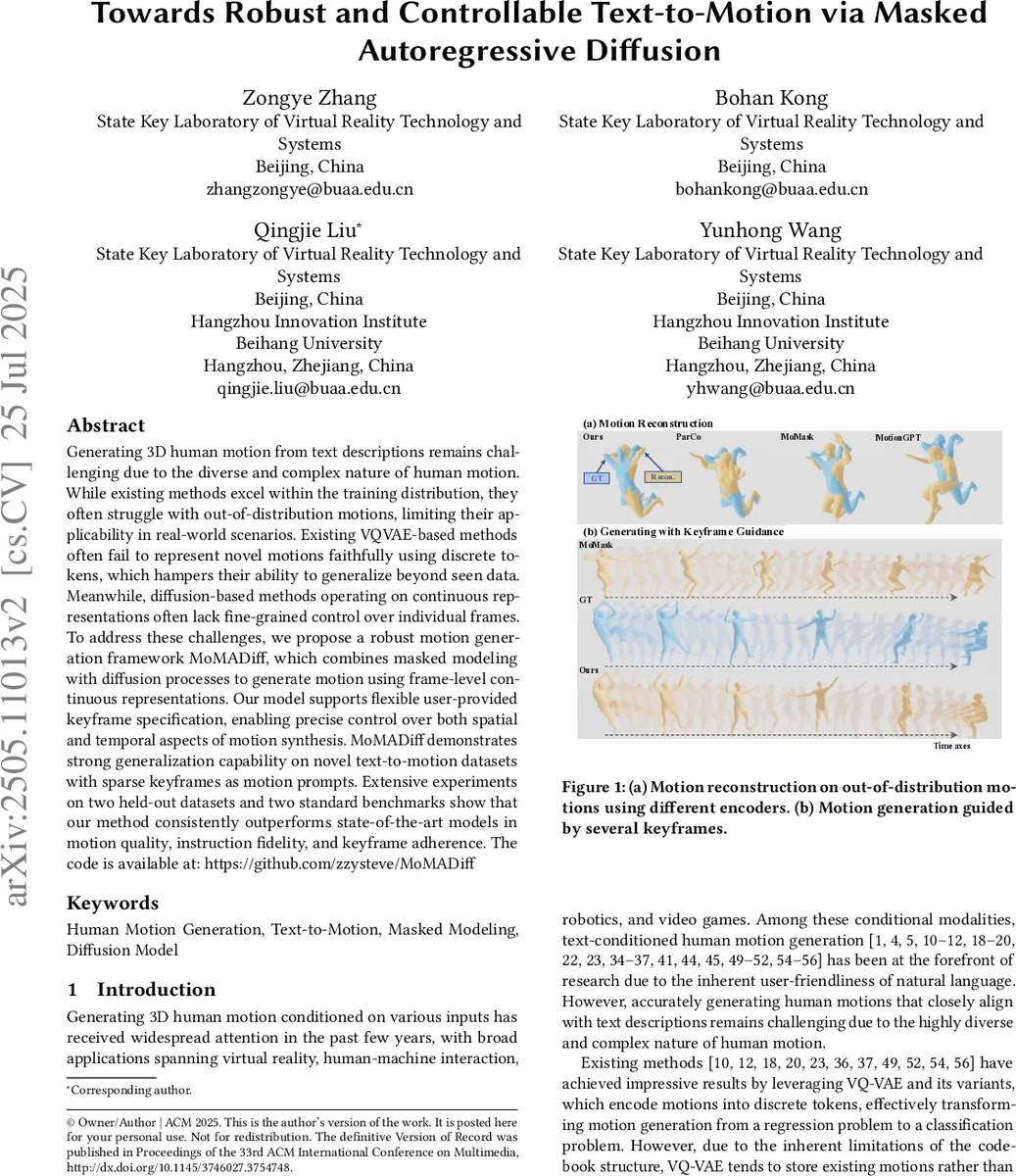

MoMADiff는 프레임 수준의 연속형 잠재 표현을 이용해 텍스트에서 3D 인간 동작을 생성하는 프레임워크이다. 마스크 기반 자동회귀 확산 모델을 도입해 키프레임을 자유롭게 지정할 수 있게 하며, 기존 VQVAE 기반 이산 토큰 방식의 일반화 한계를 극복한다. 실험 결과, 보유 데이터셋과 표준 벤치마크 모두에서 동작 품질, 텍스트 일치도, 키프레임 준수 측면에서 최첨단 방법들을 앞선다.

상세 분석

MoMADiff는 두 가지 핵심 기술을 결합한다. 첫째, 프레임‑단위 연속형 잠재 공간을 제공하는 경량 CNN 기반 Motion VAE를 설계했다. 기존 연구가 전체 시퀀스를 하나의 벡터로 압축하거나 VQ‑VAE를 통해 이산 토큰으로 변환하는 데 비해, 이 VAE는 각 프레임을 독립적인 연속형 벡터(zₜ)로 인코딩하고, 평균·분산 파라미터(μ,σ)를 통해 확률적 샘플링을 수행한다. 이는 재구성 손실(NLL), KL 발산, 관절 속도 손실을 동시에 최적화함으로써 시각적 정확성과 물리적 부드러움을 동시에 확보한다.

둘째, 마스크 자동회귀 확산 모델(MoMADiflusion)은 이러한 연속형 토큰을 입력으로 받아, 무작위 마스크 토큰(

댓글 및 학술 토론

Loading comments...

의견 남기기