ApproxGNN 기반 근사 컴퓨팅 설계 탐색 자동화

초록

본 논문은 ApproxGNN이라는 사전 학습된 그래프 신경망(GNN) 모델을 제안한다. ApproxGNN은 근사 가산기 라이브러리에서 추출한 임베딩을 활용해 회로 수준의 QoR(품질)과 하드웨어 비용을 빠르게 예측한다. 기존 방법은 회로마다 새로 학습이 필요했지만, 제안된 모델은 소량의 근사 부품 데이터만으로도 다양한 회로에 전이 학습 없이 적용 가능하며, 임베딩 기반 특징 추출로 예측 정확도가 30%~54% 향상된다.

상세 분석

ApproxGNN은 근사 컴퓨팅 설계 공간 탐색(DSE)에서 가장 큰 병목인 정확도·하드웨어 비용 예측 문제를 그래프 신경망으로 해결한다. 핵심 아이디어는 두 단계 모델링이다. 첫 번째 단계는 Approximate Component Embedding Model로, 각 근사 가산기의 RTL 구조와 동작 특성을 입력으로 받아 고차원 임베딩을 생성한다. 기존 연구가 평균 절대 오차(MAE), 최악 오차 등 정량적인 오류 지표에 의존한 반면, 임베딩은 회로의 논리 토폴로지와 전파 지연, 전력 소비 패턴까지 포괄적으로 학습한다. 이를 위해 저자들은 Verilog 파서를 구현해 RTL 코드를 노드·엣지 형태의 그래프로 변환하고, PyTorch Geometric 기반 GNN(메시지 패싱 + Readout)으로 임베딩을 학습한다. 두 번째 단계는 Parameter Prediction Model이다. 여기서는 회로 전체 그래프와 사전 계산된 부품 임베딩을 결합해, QoR(근사 오차)과 HW 비용(면적·전력·지연)을 동시에 회귀한다. 모델은 다중 태스크 학습(MTL) 구조를 채택해 두 목표를 공유 파라미터로 학습함으로써 일반화 능력을 크게 높였다.

데이터 생성 측면에서 저자들은 EvoApproxLib의 다양한 근사 가산기를 조합해 합성 이미지 필터(블러, Sobel 등) 회로를 자동 생성하고, 각 조합에 대해 완전 합성·시뮬레이션을 수행해 라벨을 획득했다. 이 과정은 기존 AutoAx가 요구하던 4,000개의 무작위 바인딩 대비 30% 정도만 사용해도 충분한 학습 효과를 보였다. 또한, 임베딩을 사전에 저장함으로써 새로운 회로에 대한 예측 시점에 추가적인 합성 비용이 거의 발생하지 않는다.

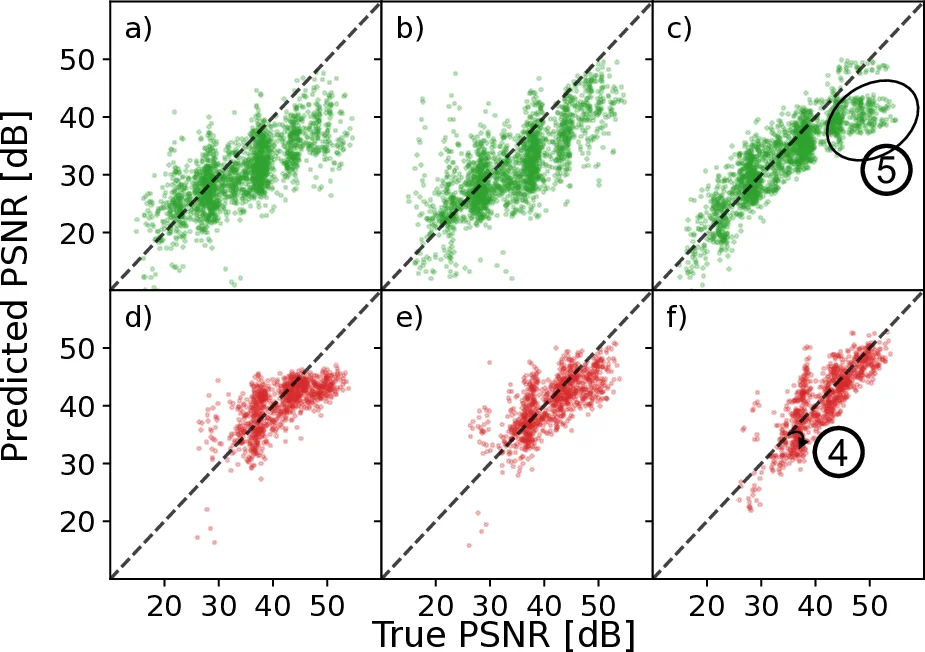

실험 결과는 세 가지 관점에서 의미 있다. 첫째, 동일한 테스트 셋에 대해 기존 통계 기반 ML(Random Forest, Decision Tree) 대비 MSE가 50% 감소했다. 둘째, ApproxPilot과 같은 최신 GNN 기반 방법보다 30% 높은 전체 예측 정확도를 기록했으며, 빠른 파인튜닝(fine‑tuning)만으로도 54%까지 향상시켰다. 셋째, 파인튜닝 없이 바로 사용할 수 있는 사전 학습 모델은 설계자에게 “즉시 사용 가능한 서프라이즈”를 제공한다는 점에서 실용성이 크게 부각된다.

한계점으로는 현재 라이브러리가 가산기 중심이며, 곱셈기·비트연산 등 다른 근사 연산에 대한 확장성이 아직 검증되지 않았다는 점이다. 또한, GNN 구조가 그래프 규모가 커질수록 메모리·시간 복잡도가 급증할 수 있어, 대규모 ASIC 설계에 적용하려면 샘플링 기법이나 계층적 GNN이 필요할 것으로 보인다.

종합하면 ApproxGNN은 근사 회로 설계에서 “재학습 없이 재사용 가능한 서프라이즈 모델”을 구현함으로써 DSE 전체 흐름을 60% 이상 가속화하고, 예측 정확도를 현저히 높이는 중요한 진보를 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기