기하학적 일관성 레이 디퓨전을 통한 포즈 프리 표면 재구성

초록

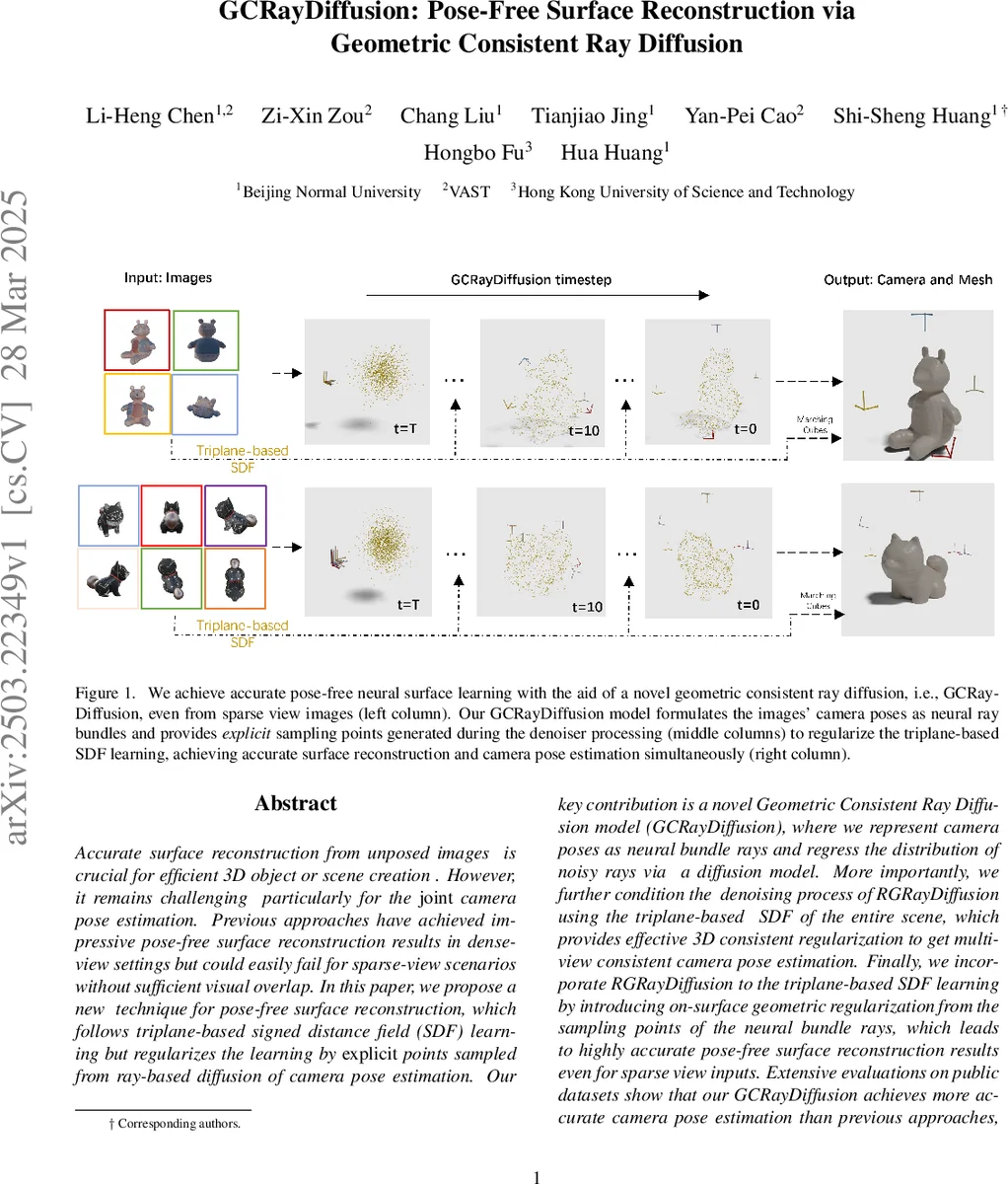

본 논문은 카메라 포즈가 알려지지 않은 상황에서도, 희소한 뷰 이미지들만으로 정확한 3D 표면을 복원하는 새로운 프레임워크를 제안한다. 트리플레인 기반 SDF 학습에 레이 기반 디퓨전 모델을 결합해, 신경 번들 레이를 이용해 카메라 포즈를 추정하고, 그 과정에서 얻어진 샘플 포인트를 표면 학습에 정규화 신호로 활용한다. 실험 결과, 기존 SfM·디퓨전 기반 방법보다 희소 뷰에서도 더 정밀한 포즈와 일관된 메시를 얻는다.

상세 분석

GCRayDiffusion은 크게 세 가지 핵심 아이디어로 구성된다. 첫째, 기존 6DoF 카메라 파라미터를 직접 회귀하는 대신, 각 이미지에 대해 ‘신경 번들 레이(Neural Bundle Ray)’라는 7차원 벡터 집합을 도입한다. 이 벡터는 레이 방향(v), 모멘트(m = p × v) 그리고 깊이(d) 정보를 포함해, 레이의 끝점 r_d = d·v + p 를 명시적으로 계산할 수 있게 한다. 깊이 정보를 추가함으로써 레이와 표면 사이의 교차점을 직접 추적할 수 있어, 카메라 포즈와 SDF 사이에 미분 가능한 연결 고리를 제공한다.

둘째, 레이 집합에 대한 노이즈 주입·제거 과정을 디퓨전 모델로 정의한다. 시간 단계 t에 따라 가우시안 노이즈 β_t 를 적용해 R_t = √ᾱ_t R_0 + √(1‑ᾱ_t) ε 로 노이즈화하고, 역과정에서 denoiser g_φ가 현재 노이즈 레이 R_t와 단계 t, 이미지 특징 F_I, 그리고 현재 SDF F_θ(R_d_t) 를 조건으로 삼아 원래 노이즈 ε̂ 를 예측한다. 여기서 핵심은 ‘기하학적 일관성’이다. 기존 PoseDiffusion·RayDiffusion은 이미지 특징만을 조건으로 삼아 레이 분포를 복원했지만, GCRayDiffusion은 전역 SDF 값을 추가 조건으로 사용한다. 전역 SDF는 장면 전체의 3D 구조를 내포하고 있어, 레이의 위치가 실제 물체 표면에 근접하도록 강제한다. 결과적으로 다중 뷰 간의 정합성이 크게 향상되고, 희소 뷰에서도 안정적인 번들 조정이 가능해진다.

셋째, 디퓨전 과정에서 생성된 레이의 끝점 r_d 를 직접 활용해 SDF 학습에 정규화 신호를 제공한다. 구체적으로, r_d 를 트리플레인 기반 SDF에 쿼리해 해당 위치의 signed distance 값을 얻고, 이를 이용해 on‑surface loss(예: Eikonal 손실 및 표면 제약)를 강화한다. 이렇게 하면 카메라 포즈 추정과 표면 재구성이 서로 피드백 루프를 형성해, 포즈 오류가 표면 오류로 전파되는 것을 방지하고, 반대로 정확한 표면이 포즈 추정에 더 강력한 기하학적 가이드를 제공한다.

실험에서는 Objaverse와 Google Scanned Object 데이터셋을 사용해 COLMAP, RelPose++, PoseDiffusion, RayDiffusion 등과 비교하였다. 특히 58장의 희소 뷰 상황에서 평균 포즈 회전 오류가 23도, 위치 오류가 2~4 cm 수준으로 크게 개선되었으며, 정량적인 Chamfer‑L1 및 F‑score에서도 기존 방법을 앞섰다. 시각적으로도 잡음이 적고, 세밀한 디테일을 보존한 메쉬를 얻었다.

한계점으로는 (1) 레이 샘플링 수와 디퓨전 단계 T에 따라 메모리·연산 비용이 급증할 수 있다는 점, (2) 현재는 정적 장면에만 적용 가능하고 동적 씬이나 복합 재질(반사·투명)에는 추가 연구가 필요하다는 점을 들 수 있다. 향후 연구에서는 효율적인 레이 선택 전략, 가변 단계 디퓨전, 그리고 멀티스케일 트리플레인 구조를 도입해 실시간 혹은 대규모 씬에 확장하는 방향이 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기