요약오차 기반 근사베이지안 계산의 수렴과 라데마허 복잡도

본 논문은 요약통계 없이 경험분포 간 차이를 이용하는 Approximate Bayesian Computation(ABC) 방법의 이론적 기반을 통합적으로 제시한다. 적분확률반거리(IPS) 클래스에 속하는 다양한 차이함수(워싱턴 거리, MMD 등)를 함수군의 라데마허 복잡도와 연결시켜, 비독립·비동질 데이터와 모델 오차 상황에서도 일관된 수렴 및 농축 경계치를 제공한다.

저자: Sirio Legramanti, Daniele Durante, Pierre Alquier

이 논문은 현대 통계·머신러닝에서 복잡한 모델의 사후분포를 추정하기 위해 널리 사용되는 Approximate Bayesian Computation(ABC)의 요약‑프리( summary‑free) 접근법에 대한 통합 이론을 제시한다. 전통적인 ABC는 데이터 요약통계에 의존하지만, 요약 선택이 어려워 정보 손실을 초래한다는 한계가 있다. 이를 극복하고자 최근 경험분포 간 차이를 직접 측정하는 방법들이 제안되었으며, 대표적으로 최대 평균 차이(MMD), 워싱턴 거리, 에너지 통계량 등이 있다. 그러나 기존 이론은 각 차이함수마다 별도 가정을 필요로 하고, 데이터 생성 과정이나 모델에 대한 정규성 조건을 강제하는 경우가 많아 일반화에 한계가 있었다.

저자들은 이러한 문제를 해결하기 위해 두 가지 핵심 개념을 도입한다. 첫째, 차이함수 Δ를 적분확률반거리(Integral Probability Semimetric, IPS) 형태 D_F(·,·)로 정의한다. 여기서 F는 차이함수를 특성화하는 함수군이며, 워싱턴 거리의 경우 Lipschitz 함수군, MMD의 경우 재현 커널 힐베르트 공간의 단위볼을 선택한다. 둘째, 함수군 F의 라데마허 복잡도 R_n(F)를 분석 도구로 사용한다. 라데마허 복잡도는 경험분포와 실제분포 사이의 차이를 측정하는 함수군의 학습 난이도를 정량화하며, 복잡도가 작을수록 경험분포가 실제분포를 잘 근사한다는 의미이다.

논문은 먼저 IPS와 라데마허 복잡도 사이의 기본 관계를 정리한다. 경험분포 ˆµ_y와 ˆµ_z에 대한 차이 Δ(ˆµ_z,ˆµ_y)=D_F(ˆµ_z,ˆµ_y)는 다음 부등식으로 상한을 갖는다.

Δ(µ_θ,µ_*) ≤ Δ(ˆµ_z,ˆµ_y) + 2R_n(F) + o_p(1)

즉, 실제 모형 µ_θ와 데이터 생성 과정 µ_* 사이의 거리(목표 거리)는 관측된 경험거리와 라데마허 복잡도의 두 배에 의해 제어된다.

이를 바탕으로 두 가지 ABC 허용오차 스케줄을 분석한다.

1) 고정 허용오차 ε_n: 이 경우 사후분포가 지원하는 파라미터 집합은 {θ: Δ(µ_θ,µ_*) ≤ ε_n + 2R_n(F)} 로 제한된다. 라데마허 복잡도가 0으로 수렴하면, 고정 ε_n이 실제 모델과 동일한 수준의 제어를 제공한다는 것을 의미한다.

2) 수축 허용오차 ε_n → 0: 여기서는 ε_n과 R_n(F) 모두가 0으로 가는 속도를 비교한다. 저자들은 R_n(F)가 O(1/√n) 이하인 경우, ε_n이 n^{-1/2}보다 빠르게 감소하면 사후분포가 θ* (최소 거리 파라미터) 주변에 빠르게 농축된다는 정량적 수렴 속도를 제시한다.

특히, MMD와 같은 커널 기반 IPS는 유계 커널을 가정하면 라데마허 복잡도가 정확히 O(1/√n)임을 기존 학습 이론에서 인용한다. 따라서 MMD 기반 ABC는 기존 연구에서 요구하던 복잡한 정규성 가정 없이도 일관된 수렴을 보장한다. 반면, 워싱턴 거리와 같이 무한공간에서 정의되는 경우, 라데마허 복잡도가 데이터의 순간조건(예: 1차 모멘트)과 연관되므로 추가적인 가정이 필요하다.

비독립·비동질 데이터에 대해서도 저자들은 β‑mixing 과정에 대한 라데마허 복잡도 확장을 적용한다. Mohri와 Rostamizadeh(2008)의 결과를 이용해, 복합 의존 구조를 가진 데이터에서도 R_n(F)의 상한을 구하고, 동일한 수렴·농축 결과를 도출한다.

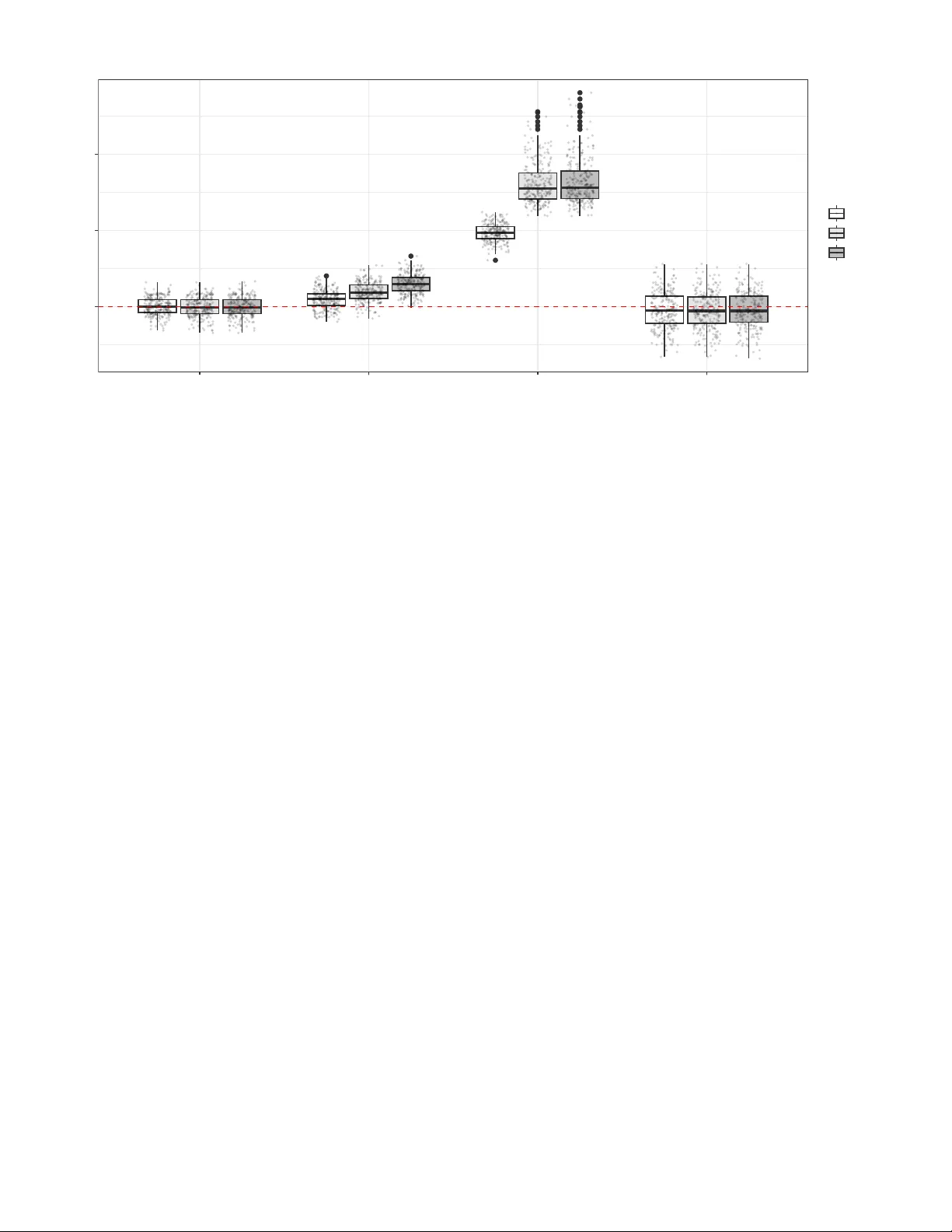

실험 부분에서는 MMD와 워싱턴 거리 두 가지 차이함수를 사용해 다양한 시뮬레이션을 수행한다. 모델이 정확히 지정된 경우와, 모델이 오차를 포함하거나 데이터가 오염된 경우를 모두 고려한다. 결과는 라데마허 복잡도가 작을수록(특히 MMD) 사후분포가 실제 파라미터에 더 가깝게 수렴하고, 허용오차가 수축함에 따라 농축 속도가 이론적 예측과 일치함을 보여준다. 워싱턴 거리의 경우, 데이터가 무한공간에 존재하고 순간조건이 만족되지 않을 때는 수렴이 느려지거나 사후분포가 넓게 퍼지는 현상이 관찰된다.

마지막으로, 저자들은 현재 이론을 f‑divergence와 같은 다른 차이함수에도 확장할 가능성을 논의한다. 또한, 라데마허 복잡도와 베이지안 일반화(Generalized Bayesian Inference) 사이의 연결 고리를 제시하며, 본 프레임워크가 ABC뿐 아니라 다양한 의사후베이지안 방법론에 적용될 수 있음을 강조한다.

전반적으로 이 논문은 요약‑프리 ABC의 수렴 이론을 차이함수의 라데마허 복잡도라는 통일된 지표로 재구성함으로써, 기존 연구의 제한적인 가정들을 완화하고, 검증 가능한 명시적 경계치를 제공한다. 이는 복잡한 모델, 비정규 데이터, 그리고 모델 오차가 존재하는 현실적인 상황에서도 신뢰할 수 있는 베이지안 추론을 가능하게 하는 중요한 이론적 진보이다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기