한 층 신경망의 샘플 복잡도: 대칭·지역성·가중치 공유의 역할

** 본 논문은 하나의 은닉층을 갖는 네트워크에서 대칭(Equivariance), 지역 필터(Locality), 가중치 공유(Weight Sharing)가 샘플 복잡도에 미치는 영향을 통계 학습 이론으로 정량화한다. 활성화 함수가 양의 동차성을 만족하면 필터의 ℓ₂‑노름만으로 차원에 독립적인 상·하한을 얻으며, 최대 풀링과 다층 확장에도 약한 차원 의존성을 보인다. 비대칭 가중치 공유도 특정 조건 하에 대칭 경우와 동등한 일반화 한계를 제공…

저자: Arash Behboodi, Gabriele Cesa

**

본 논문은 현대 딥러닝에서 핵심적인 설계 요소인 가중치 공유(weight sharing), 대칭(equivariant), 그리고 지역 필터(locality)가 샘플 복잡도에 미치는 영향을 정량적으로 분석한다. 저자는 먼저 그룹 컨볼루션을 기반으로 한 1‑hidden‑layer 네트워크를 정의하고, 입력 데이터 x∈ℝ^{d}가 ℓ₂‑노름 ≤ b_x 로 제한된 상황을 가정한다. 네트워크는 (1) 다채널 그룹 컨볼루션 레이어, (2) 점별 비선형 활성화 σ(·) (양의 동차성 가정), (3) 채널‑별 평균 혹은 최대 풀링 레이어, (4) 최종 선형 출력 레이어 로 구성된다.

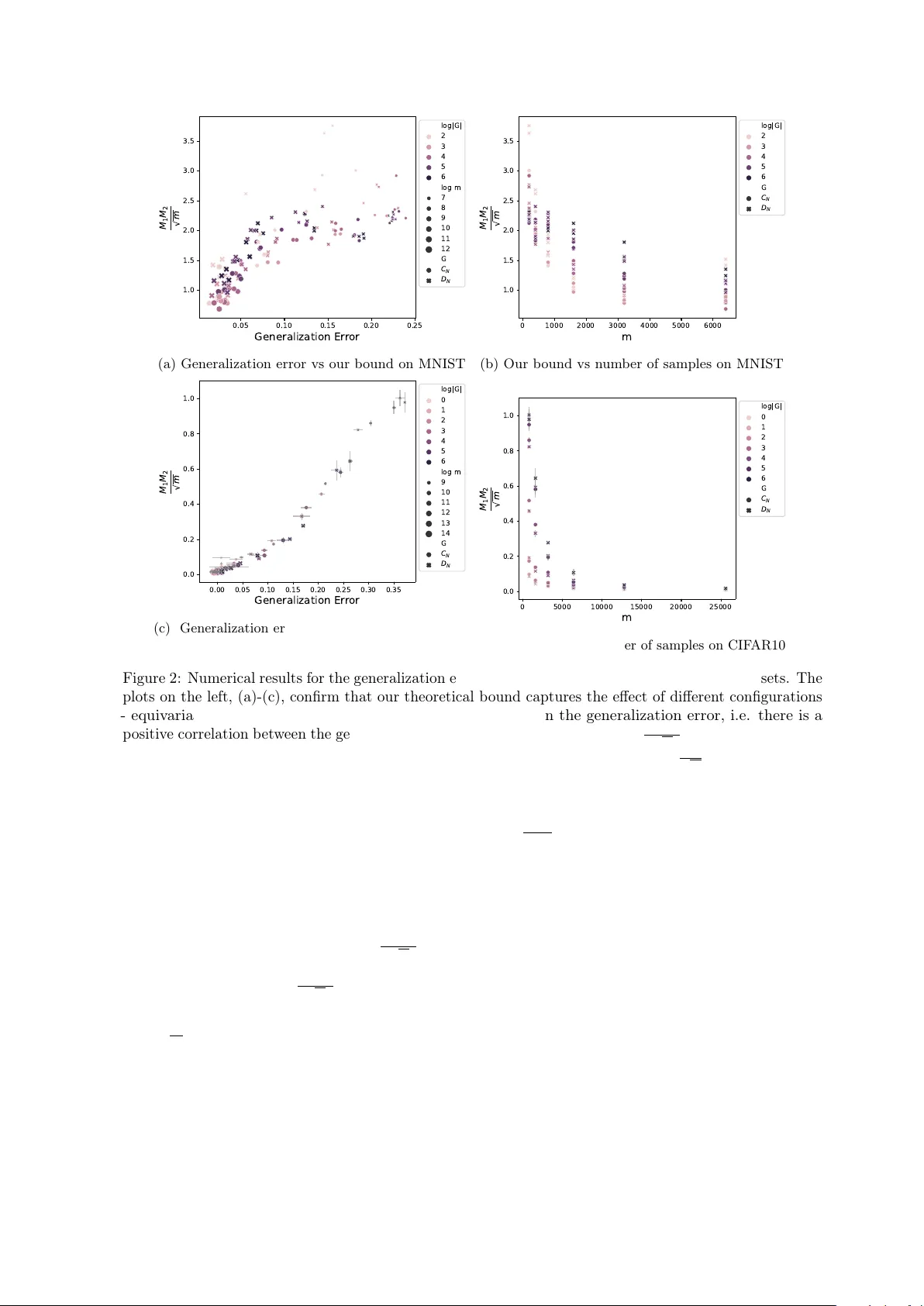

가설 공간 H는 파라미터 u와 w의 ℓ₂‑노름을 각각 M₁, M₂ 로 제한한 집합으로 정의된다. 이때 Rademacher 복잡도 분석을 통해, 일반화 오차 L(h) − ĤL(h)는 O\big((M₁+M₂)·√{(log|G|)/m}\big) 로 상한이 잡힌다. 여기서 m은 학습 샘플 수이며, |G|는 그룹의 원소 개수(예: 2‑D 평면 이동 그룹이면 이미지 크기와 동일)이다. 중요한 점은 입력 차원 d가 전혀 등장하지 않아 차원‑자유(sample‑size independent)라는 점이다.

다음으로, 가중치 공유 메커니즘을 비대칭 형태로 바꾸는 경우를 고려한다. 저자는 각 채널에 독립적인 필터를 할당하되, 전체 파라미터의 ℓ₂‑노름을 동일하게 제한하면, Rademacher 복잡도 상한이 동일하게 유지된다는 정리를 제시한다. 즉, “비대칭 가중치 공유도 특정 조건 하에 대칭(그룹 컨볼루션)과 동일한 샘플 효율을 제공한다”는 결론을 이론적으로 증명한다.

지역성에 대해서는 필터 크기 O (receptive field size)를 도입한다. 필터가 작은 경우, 각 패치가 포함하는 입력 차원 수가 O·|G| 로 제한되며, 복잡도 상한에 추가적인 항 O·|G|·M₂/√{m} 가 등장한다. 이는 작은 지역 필터가 일반화에 이득을 주지만, 동시에 주파수 도메인에서의 표현력은 불확실성 원리(Δx·Δξ ≥ ½) 때문에 제한된다는 물리적 직관과 일치한다. 저자는 이 trade‑off 를 수식적으로 정량화하고, “지역성은 일반화 이득을 제공하지만, 지나치게 작게 하면 표현력이 감소한다”는 실용적인 가이드를 제공한다.

풀링 연산에 대해서는 평균 풀링과 최대 풀링을 모두 분석한다. 평균 풀링은 순열 불변성을 이용해 위의 Rademacher 상한에 영향을 주지 않으며, 차원‑자유성을 유지한다. 최대 풀링은 추가적인 로그‑항(log c₁) 과 |G|에 대한 약한 의존성을 도입하지만, 전체 복잡도는 여전히 O\big((M₁+M₂)·√{(log|G|·log c₁)/m}\big) 수준에 머문다.

다층 네트워크 확장에서는 은닉층 수 L과 각 층의 채널 수 c_l 를 고려한다. 저자는 각 층에 대해 동일한 ℓ₂‑노름 제한을 두고, 전체 Rademacher 복잡도가

\

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기