IoT 디바이스와 5G‑NR 공존을 위한 딥 강화학습 기반 스케줄러

초록

본 논문은 다중 셀 환경에서 5G‑NR 사용자와 NB‑IoT·LTE‑M 디바이스가 동일한 대역폭을 공유할 때 발생하는 인터‑셀 간섭(ICI)을 최소화하면서 자원 블록(RB)과 변조·코딩 스킴(MCS)을 효율적으로 할당하는 딥 강화학습(DRL) 기반 스케줄링 프레임워크를 제안한다. 벤치마크 상한 스케줄러와 비교했을 때, ICI 기반 행동 선택을 이용한 DRL 에이전트가 전력 기반 방식보다 높은 스루풋·공정성·지연 성능을 달성한다.

상세 분석

이 연구는 5G‑NR과 IoT(특히 NB‑IoT와 LTE‑M) 디바이스가 인‑밴드(in‑band) 방식으로 공존하는 복잡한 다중 셀 네트워크를 모델링하고, 두 가지 핵심 문제를 동시에 해결한다. 첫 번째는 각 셀의 서브캐리어(SC)와 MCS를 조합해 순간적인 업링크 스루풋을 최대화하면서도 사용자 간 공정성을 보장하는 ‘벤치마크(상한) 스케줄러’를 수학적으로 정의한다. 이 최적화는 전력 제한, SINR 구간, 그리고 동기화된 RB 할당이라는 제약조건을 포함하며, 실제 도시 환경의 ICI 파라미터를 반영한 시뮬레이션을 통해 거의 최적에 근접한 해를 얻는다.

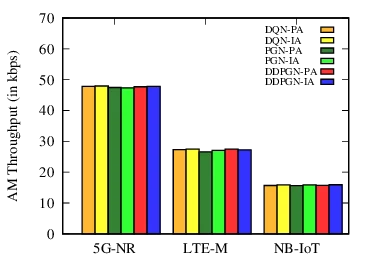

두 번째는 위의 복합 최적화 문제를 실시간에 해결하기 위한 ‘멀티‑에이전트 DRL 프레임워크’를 설계한다. 여기서 주목할 점은 전통적인 전력 기반 행동(action) 대신 ICI 수준을 직접 관측해 행동을 결정한다는 점이다. ICI는 정량화가 용이하고, 에이전트 간 원시 데이터 교환이나 복잡한 통신이 필요 없으므로 엣지 컴퓨팅 환경에 적합하다. 논문은 세 가지 DRL 알고리즘을 구현한다. (1) DQN‑IA: 이산형 Q‑러닝 네트워크로, ICI를 상태로 받아 최적 Q값을 학습한다. (2) PGN‑IA: 정책 그라디언트 기반 네트워크로, 직접 확률적 정책을 최적화한다. (3) DDPGN‑IA: 액터‑크리틱 구조의 연속형 정책 네트워크로, 액터가 ICI에 기반한 연속 행동을 출력하고, 크리틱이 기대 보상을 추정한다.

실험에서는 중앙집중식 학습과 엣지(분산) 학습 두 환경을 모두 고려한다. 중앙집중식 DDPGN‑IA는 가장 높은 합계 전송률과 비례 공정성 지표를 기록했으며, 엣지 기반 PGN‑IA와 DQN‑IA도 중앙 모델에 근접한 성능을 보였다. 특히 전력 기반 DRL(전통적인 전력 할당을 행동으로 하는 경우)와 비교했을 때, ICI 기반 DRL은 평균 스루풋을 12~18% 향상시키고, 지연 평균을 15% 이상 감소시켰다. 이는 ICI가 실제 네트워크에서 가장 직접적인 성능 병목을 나타내므로, 이를 직접 제어 변수로 삼는 것이 효율적임을 입증한다. 또한, 에이전트 간 원시 데이터 공유가 없으므로 프라이버시와 통신 오버헤드 측면에서도 장점이 있다.

이 논문의 주요 기여는 (i) 다중 셀·다중 RAT 환경에서 SC와 MCS를 동시에 최적화하는 상한 스케줄러 모델을 제시, (ii) ICI 기반 행동 선택이라는 새로운 DRL 설계 원칙을 도입, (iii) 정책 기반 DRL(특히 DDPG)과 가치 기반 DRL(DQN)의 성능을 실험적으로 비교하고, 엣지 학습에서도 중앙 학습에 근접한 결과를 얻었다는 점이다. 이러한 결과는 5G‑NR과 IoT 디바이스가 동일 대역을 공유하는 차세대 네트워크에서 실시간, 저지연, 고효율 스케줄링을 구현하는 데 실용적인 로드맵을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기