완전 분산형 개인화 모델과 협업 그래프 공동 학습

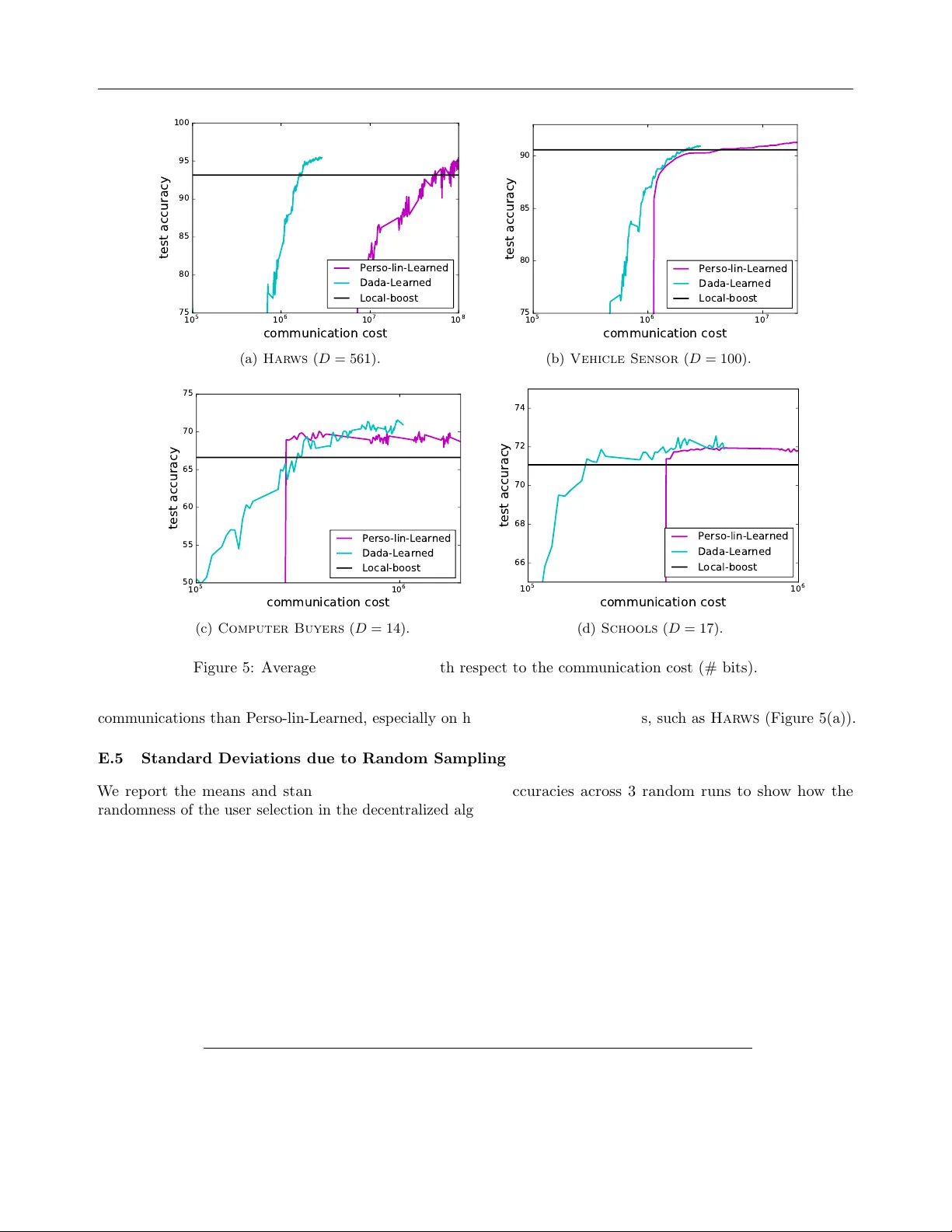

본 논문은 중앙 서버 없이 다수의 사용자가 개인 데이터를 보유한 채, 피어‑투‑피어 방식으로 협업 그래프를 동시에 학습하고 개인화된 비선형 모델을 학습하는 완전 분산 알고리즘을 제안한다. 그래프와 모델을 교대로 최적화하며, 모델 업데이트는 부스팅 기반의 그리디 방식으로 이웃에게만 전달하고, 그래프 업데이트는 무작위 샘플링된 소수의 피어와만 통신한다. 수렴 속도, 메모리·통신 복잡도에 대한 이론적 분석과 합성·실제 데이터 실험을 통해 기존 중앙집…

저자: Valentina Zantedeschi, Aurelien Bellet, Marc Tommasi

1. 서론

데이터 프라이버시와 인프라 비용 문제로 중앙집중형 머신러닝이 한계에 봉착하고 있다. 개인 디바이스에 데이터를 보관하고 피어‑투‑피어 방식으로 협업 학습을 수행하는 완전 분산 학습이 대안으로 떠오르고 있다. 기존 탈중앙 방법들은 전역 모델을 학습하거나, 사전에 정의된 유사성 그래프를 필요로 하는데, 이는 개인화와 그래프 구축 비용 측면에서 비효율적이다. 본 논문은 이러한 문제를 해결하기 위해 (i) 개인화된 비선형 모델을 학습하고, (ii) 사용자 간 관계를 나타내는 협업 그래프를 동시에 학습하는 프레임워크를 제안한다.

2. 관련 연구

연합 학습은 중앙 서버가 존재하지만 통신량을 최소화한다. 멀티‑태스크 학습(MTL)은 태스크 간 관계를 활용하지만 중앙집중형 데이터가 필요하다. 최근 탈중앙 학습은 전역 모델을 목표로 하지만 개인화와 그래프 기반 협업을 동시에 다루지는 않는다. 또한 기존 그래프 기반 탈중앙 방법은 사전 정의된 그래프를 전제로 하며, 비선형 모델에 대한 효율적인 통신 설계가 부족하다. 본 연구는 이 격차를 메우며, 부스팅 기반 비선형 모델과 희소 그래프 학습을 결합한다.

3. 문제 정의 및 목표 함수

K명의 사용자가 각각 로컬 데이터 S_k와 신뢰도 c_k를 가진다. 목표는 개인화 파라미터 α_k∈ℝ^n와 무방향 가중치 그래프 w∈ℝ^{K(K−1)/2}를 동시에 최적화하는 것이다. 제안 목표 함수는

J(α,w)=∑_{k=1}^K d_k(w)c_k L_k(α_k;S_k) + μ_1∑_{k

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기