강화 메타학습 기반 적응형 유도 시스템

본 논문은 순환 신경망을 이용한 정책·가치 함수와 PPO 기반 강화 메타학습을 결합해, 변동성이 큰 우주 환경에서도 실시간으로 적응하는 유도법을 제안한다. DR/DV 전통 유도법, 비순환 MLP 정책 RL, 순환 정책 RL을 네 가지 난이도 높은 착륙 시나리오(엔진 고장, 대량 변동, 미지의 동역학, 도플러 레이더 전용 관측)에서 비교 실험한 결과, 순환 정책이 가장 높은 성공률과 연료 효율을 보였다.

저자: Brian Gaudet, Richard Linares

본 논문은 우주선 착륙과 같은 복잡하고 변동성이 큰 환경에서 실시간으로 적응할 수 있는 유도 시스템을 설계하고 검증한다. 저자들은 강화 메타학습(framework of reinforcement meta‑learning)을 기반으로, 정책(policy)과 가치 함수(value function) 모두에 순환 신경망(recurrent neural network, RNN) 레이어를 삽입한 구조를 제안한다. 이 구조는 에피소드 동안 관측·행동 시퀀스를 은닉 상태에 축적함으로써, 관측이 마코프성을 만족하지 않을 때도 숨겨진 시스템 파라미터(예: 현재 질량, 외부 힘)를 추정하고 즉시 반영한다.

학습 알고리즘으로는 Proximal Policy Optimization(PPO)을 사용한다. PPO는 Trust Region Policy Optimization(TRPO)의 제한을 클리핑된 목표함수로 근사해, 정책 업데이트 시 KL‑다이버전스가 일정 수준 이하로 유지되도록 한다. 정책은 가우시안 분포를 따르며, 평균은 신경망 출력, 분산은 학습된 파라미터로 정의한다. 가치 함수는 동일한 순환 구조를 갖고, 어드밴티지(A) 추정에 사용된다.

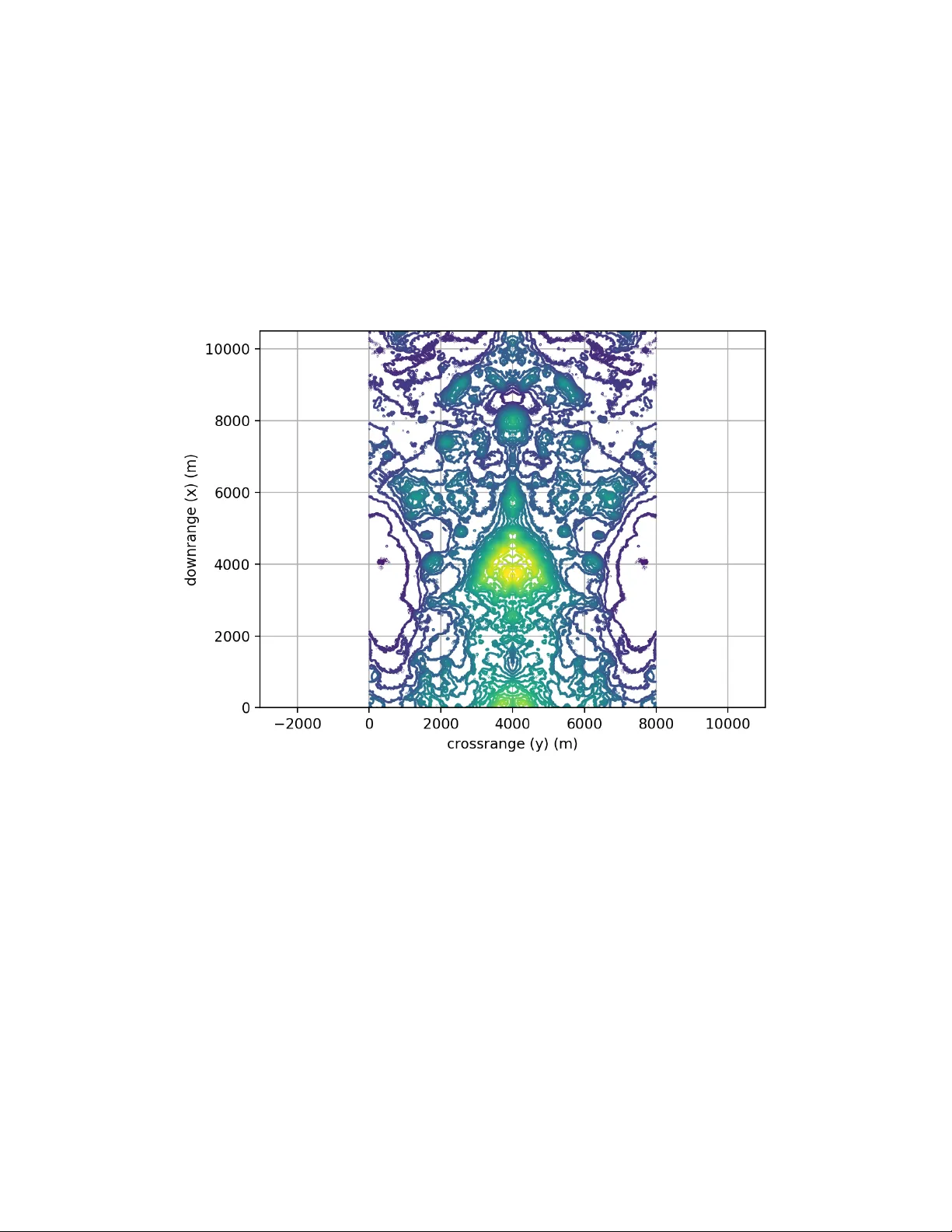

실험은 네 가지 난이도 높은 시나리오로 구성된다. 첫 번째는 ‘미지의 동역학(소행성 착륙)’으로, 중력, 태양 복사압, 자전 속도가 매 에피소드마다 무작위로 설정된다. 두 번째는 ‘엔진 고장’으로, 시작 시점에 확률 p로 임의 엔진이 정지해 추력 한계가 감소한다. 세 번째는 ‘대용량 질량 변동’으로, 초기 습식·건식 질량이 2000 kg/200 kg인 대형 엔진을 사용해 연료 소모에 따라 질량이 크게 변한다. 네 번째는 ‘비마코프 관측’으로, 네 개의 도플러 레이더 고도계 반환값만을 관측으로 사용한다; 이 경우 전통적인 DR/DV 유도법은 적용이 불가능하다.

비교 대상은 (1) 전통적인 DR/DV 유도법(중력·초기 질량을 완전히 알 수 있는 최적 조건 제공), (2) 비순환 MLP 정책을 사용한 RL 에이전트, (3) 순환 정책을 사용한 RL 에이전트이다. 결과는 다음과 같다. DR/DV는 변동성이 큰 환경에서 성능이 급격히 저하되었으며, 특히 엔진 고장·질량 변동 상황에서 연료 소모가 크게 늘어났다. MLP 정책은 관측만으로는 변동성을 충분히 추정하지 못해 성공률이 낮았다(특히 도플러 레이더 전용 실험에서 10 % 이하). 반면 순환 정책은 은닉 상태를 통해 숨겨진 변수들을 실시간으로 추정하고, 정책 자체는 고정된 파라미터만 사용하면서도 높은 성공률(모든 시나리오에서 80 % 이상)과 연료 효율을 달성했다. 특히 도플러 레이더 전용 실험에서 85 % 이상의 성공률을 기록, 센서 제한 상황에서도 안정적인 착륙이 가능함을 입증했다.

논문의 주요 기여는 (1) 순환 신경망을 이용한 메타‑학습 기반 적응형 유도법 제안, (2) 전통적인 DR/DV와 비순환 RL 대비 실시간 환경 적응 능력 및 연료 효율성 입증, (3) 관측 제한 상황에서도 유도·내비게이션을 통합한 사례 제공이다. 한계점으로는 3‑DOF 모델에 국한된 점, 실제 하드웨어 테스트 부재, 순환 네트워크 학습 비용이 높아 온보드 실시간 학습에 추가 최적화가 필요함을 들 수 있다. 향후 연구에서는 6‑DOF 전역 모델, 하드웨어‑인‑더‑루프 검증, 경량화된 순환 구조(예: QRNN, SRU) 적용, 그리고 지속적인 현장 학습을 위한 안전한 탐색 전략 개발이 기대된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기