음향 장면 분류 대회 리뷰와 교육적 시사점

** 본 논문은 대학원 머신러닝 과목의 필수 과제로 진행된 음향 장면 분류(Acoustic Scene Classification) 대회의 설계·운영·성과를 정리한다. 15개 클래스를 포함한 로그‑멜 스펙트로그램 특징 데이터셋을 제공하고, 상위 팀들이 활용한 데이터 증강(랜덤 이레이징, Mixup), 사이클릭 학습률, 모델 앙상블, VGG16·AlexNet 기반 CNN·GRU 등 다양한 딥러닝 기법을 비교·분석한다. 베이스라인 대비 평균 1~…

저자: Shayan Gharib, Honain Derrar, Daisuke Niizumi

**

본 논문은 2018년 겨울 학기 대학원 머신러닝 과목의 필수 과제로 진행된 ‘Acoustic Scene Classification Competition’을 전면적으로 리뷰한다. 대회는 15개의 환경 클래스를 포함하는 로그‑멜 스펙트로그램 기반 데이터셋을 새롭게 구성하고, Kaggle InClass 플랫폼을 이용해 내부(학생)와 외부(일반) 참가자를 모두 모집했다. 전체 200명 이상의 학생이 45팀으로 조직되었으며, 외부에서는 69팀이 추가로 참여해 총 114팀이 경쟁했다.

데이터는 기존 TUT Acoustic Scenes 2017 녹음에서 10초 길이의 세그먼트를 추출해 40 × 501 형태의 로그‑멜 에너지 매트릭스로 변환하였다. 개발 세트(4500개)와 평가 세트(1500개)는 녹음 위치별로 완전히 구분했으며, 각 클래스당 개발 세트 300개, 평가 세트 100개의 샘플을 균등하게 배치했다. 세트 간 음향 유사도는 각 세트에 대해 32‑컴포넌트 GMM을 학습하고 대칭 KL‑다이버전스로 측정해, 상위 25 % 후보 중 무작위 선택하는 방식으로 최종 구성을 확정했다.

대회 평가 지표는 단순 정확도이며, 공개 리더보드와 비공개 리더보드(각 50 %)를 구분해 과적합을 방지했다. 베이스라인 모델은 AlexNet 구조의 CNN을 사용했으며, 초기 정확도는 75.33 %였다.

상위 팀들이 활용한 주요 기술은 다음과 같다.

1. **데이터 증강**

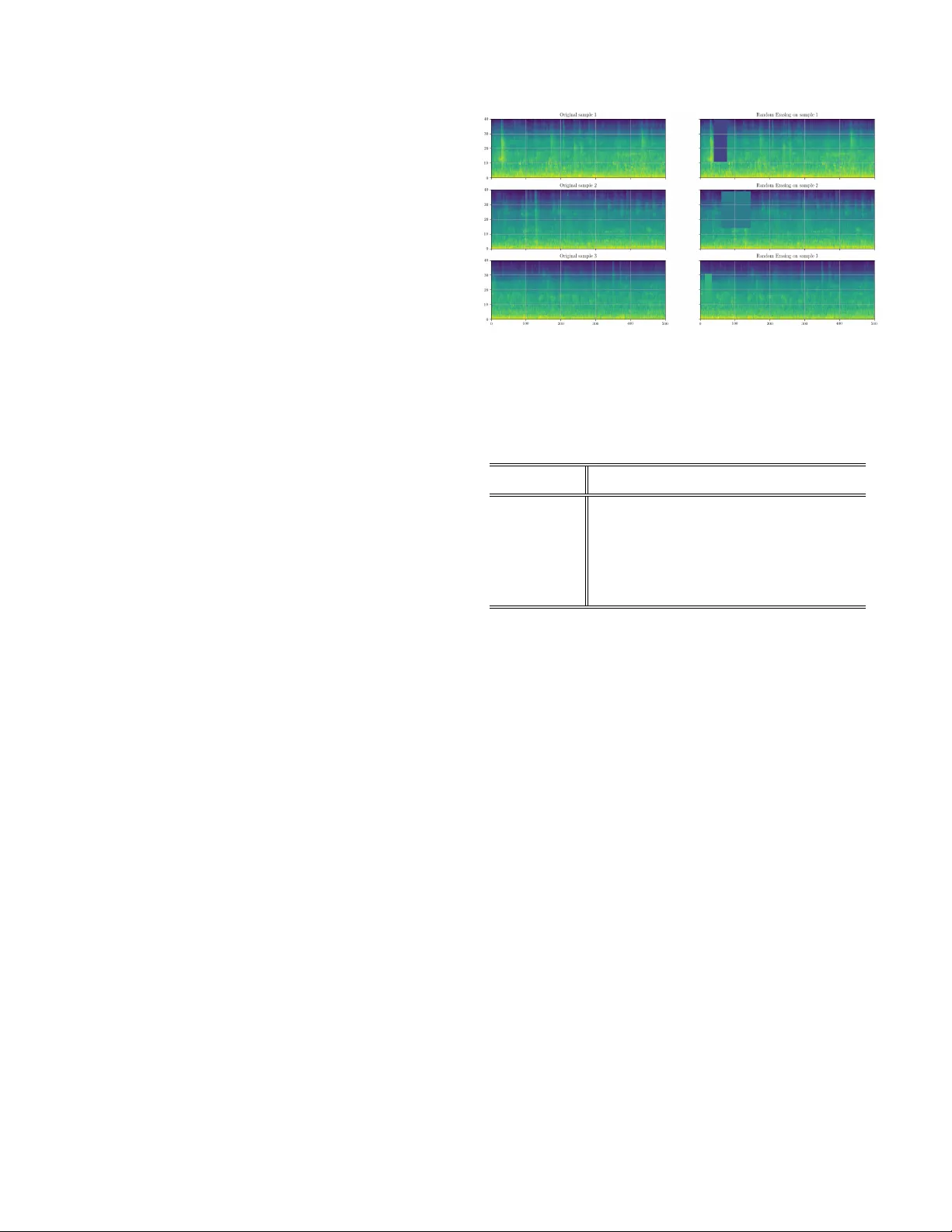

- *랜덤 이레이징*: 스펙트로그램에 무작위 사각형 마스크를 삽입해 모델이 부분 손실에 강인하도록 함. 정확도 향상은 미미했지만 구현이 간단해 널리 사용됨.

- *Mixup*: 두 샘플을 λ와 1‑λ 비율로 선형 결합하고 라벨도 동일 비율로 섞어, 연속적인 라벨 공간을 학습하게 함. 단독 적용 시 정확도가 0.93 %p 상승했고, 랜덤 이레이징과 결합하면 1.07 %p, 사이클릭 학습률(CLR)까지 적용하면 총 1.73 %p 상승을 기록했다.

2. **학습률 스케줄링**

- *사이클릭 학습률(CLR)*: 주기적으로 학습률을 변동시켜 최적점 탈출을 돕고, 증강과 결합했을 때 추가 0.7 %p 향상을 제공했다.

3. **모델 아키텍처**

- *VGG16 전이학습*: 이미지넷 사전학습 가중치를 Conv 레이어에 그대로 사용하고, 최상위 전결합층만 무작위 초기화해 78.66 % 정확도를 달성.

- *Custom CNN + GRU*: 4개의 Conv 레이어 뒤에 GRU 레이어를 삽입해 시계열 특성을 보강, 기본 모델 대비 2 %p 이상 향상.

4. **앙상블 및 K‑fold 교차검증**

- 각 Fold마다 서로 다른 녹음 위치를 배제해 K개의 모델을 학습하고, 다수결 혹은 확률 평균으로 결합. 단일 모델 74.66 % → 5‑fold 앙상블 78.93 % → Mixup 적용 79.73 %로 성능이 크게 상승했다.

5. **반지도 학습**

- 초기 모델로 테스트 세트 라벨을 예측하고, 높은 신뢰도(>50 %)를 보인 샘플을 학습 데이터에 추가해 재학습하는 과정을 3회 반복. 베이스라인 대비 약 4.5 %p의 추가 향상을 얻었다.

각 기법의 효과는 표와 그래프를 통해 정량적으로 제시되었으며, 전체적인 ablation study 결과는 데이터 증강이 가장 큰 단일 기여를, 그 다음으로 앙상블과 반지도 학습이 순차적으로 성능을 끌어올린다는 결론을 도출한다.

교육적 측면에서는 대회를 통해 학생들이 실제 데이터 파이프라인, 모델 설계, 하이퍼파라미터 튜닝, 그리고 결과 분석까지 전 과정을 경험했다. 설문 조사 결과, 92 %의 학생이 “실제 문제 해결 능력이 향상되었다”고 답했으며, 85 %는 “대회 참여가 학습 동기를 크게 고취시켰다”고 응답했다. 또한 외부 참가자와의 경쟁은 학생들에게 최신 연구 동향과 실무 수준의 기술을 직접 접할 기회를 제공했다.

결론적으로, 이 논문은 음향 장면 분류라는 구체적 과제를 통해 데이터셋 구축, 최신 딥러닝 기법 적용, 그리고 교육적 효과까지 포괄적으로 검증한 사례를 제시한다. 향후 연구에서는 더 큰 규모의 비지도 데이터 활용, 멀티모달(음성 + 영상) 통합, 그리고 실시간 시스템 적용을 위한 경량 모델 설계가 제안된다.

**

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기