다중언어 LLM의 등가·상속 관계 기반 일관성 추론 연구

초록

본 논문은 대형 언어 모델(LLM)이 다국어 환경에서 “등가(equivalence)”와 “상속(inheritance)” 관계를 활용한 일관된 추론 능력을 갖추고 있는지를 평가한다. 6개 언어(영어, 프랑스어, 스페인어, 독일어, 포르투갈어, 힌디어)로 구성된 새로운 사실 기반 QA 벤치마크를 제시하고, 기존 최첨단 모델들이 언어마다 17.3%‑57.5%의 답변 충돌과 상속 위반을 37.2%까지 보임을 실험적으로 확인한다. 또한, 토큰을 다언어 등가 토큰의 조합으로 표현하는 “Compositional Representations” 방식을 도입해 충돌을 최대 4.7% 감소시키는 개선 효과를 보고한다.

상세 분석

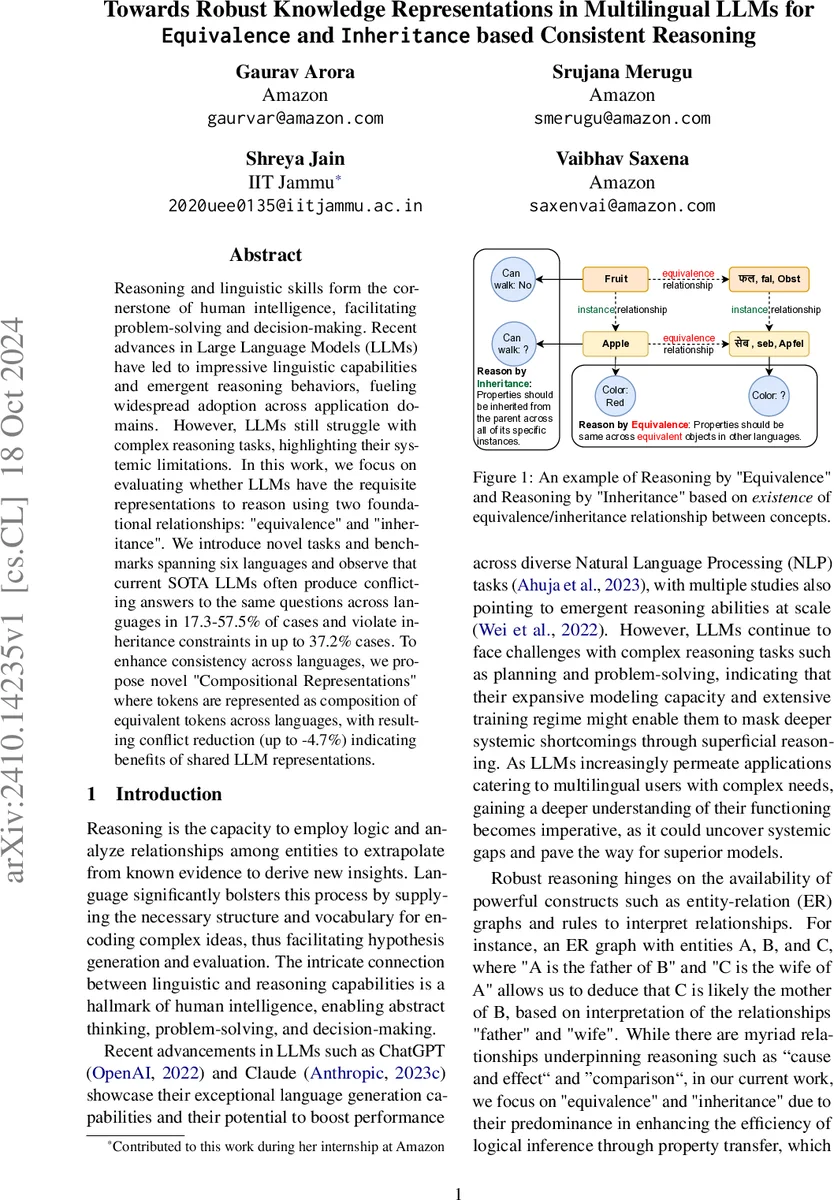

이 연구는 LLM이 인간과 유사하게 개념 간 등가와 상속 관계를 내부적으로 모델링하고 있는지를 정량적으로 검증하려는 시도이다. 먼저 저자들은 “등가 추론(Reasoning by Equivalence)”과 “상속 추론(Reasoning by Inheritance)”이라는 두 가지 기본 논리 구조를 정의하고, 각각을 평가하기 위한 병렬 QA 데이터셋을 구축한다. 등가 추론은 동일 개념이 서로 다른 언어에서 동일한 속성을 공유해야 함을 의미하며, 상속 추론은 상위 개념(예: Fruit)의 속성이 하위 개념(예: Apple, Orange)으로 전이되는지를 검사한다.

데이터는 영어 원문 88,334개의 사실 질문을 AWS Translate를 이용해 다섯 개 언어로 번역한 뒤, 번역 품질과 문화적 편향을 최소화하기 위해 객관적인 속성 질문에 한정하였다. 답변 충돌(conflict)은 두 언어에서 생성된 답변이 내용적으로 모순될 경우로 정의했으며, 충돌 비율을 정량화하기 위해 Claude v3 Sonnet을 ‘판정자(judge)’로 활용해 95% 이상의 정밀도를 확보하였다.

실험 결과, 모델 규모가 클수록 충돌 비율이 감소하는 경향을 보였지만, 가장 강력한 폐쇄형 모델(Claude v3 Sonnet)조차도 입력 언어에 따라 평균 19%‑32%의 충돌을 보였다. 특히 힌디어와 같은 비라틴 스크립트 언어에서 충돌이 크게 증가했으며, 이는 언어별 토큰 임베딩이 서로 독립적으로 학습되는 현상을 반영한다.

등가 관계의 근본 원인을 탐색하기 위해 저자들은 합성 데이터(실제 존재하지 않는 엔티티와 가상 기사)를 생성하고, 이를 한 언어에서만 학습시킨 뒤 다른 언어에서 전이 성능을 측정하는 통제 실험을 수행했다. 결과는 스크립트와 언어 계통이 유사한 경우(예: 영어‑독일어) 전이 효율이 높고, 스크립트가 다르거나 언어 구조가 크게 차이나는 경우(예: 영어‑힌디어) 전이 손실이 크게 나타났다.

이러한 현상을 완화하기 위해 제안된 “Compositional Representations”는 다언어 등가 토큰을 하나의 복합 토큰으로 결합해 모델이 언어 간 거리감을 줄이도록 설계되었다. 구체적으로, 동일 개념에 해당하는 여러 언어 토큰을 선형 결합하거나 어텐션 가중치를 공유함으로써, 토큰 임베딩 공간에서 등가 개념이 더 가깝게 배치되도록 한다. 실험에서는 기존 베이스라인 대비 충돌 비율을 최대 4.7% 감소시켰으며, 특히 스크립트가 다른 언어 쌍에서 개선 효과가 두드러졌다.

논문의 주요 기여는 (1) 다국어 등가 추론을 위한 대규모 병렬 QA 벤치마크를 공개, (2) 현재 최첨단 LLM이 언어별 표현에 과도하게 의존함을 실증, (3) 언어 간 공유 표현을 촉진하는 새로운 토큰 구성 방식을 제안하고, (4) 등가·상속 관계가 복합 추론의 전제임을 강조함으로써 향후 신경‑심볼릭 혹은 멀티모달 모델 설계에 중요한 인사이트를 제공한다는 점이다.

댓글 및 학술 토론

Loading comments...

의견 남기기