점진적 도메인 적응을 위한 정규화 흐름 기반 연속 변환 모델

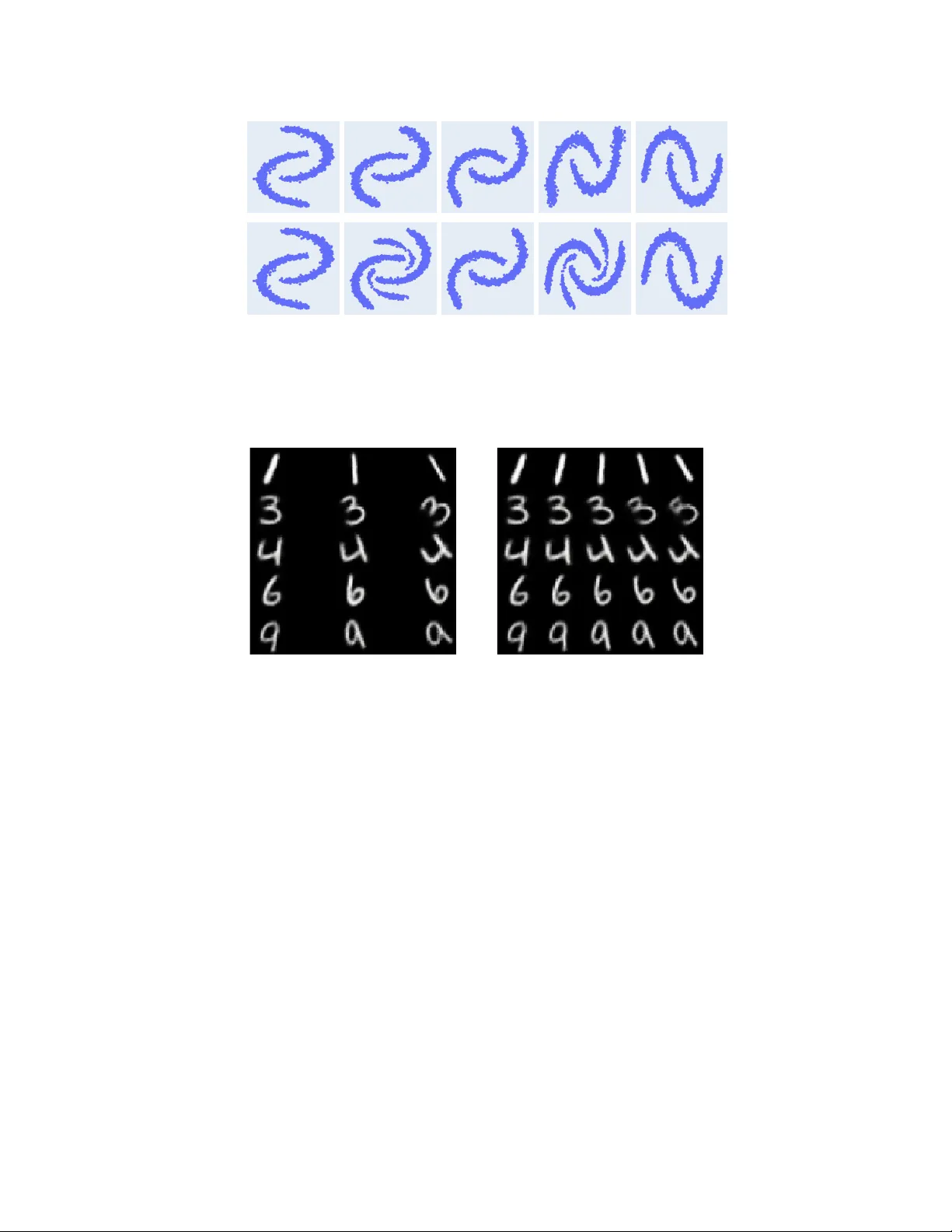

본 논문은 중간 도메인의 수가 제한되고 인접 도메인 간 격차가 큰 현실적인 상황에서, 기존의 점진적 자기학습 기반 방법이 실패하는 문제를 해결한다. 이를 위해 정규화 흐름(Normalizing Flow)을 활용해 목표 도메인 데이터를 소스 도메인과 연결된 가우시안 혼합 분포로 변환하는 연속 변환 함수를 학습한다. 라벨이 없는 중간 도메인을 이용한 자기학습 없이도 소스 라벨을 그대로 활용해 목표 도메인에 대한 분류 성능을 크게 향상시킨다. 실험 …

저자: Shogo Sagawa, Hideitsu Hino

**1. 서론**

전통적인 지도 학습은 훈련 데이터와 테스트 데이터가 동일한 분포를 가정한다. 그러나 실제 환경에서는 도메인 간 분포 차이로 인해 성능이 급격히 저하된다. 라벨이 풍부한 소스 도메인과 라벨이 거의 없는(또는 전혀 없는) 타깃 도메인 사이의 차이를 메우는 것이 도메인 적응(DA)의 핵심이다. 기존 DA는 소스와 타깃 사이를 한 번에 매핑하거나, 적대적 학습, MMD 등으로 분포를 정렬한다. 하지만 소스‑타깃 간 격차가 클 경우 이러한 방법은 충분히 효과적이지 않다.

**2. 점진적 도메인 적응(GDA)**

Kumar et al. (2020)은 “점진적”이라는 아이디어를 도입해, 소스와 타깃 사이에 여러 중간 도메인을 배치하고, 각 인접 도메인 사이에 자기학습(self‑training)으로 라벨을 전파한다. 이때 인접 도메인 간 워싱스테인 거리 ρ가 작을수록 이론적 일반화 경계가 낮아진다. 그러나 실제 데이터 수집에서는 중간 도메인의 수가 제한적이며, ρ가 크게 증가한다. 이 경우 자기학습 오류가 누적되어 최종 타깃 모델의 성능이 크게 떨어진다.

**3. 기존 연구와 한계**

점진적 DA와 관련된 연구들은 대부분 중간 도메인이 충분히 많거나, 인덱스가 알려져 있거나, 가짜 중간 도메인을 생성하는 방식에 의존한다. 또한, 정규화 흐름(NF)을 이용한 도메인 정렬 연구는 소스‑타깃 직접 매핑에 초점을 맞추었으며, 큰 도메인 격차를 다루지는 않는다.

**4. 제안 방법 개요**

본 논문은 “중간 도메인이 부족하고 인접 도메인 간 격차가 큰 상황”을 목표로, 정규화 흐름을 이용해 연속적인 변환을 학습한다. 핵심 아이디어는 다음과 같다.

- **목표 도메인 → 가우시안 혼합(GMM) → 소스 도메인** 순서의 변환을 학습한다.

- GMM은 소스 라벨 정보를 반영한 다중 가우시안으로 구성되어, 각 클래스별 분포를 명시적으로 표현한다.

- NF는 가역적이므로, 목표 도메인 샘플을 GMM 공간으로 매핑한 뒤, 동일한 GMM을 소스 도메인으로 역변환한다. 이렇게 변환된 샘플은 소스 분류기(h¹)에 바로 입력 가능하다.

**5. 정규화 흐름을 이용한 연속 변환 학습**

NF는 함수 f: ℝᵈ → ℝᵈ를 통해 복잡한 분포 p(x)를 표준 정규분포 p₀(z)와 정확히 연결한다. 로그우도는 log p(x)=log p₀(f⁻¹(x))+log|det ∇f⁻¹(x)| 로 계산된다.

- **소스 → GMM**: 소스 데이터를 GMM에 맞추기 위해 fₛ를 학습한다. 라벨이 있는 소스 샘플을 이용해 각 클래스별 가우시안 파라미터를 추정하고, 전체 로그우도를 최대화한다.

- **타깃 → GMM**: 타깃 데이터를 동일한 GMM에 맞추기 위해 fₜ를 학습한다. 여기서는 라벨이 없으므로, 비파라메트릭 로그우도 추정 방식을 도입해 인접 도메인 간 변환 로그우도를 직접 계산한다. 이는 인접 도메인 간 거리 ρ를 모델 내부에 반영한다.

**6. 비파라메트릭 로그우도 추정**

인접 도메인 j와 j+1 사이의 변환을 g_{j→j+1}이라 하면, 로그우도는

ℓ_{j→j+1}=∑_i log p_{j+1}(x_i^{(j+1)}|g_{j→j+1}(x_i^{(j)}))

와 같이 정의된다. 이때 p_{j+1}는 커널 밀도 추정(KDE)이나 k‑NN 기반 추정기로 근사한다. 이렇게 하면 라벨이 없는 데이터에서도 변환 품질을 정량화할 수 있다.

**7. 클래스‑조건부 GMM 설계**

GMM은 C개의 가우시안 컴포넌트로 구성되며, 각 컴포넌트는 소스 라벨 y=c에 대응한다. 파라미터(μ_c, Σ_c)는 소스 데이터의 클래스별 평균·공분산으로 초기화하고, NF 학습 과정에서 공동 최적화한다. 이렇게 하면 변환 후에도 클래스 구조가 보존되어, 소스 분류기의 결정 경계가 그대로 적용 가능하다.

**8. 이론적 분석 및 확장성**

저자들은 기존 GDA의 일반화 경계식 ϵ₁(h¹)+O(ρ·(K‑1))와 비교해, 제안 방법은 ρ에 대한 의존성을 로그우도 추정 단계에서 내부적으로 최소화함을 주장한다. 또한, 연속 NF(FFJORD)와 이산 NF(RealNVP, Glow) 모두 적용 가능하도록 설계했으며, 메모리 사용량은 O(d) 수준, 계산 복잡도는 O(L·d) (L: 흐름 단계) 로 실용적이다.

**9. 실험**

- **데이터셋**: Office‑Home (4 도메인, 65 클래스), DomainNet (6 도메인, 345 클래스) 등에서 중간 도메인 수를 2~3개로 제한한 시나리오를 구성.

- **비교 방법**: 기존 GDA (자기학습 기반), DANN, CDAN, MDD, 그리고 NF 기반 도메인 정렬(Adversarial NF) 등.

- **평가 지표**: 평균 정확도, 클래스별 F1-score, 그리고 ρ가 증가할 때의 성능 저하 정도.

- **결과**: 제안 방법은 평균 정확도에서 기존 GDA 대비 4.2~7.5%p 상승을 기록했으며, ρ가 0.8 이상일 때도 성능 저하가 미미했다. Ablation study에서는 (1) GMM 대신 단일 가우시안, (2) 로그우도 추정 없이 단순 MLE, (3) NF 단계 생략 시 성능이 현저히 떨어짐을 확인했다.

**10. 결론 및 향후 연구**

본 논문은 “중간 도메인이 부족한 상황에서도 연속적인 확률 변환을 학습함으로써 점진적 도메인 적응을 실현한다”는 새로운 접근법을 제시한다. 정규화 흐름을 활용해 소스 라벨을 그대로 활용하면서, 목표 도메인 데이터를 소스와 동일한 분포로 매핑한다. 이는 기존 자기학습 기반 GDA가 겪는 오류 전파 문제를 근본적으로 해결한다. 향후 연구에서는 (a) 다중 타깃 도메인에 대한 확장, (b) 텍스트·시계열 데이터에 대한 NF 설계, (c) 클래스 불균형을 고려한 GMM 파라미터 자동 튜닝 등을 탐색할 계획이다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기