잠재공간 채우기로 제로샷 음성합성 품질 향상

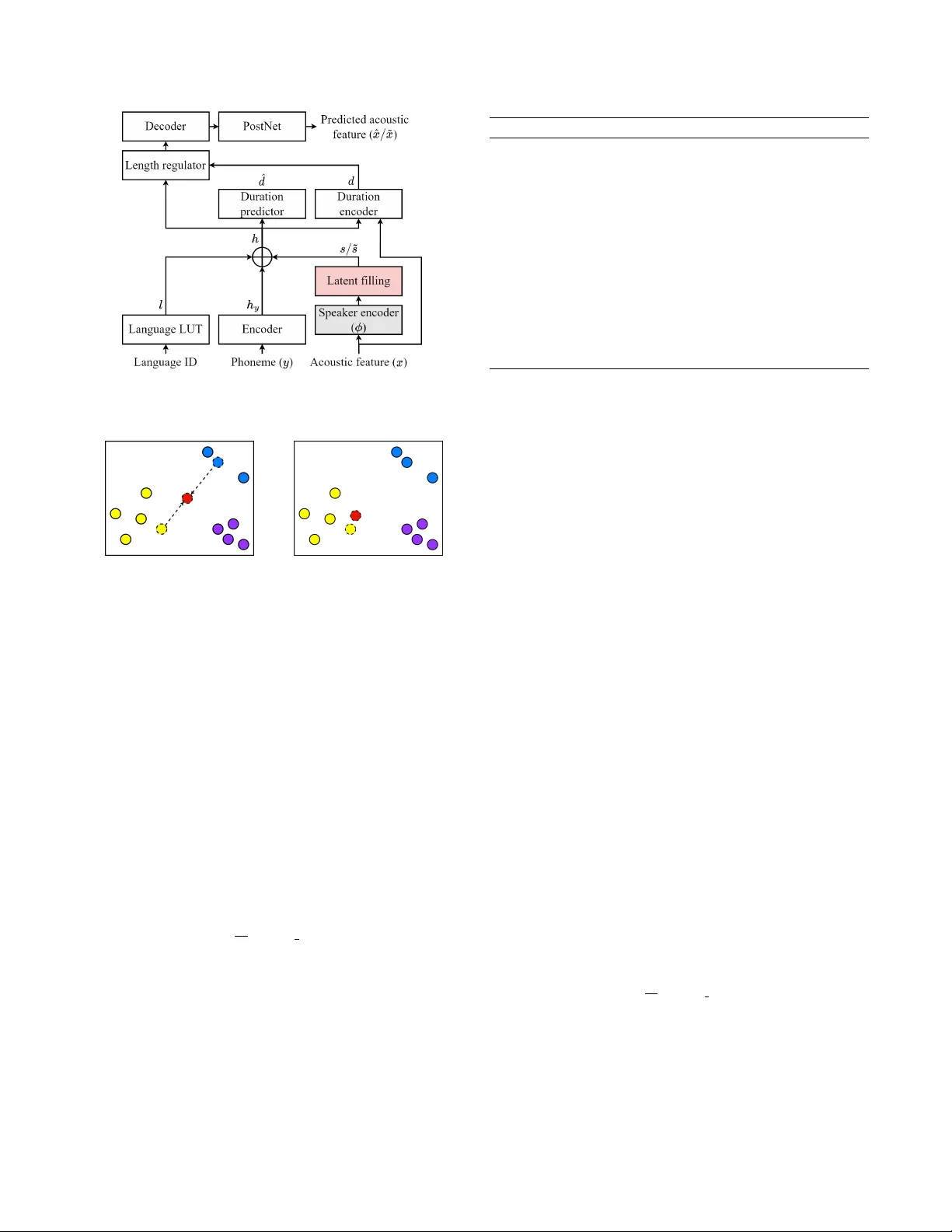

본 논문은 제로샷 텍스트‑투‑스피치(ZS‑TTS) 시스템에서 스피커 임베딩의 잠재공간을 직접 증강하는 “잠재 채우기(Latent Filling, LF)” 기법을 제안한다. LF는 기존 스피커 임베딩 사이를 보간하거나 가우시안 노이즈를 추가해 새로운 임베딩을 생성하고, 이를 위한 일관성 손실(LFCL)을 도입해 학습 단계 없이 기존 모델에 바로 적용한다. 실험 결과, LF는 화자 유사도(SMOS, SECS)를 크게 향상시키면서 자연스러움과 인식률…

저자: Jae-Sung Bae, Joun Yeop Lee, Ji-Hyun Lee

본 논문은 제로샷 텍스트‑투‑스피치(ZS‑TTS) 시스템이 직면한 데이터 부족과 저품질 데이터 증강으로 인한 성능 저하 문제를 해결하기 위해, 스피커 임베딩의 잠재공간을 직접 보강하는 “잠재 채우기(Latent Filling, LF)” 방법을 제안한다. 기존 연구들은 크라우드소싱 음성이나 피치 변환, 음성 변환 모델 등을 이용해 학습 데이터를 늘리려 했지만, 잡음·발음 오류·채널 왜곡 등으로 전체 시스템 품질이 떨어지는 부작용을 겪었다. 이러한 한계를 극복하고자 저자들은 입력 데이터를 직접 변형하는 대신, 사전 학습된 스피커 인코더가 출력하는 임베딩 벡터 자체를 증강한다.

LF는 두 가지 기본 연산으로 구성된다. 첫 번째는 두 화자 임베딩 s_i와 s_j 사이를 β‑분포(파라미터 β)로 가중 평균해 새로운 임베딩 ˜s_i를 생성하는 보간(interpolation)이다. 이때 언어 정보가 동일한 화자 쌍을 선택하는 것이 안정성을 보장한다. 두 번째는 가우시안 노이즈 G~N(0,σ²)를 추가해 기존 임베딩을 미세하게 변형하는 노이즈 추가(noise addition)이다. 보간을 수행할 확률은 1‑ε이며, 노이즈를 추가할 확률은 ε로 설정한다. 이렇게 생성된 ˜s_i는 기존 스피커 임베딩과는 다른 위치에 존재하지만, 여전히 실제 화자 특성을 반영하도록 설계된다.

잠재공간에서 새로운 임베딩을 사용하면 기존 재구성 손실(L_rec)을 적용할 수 없기 때문에, 저자들은 새로운 일관성 손실인 LFCL(Latent Filling Consistency Loss)을 도입한다. LFCL은 생성된 음성 ˜x에 대해 동일한 스피커 인코더를 적용해 얻은 임베딩 ϕ(˜x)와 변형된 임베딩 ˜s_i 사이의 코사인 유사도를 최대화한다. 이는 “변형된 임베딩이 실제 음성에 정확히 반영되도록” 강제함으로써, 변형된 임베딩에 대한 지도 신호를 제공한다.

학습 과정은 확률 τ에 따라 LF 적용 여부를 무작위로 전환한다. τ가 0.25일 때, 25%의 배치에서는 LF와 LFCL만 사용하고, 나머지 75%에서는 기존 재구성 손실(L_rec)과 스피커 일관성 손실(SCL)을 사용한다. 이 스위칭 메커니즘은 추가 학습 단계 없이 기존 ZS‑TTS 파이프라인에 LF를 자연스럽게 통합한다.

실험은 영어와 한국어 두 언어에 대해 대규모 멀티스피커 데이터를 사용했다. 영어는 VCTK, LibriTTS, LJSpeech 등 1,245명의 화자를 포함해 약 259시간, 한국어는 AIHub의 멀티스피커와 감정 데이터셋을 합쳐 약 7,678시간을 활용했다. 테스트는 영어 화자와 한국어 화자를 각각 참조 음성으로 사용해 intra‑lingual(En→En)과 cross‑lingual(Ko→En) 시나리오를 평가했다.

평가 지표는 화자 유사도(SECS, SMOS), 인식률(WER), 자연스러움(MOS) 등이다. Baseline+LF는 SECS가 0.836(En→En)과 0.729(Ko→En)으로 기존 Baseline(0.827, 0.720)보다 향상되었으며, SMOS도 각각 3.34와 2.89로 최고 점수를 기록했다. WER는 1.10%와 2.14%로 약간 상승했지만, 여전히 GT 수준에 가깝고 MOS는 3.82와 3.85로 큰 손실이 없었다. 반면, 크라우드소싱(LibriLight)이나 피치 변환 기반 증강은 화자 유사도는 일부 개선했지만 MOS와 WER가 크게 악화되는 경향을 보였다.

추가적인 ablation 실험에서는 노이즈 추가만 사용하거나 보간만 사용했을 때 성능이 다소 감소함을 확인했다. 이는 두 변환이 상호 보완적으로 작용해 잠재공간을 균형 있게 확장한다는 것을 의미한다.

결론적으로, LF는 (1) 간단한 수학적 연산으로 잠재공간을 효과적으로 확장, (2) LFCL을 통해 변형된 임베딩과 생성 음성 사이의 일관성을 학습, (3) 기존 모델 구조와 파라미터를 그대로 유지하면서도 화자 유사도를 크게 향상시키는 장점을 제공한다. 이는 제로샷 TTS가 실제 서비스에 적용될 때, 제한된 참조 음성만으로도 높은 화자 일관성과 자연스러운 음성을 제공할 수 있게 하는 중요한 기술적 진보라 할 수 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기