딥 트래킹 컨트롤: 모델 기반 계획과 강화학습의 융합

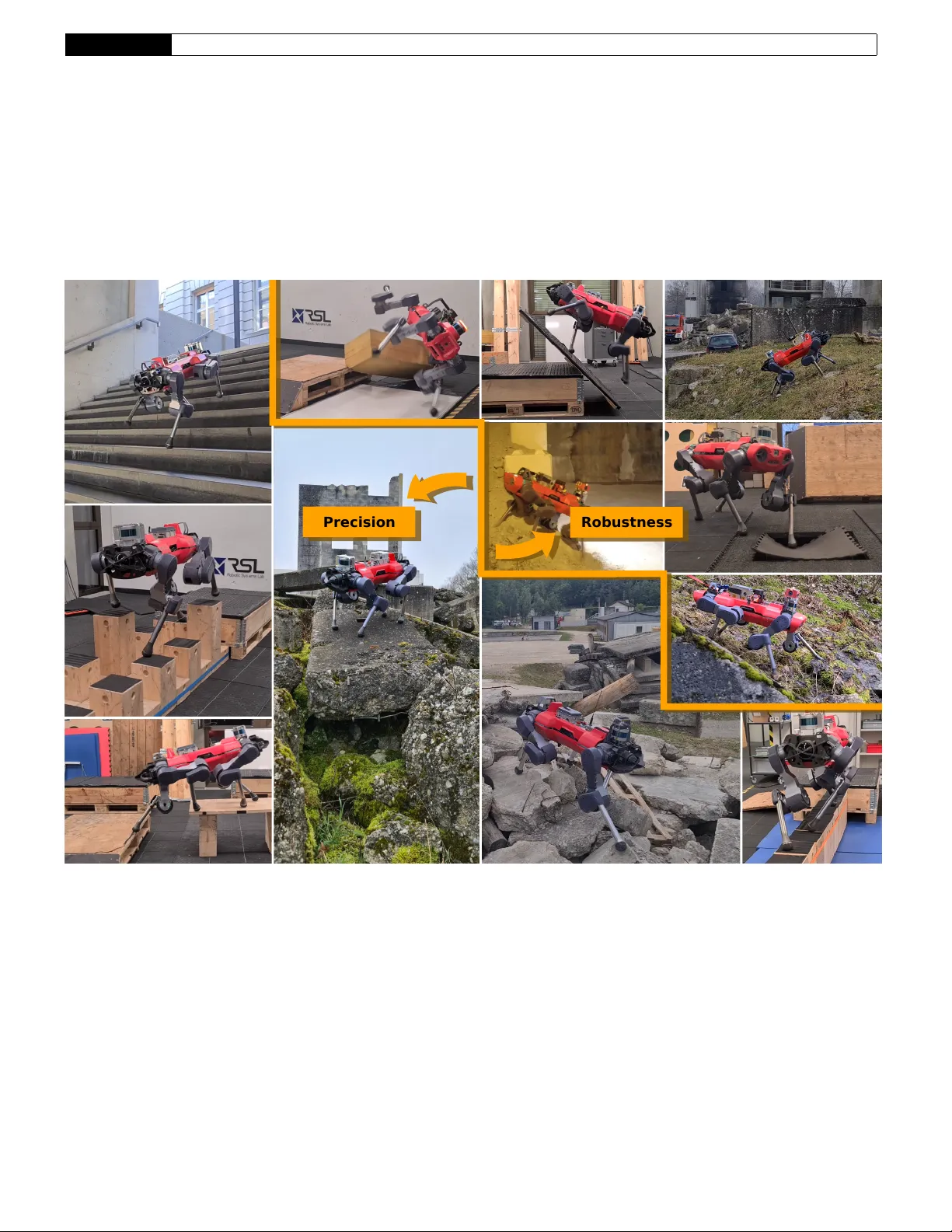

본 논문은 모델 기반 궤적 최적화와 시뮬레이션 기반 강화학습을 결합한 하이브리드 제어 프레임워크인 딥 트래킹 컨트롤(DTC)을 제안한다. 모델 기반 플래너가 생성한 최적 발판 정보를 레퍼런스로 사용해 신경망 정책을 학습함으로써, 희소 지형에서의 발판 정확도와 전반적인 로봇 강인성을 동시에 확보한다. 실제 ANYmal 로봇에 적용한 결과, 미끄러운·변형 가능한 지면, 계단 등 다양한 환경에서 기존 모델 기반·데이터 기반 방법들을 능가하는 성능을 …

저자: Fabian Jenelten, Junzhe He, Farbod Farshidian

본 논문은 복잡하고 불확실한 실제 환경에서 다리 로봇이 요구하는 **정밀도**와 **강인성**을 동시에 만족시키기 위해, 모델 기반 궤적 최적화와 시뮬레이션 기반 강화학습을 결합한 하이브리드 제어 아키텍처인 “딥 트래킹 컨트롤”(Deep Tracking Control, DTC)을 제안한다. 기존의 모델 기반 방법은 정확한 동역학 모델과 비용 함수를 기반으로 최적 궤적을 생성하지만, 모델 불일치, 센서 노이즈, 환경 변화 등에 취약하다. 반면, 강화학습 기반 정책은 시뮬레이션에서 다양한 교란을 경험함으로써 높은 복원력을 얻지만, 보상이 희소한 지형(예: 간격이 큰 틈, 좁은 발판)에서는 학습이 어려워진다.

**핵심 아이디어**는 모델 기반 플래너가 생성한 최적 발판(foothold) 정보를 “레퍼런스”로 활용해, 이를 목표로 하는 신경망 정책을 학습시키는 것이다. 구체적으로, 저자들은 최신 궤적 최적화 기법인 TAMOLS(terrain‑aware motion generation for legged systems)를 사용해 로봇의 발판 위치와 베이스 자세를 동시에 최적화한다. TAMOLS는 지형 인식, 관절 가용 범위, 동역학 제약 등을 고려해 전역적인 발판 배치를 도출한다. 이때 얻어진 발판 좌표, 목표 관절 위치, 접촉 스케줄 등은 정책 네트워크의 입력으로 사용된다.

정책 네트워크는 **비대칭 actor‑critic** 구조를 채택한다. 가치 함수는 노이즈가 없는 “그라운드 트루스” 정보를 받아 학습 안정성을 높이고, 정책 네트워크는 실제 센서 노이즈가 포함된 관측값을 사용해 현실적인 상황에 대한 적응력을 기른다. 보상 함수는 발판 착지 시점에 목표 발판과 실제 발 위치 사이의 거리 최소화에 초점을 맞추며, 이는 기존 RL이 베이스 자세나 속도에만 보상을 주던 방식과 차별화된다.

학습 과정에서는 4,000대 이상의 가상 로봇을 2주간 병렬로 학습시켜 약 23년 분량의 최적화 궤적을 생성·학습하였다. 이는 기존 RL이 수백만 에피소드를 필요로 하는 것에 비해 데이터 효율성을 크게 향상시킨다. 또한, 플래너의 업데이트 주기를 가변적으로 설정해 온라인 재계획 시 연산 부하를 최소화하면서도 실시간 교란에 대응할 수 있다.

**실험**은 실제 ANYmal 로봇을 사용해 네 가지 베이스라인(두 모델 기반: TAMOLS, MPC; 두 데이터 기반: teacher‑student 정책, 순수 RL 정책)과 비교하였다.

1. **강인성 평가**: 미끄러운 판, 물에 젖은 화이트보드, 부드러운 폼 박스, 움직이는 카트 등 다양한 교란 요소가 포함된 환경에서 DTC는 모두 성공적으로 로봇을 유지·복구하였다. 특히, 시각 센서가 차단된 상태에서 계단을 오를 때도 스윙 리플렉스를 통해 발판을 정확히 잡아내어 낙상을 방지했다.

2. **정밀도 평가**: 평지에서 다양한 속도로 20 s 동안 주행하며 발판 추적 오차를 측정한 결과, 평균 2.3 cm, 표준편차 0.48 cm로 기존 모델 기반·RL 기반 방법보다 현저히 낮았다. 또한, 좁은 테이블 위에서 360도 회전 후 하강하는 복합 동작에서도 목표 발판을 정확히 따라갔다.

3. **플래너 교체와 제로샷 일반화**: DTC를 TAMOLS 대신 MPC 플래너와 결합했을 때, 플래너가 제공하는 발판 패턴이 크게 달라짐에도 불구하고 정책은 별도 재학습 없이 바로 적용 가능했다. 이를 통해 0.48 m 높이의 박스를 오를 수 있었으며, 이는 기존 RL 정책이 달성하지 못한 수준이다.

**결과 요약**

- DTC는 모델 기반 플래너가 제공하는 전역적인 발판 계획과 RL 정책의 강인성을 성공적으로 결합하였다.

- 희소 보상 문제를 발판 거리 최소화라는 밀집 보상으로 전환함으로써 학습 효율성을 크게 향상시켰다.

- 비대칭 actor‑critic 구조와 제한된 관측 공간 설계가 정책의 견고함과 플래너 독립성을 보장한다.

- 실제 로봇 실험에서 미끄러운·변형 가능한·시각이 차단된 환경 등 다양한 도전 과제에 대해 기존 베이스라인을 능가하는 성능을 보였다.

**의의와 향후 과제**

본 연구는 다리 로봇 제어에서 “예측(플래너) + 반응(정책)”이라는 두 축을 동시에 강화함으로써, 복잡한 실제 환경에서도 높은 정확도와 강인성을 동시에 달성할 수 있음을 입증했다. 향후 연구에서는 플래너와 정책 간의 피드백 루프를 더욱 긴밀히 연결해, 플래너가 실시간 교란을 감지하고 정책이 즉시 보정하도록 하는 **협동형 온라인 학습**을 탐구할 수 있다. 또한, 현재는 발판 좌표와 관절 목표에 국한된 관측을 사용했지만, 촉각·힘 센서 등 추가적인 피드백을 통합하면 더욱 복잡한 비정형 지형에서도 성능을 확장할 가능성이 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기