PEA265: 영상 압축 인공물 인식 및 정량화 데이터베이스 구축

본 논문은 H.265/HEVC 압축 영상에서 발생하는 6가지 주요 인공물(블러링, 블로킹, 링잉, 색 번짐, 플리커링, 플로팅)을 주관적 라벨링한 대규모 PEA265 데이터베이스를 구축하고, 이를 이용해 LeNet‑5와 ResNeXt 기반 CNN 모델을 학습시켜 각 인공물을 80% 이상 정확도로 자동 식별한다. 또한 인공물 패턴과 인공물 강도라는 두 가지 정량화 지표를 제안하여 압축 영상의 전반적인 시각적 품질을 객관적으로 평가한다.

저자: Liqun Lin, Shiqi Yu, Tiesong Zhao

본 논문은 현대 영상 압축 시스템에서 빈번히 발생하는 시각적 인공물(Perceivable Encoding Artifacts, PEAs)을 체계적으로 탐지·정량화하기 위한 데이터베이스와 인공지능 기반 인식 모델을 제시한다. 연구 배경으로는 H.265/HEVC와 같은 최신 하이브리드 코덱이 블록 기반 예측·변환·양자화 과정을 거치면서 블로킹, 블러링, 링잉, 색 번짐 등 네 가지 공간 인공물과, 프레임 간 예측 오류·GOP 전이로 인한 플리커링, 플로팅이라는 두 가지 시간 인공물이 발생한다는 점을 들었다. 이러한 인공물은 기존 PSNR·SSIM과 같은 전통적인 품질 지표로는 충분히 포착되지 않으며, 사용자 경험(QoE)을 크게 저하시킨다.

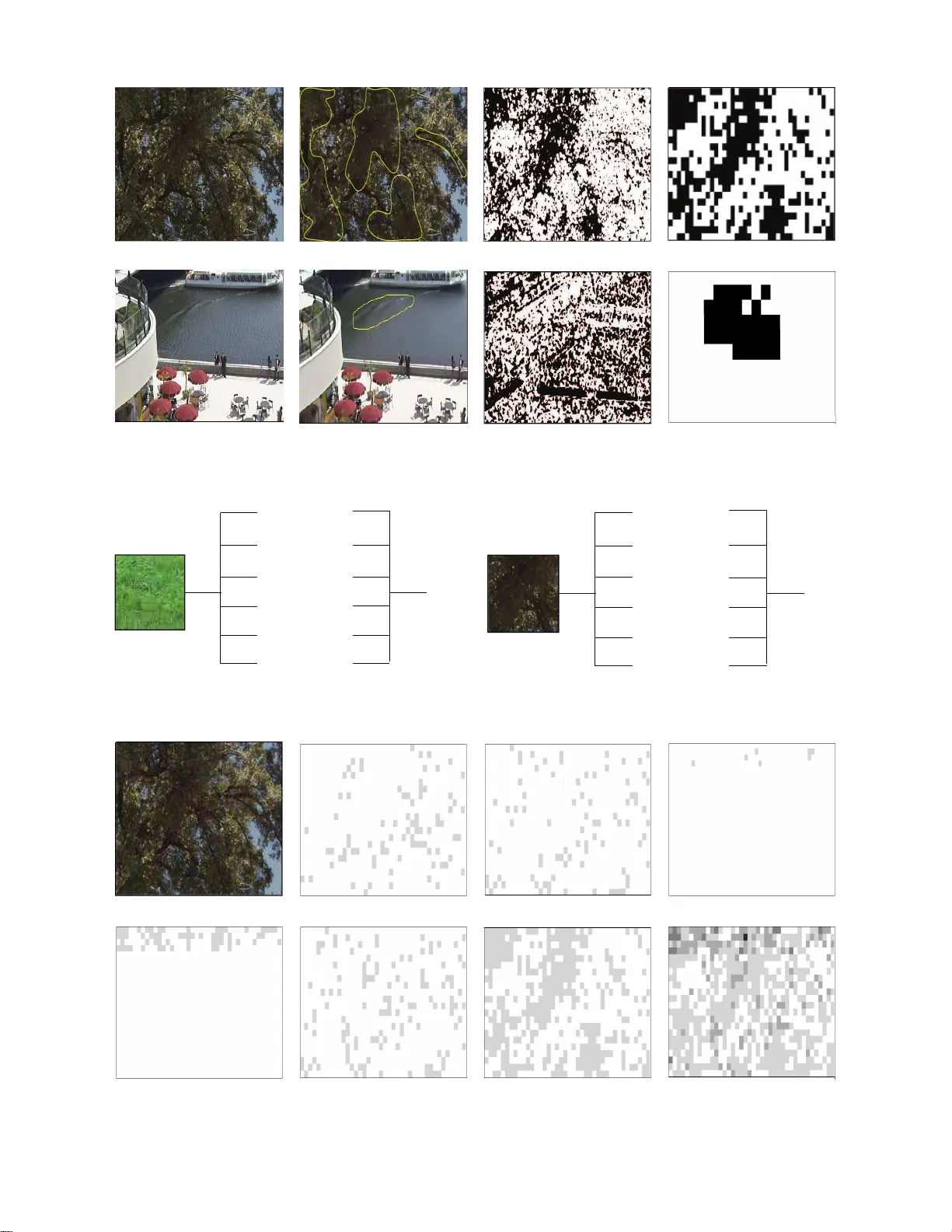

데이터베이스 구축은 크게 네 단계로 진행되었다. 첫째, CTC(공통 테스트 조건)에 따라 23개의 다양한 해상도·프레임레이트 영상을 선정하고, H.265 인코더를 이용해 QP 22, 27, 32, 37 네 가지 양자화 수준과 전부 intra, random access, low‑delay, low‑delay P 네 가지 코딩 구조를 적용해 총 320개의 압축 영상을 생성하였다. 둘째, 30명의 실험자를 대상으로 ITU‑R BT.500 표준에 따라 사전 교육과 정규 테스트를 수행했으며, 실험자는 압축 영상에서 인공물 영역을 직접 원형·타원형 마스크로 표시하였다. 셋째, 마스크를 기반으로 32×32 혹은 72×72 크기의 패치를 슬라이딩 윈도우 방식으로 추출하였다. 양성 패치는 마스크와 50 % 이상 겹치는 경우, 음성 패치는 압축되지 않은 원본 영상에서 무작위로 추출한 패치를 사용해 1:2 비율로 구성하였다. 마지막으로, 각 인공물당 최소 60,000개의 양·음성 패치를 확보해 전체 데이터 용량 28 GB의 PEA265 데이터베이스를 완성하였다. 데이터는 영상 이름, 프레임 번호, 좌표 등 메타데이터와 함께 바이너리 형식으로 저장되었다.

인공물 인식 모델은 두 가지 CNN 아키텍처를 비교하였다. LeNet‑5는 전통적인 경량형 구조로, 5개의 레이어(컨볼루션·풀링·완전 연결)로 구성되었다. ResNeXt는 그룹화된 컨볼루션과 잔차 연결을 활용한 최신 딥러닝 모델로, 동일한 입력 크기에서 더 깊은 특성 추출이 가능하다. 각 인공물별로 50,000개의 샘플을 무작위 추출해 75 %를 학습, 25 %를 테스트에 사용하였다. 실험 결과 ResNeXt는 블러링, 블로킹, 링잉, 색 번짐, 플리커링, 플로팅 모두에서 평균 86 % 이상의 정확도를 기록했으며, LeNet‑5 대비 5‑10 % 높은 성능을 보였다. 특히 시간 인공물인 플리커링과 플로팅은 시계열 정보를 포착하는 데 ResNeXt의 깊은 구조가 유리함을 확인했다.

정량화 지표로는 “PEA 패턴”과 “PEA 강도”를 제안하였다. PEA 패턴은 6차원 바이너리 벡터(각 인공물 존재 여부)로, 프레임 단위 혹은 영상 전체에 걸쳐 인공물 분포를 시각화한다. PEA 강도는 각 인공물별 정확도와 발생 빈도를 가중치로 사용해 가중합을 계산한 값으로, 기존 PSNR·SSIM과는 달리 인간이 실제로 느끼는 왜곡 정도를 반영한다. 실험에서는 PEA 강도가 높은 영상일수록 주관적 MOS(Mean Opinion Score)가 낮게 나타났으며, 이는 제안 지표가 QoE와 높은 상관성을 가짐을 시사한다.

논문의 주요 기여는 다음과 같다. (1) 6가지 주요 PEAs를 포함하고, 각 인공물당 60,000개 이상의 라벨링된 패치를 제공하는 대규모 주관적 데이터베이스(PEA265)를 공개하였다. (2) ResNeXt 기반 CNN 모델을 통해 모든 인공물을 80 % 이상 정확도로 자동 식별함으로써, 기존 전통적 품질 지표의 한계를 극복하였다. (3) PEA 패턴·강도라는 두 가지 정량화 메트릭을 도입해 압축 영상의 전반적인 시각적 품질을 객관적으로 평가할 수 있는 프레임워크를 제시하였다. (4) 데이터와 모델을 공개함으로써 영상 품질 평가(VQA), 인공물 억제 알고리즘, 코덱 파라미터 최적화 등 다양한 연구 분야에 활용 가능하도록 하였다.

향후 연구 방향으로는 (a) 다른 코덱(H.264, AV1, VP9 등) 및 고해상도(4K·8K) 영상에 대한 데이터베이스 확장, (b) 시간 인공물에 대한 시계열 딥러닝 모델(LSTM·Transformer) 적용, (c) 멀티모달(오디오·텍스트) 품질 연계 분석, (d) 실시간 인코더에 PEA 강도 기반 적응형 QP 조정 알고리즘 적용 등을 제시한다. 이러한 확장은 차세대 사용자 중심 비디오 코덱 설계와 실시간 QoE 모니터링에 중요한 기반이 될 것으로 기대한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기