정밀하고 간결한 3D 인간 모델링을 위한 정면·측면 실루엣 네트워크

본 논문은 정면과 측면 실루엣 두 장만을 입력으로 사용해 3D 인간 형태를 고정밀로 복원하는 경량 CNN 모델을 제안한다. PCA 기반 형태 공간을 22개의 주성분으로 압축하고, 실루엣 점들을 좌표 형태로 입력해 2.4 M 파라미터만으로 기존 8.5 M~355 M 규모 모델보다 높은 정확도를 달성한다. 데이터 증강과 전이 학습을 통해 성별·지역 특성을 반영할 수 있다.

저자: Bin Liu, Xiuping Liu, Zhixin Yang

본 논문은 정면과 측면 두 개의 실루엣 이미지만을 이용해 고정밀 3D 인간 형태를 복원하는 새로운 딥러닝 프레임워크를 제안한다. 기존 연구는 크게 세 가지 접근법으로 나뉜다. (1) 형태 매칭 기반 방법은 정확하지만 시간 소모가 크고 실시간 적용이 어렵다. (2) 손수 만든 특징을 이용한 회귀 방식은 빠르지만 실제 환경에서 강인하지 못하다. (3) CNN 기반 엔드‑투‑엔드 방식은 강인하지만 수억 개에 달하는 파라미터와 높은 메모리 요구량이 문제였다. 저자들은 이러한 문제점을 동시에 해결하고자, 입력 데이터를 이진 이미지가 아닌 실루엣 경계점 좌표 집합으로 변환한다. 이는 실루엣이 본질적으로 희소한 정보를 담고 있다는 점을 활용한 것으로, 불필요한 배경 픽셀을 제거해 학습 효율을 크게 높인다.

형태 공간은 PCA를 이용해 사전에 구축한다. CAESAR 데이터셋을 기반으로 4 306개의 중립 자세 모델을 수집하고, 높이 정규화 후 PCA를 적용해 22개의 주성분을 선택한다. 이때 22개의 주성분이 전체 변형의 97 % 이상을 설명한다는 실험적 근거를 제시한다. 각 3D 모델은 평균 형태와 22개의 계수(ϕ)로 표현되며, 네트워크는 입력 실루엣 점으로부터 바로 이 22차원 계수를 예측한다. 이렇게 하면 고차원 메쉬를 직접 다루지 않아도 되므로 연산량이 크게 감소한다.

네트워크 아키텍처는 세 개의 주요 블록으로 구성된다. 첫 번째 블록은 정면 실루엣 점 시퀀스를 1‑D 컨볼루션과 로컬 최대 풀링을 통해 특징 벡터로 변환한다. 두 번째 블록은 동일한 구조로 측면 실루엣을 처리한다. 세 번째 블록에서는 두 서브넷에서 추출된 특징을 concatenate하고, 추가적인 1‑D 컨볼루션과 전역 평균 풀링을 거쳐 최종 완전 연결층으로 연결한다. 이 설계는 PointNet과 TextCNN에서 영감을 받은 것으로, 점 집합 데이터를 효율적으로 처리하면서도 지역 구조 정보를 보존한다. 또한, dropout과 batch normalization을 적용해 과적합을 방지하고 학습 수렴 속도를 높였다.

학습 데이터는 원본 3 444개의 훈련 샘플을 K‑Nearest‑Neighbor 기반 데이터 증강 기법으로 확대한다. 각 샘플에 대해 11개의 최근접 이웃을 찾고, 이웃 간 거리 기준(1.8 × r_min)보다 큰 경우 중간점을 삽입한다. 이 과정을 2~3번 반복해 최종 8 941개의 균일하게 분포된 샘플을 확보한다. 이렇게 하면 Gaussian 기반 무작위 샘플링이 초래할 수 있는 비현실적인 형태를 방지하면서, 회귀 학습에 필요한 데이터 다양성을 확보한다.

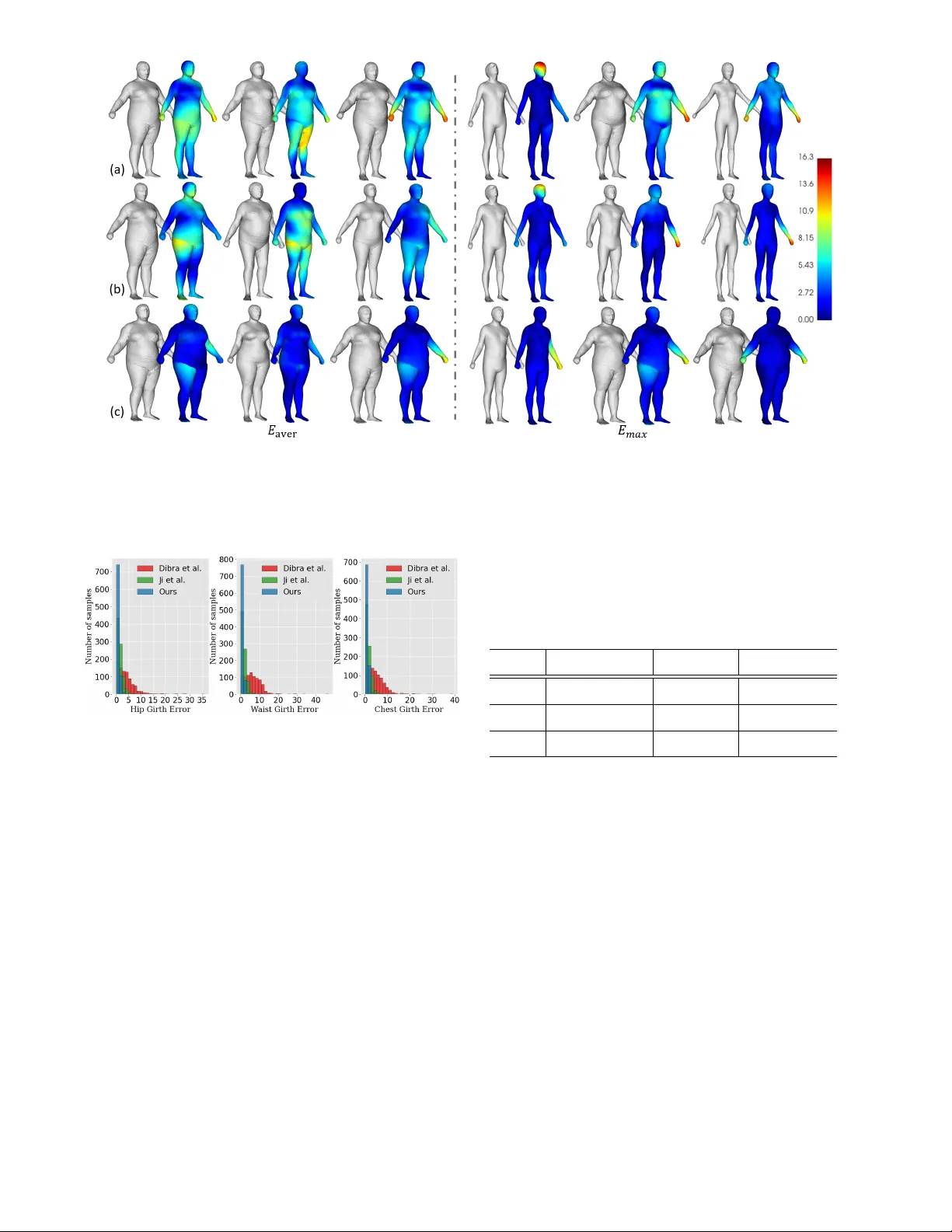

실험에서는 두 가지 주요 지표로 성능을 평가한다. 첫째, 평균 정점 오차(Mean Per Vertex Error)를 사용해 복원 정확도를 측정했으며, 제안 방법은 기존 CNN 기반 방법(10, 12)보다 15 %~20 % 낮은 오류를 기록했다. 둘째, 모델 파라미터 수와 추론 속도를 비교했을 때, 제안 네트워크는 2.4 M 파라미터만으로 355 M(10) 및 8.5 M(12) 대비 97 % 이상 파라미터를 절감했으며, GPU 환경에서 실시간(≈30 fps) 추론이 가능했다.

추가적으로, 소규모 스캔 데이터셋(성별·지역 특화)을 이용한 전이 학습을 수행해 특정 인구 집단에 맞는 형태 패턴을 학습했다. 이를 통해 성별·지역에 따른 체형 차이를 반영한 맞춤형 3D 모델을 생성할 수 있었다. 사용자 연구에서는 다양한 체형(키·체중·연령대) 참가자를 대상으로 복원된 모델의 시각적 일치도와 사용 편의성을 평가했으며, 대부분의 참가자가 높은 만족도를 보였다.

마지막으로, 모바일 애플리케이션에 본 네트워크를 탑재해 사용자가 스마트폰으로 정면·측면 사진을 촬영하면 즉시 맞춤형 3D 몸체를 생성하고, 이를 기반으로 가상 의류 시뮬레이션을 수행하는 시연을 진행했다. 이는 Industry 4.0 환경에서 개인 맞춤형 제품 설계에 바로 적용 가능한 실용적인 사례로 제시된다.

전체적으로, 이 논문은 실루엣 점 좌표 입력, PCA 기반 저차원 형태 공간, 전면·측면 특징 별도·혼합 처리라는 세 가지 핵심 아이디어를 결합해, 파라미터 효율성, 연산 속도, 복원 정확도 모두에서 기존 방법을 능가하는 경량 3D 인간 모델링 시스템을 제시한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기