정밀 AU 라벨링으로 만든 FEAFA 데이터셋, 3D 얼굴 애니메이션까지

FEAFA는 122명의 다양한 연령대 피험자를 대상으로 99 356개의 프레임을 0~1 사이의 실수값으로 정밀하게 라벨링한 24개의 대칭·비대칭 AU·AD를 제공한다. CNN 기반 회귀 모델을 베이스라인으로 제시하고, 2D 영상에서 추출한 AU 값을 이용해 3D 가상 캐릭터를 실시간으로 애니메이션하는 새로운 파이프라인을 구현하였다.

저자: Yanfu Yan, Ke Lu, Jian Xue

본 논문은 얼굴 표정 분석과 3D 얼굴 애니메이션을 위한 고품질 데이터셋인 FEAFA(Facial Expression Analysis and 3D Facial Animation)를 소개한다. 데이터셋은 122명의 피험자(어린이, 청년, 노인)를 대상으로 실생활 환경에서 촬영한 123개의 웹캠 영상으로 구성되며, 총 99 356개의 프레임에 대해 24개의 행동 단위(AU·AD)를 0~1 사이의 부동소수점 값으로 정밀 라벨링하였다. 기존 공개 데이터셋이 AU의 존재·부재 혹은 5단계 강도만 제공하는 반면, FEAFA는 연속적인 강도값을 제공함으로써 AU 값 회귀(regression) 연구에 최적화된 자료를 제공한다.

라벨링 과정에서는 FACS 표준을 기반으로 9개의 대칭 AU, 10개의 비대칭 AU, 2개의 대칭 AD, 2개의 비대칭 AD를 재정의하고, 일부 AU를 상·하위로 세분화하였다. 라벨링 도구인 Expression Quantification Tool(ExpreQuantTool)을 사용해 각 프레임을 최소 3명의 전문가가 독립적으로 라벨링하고, 평균값을 최종 라벨로 채택함으로써 주관적 편차를 최소화하였다. 라벨링 정확도는 0.01 단위(소수점 두 자리)까지 기록되었으며, 라벨링 품질을 검증하기 위한 내부 일관성 테스트도 수행하였다.

베이스라인 모델로는 다중 출력 CNN 회귀 네트워크를 설계하였다. 입력으로 정규화된 얼굴 이미지(224×224)를 사용하고, 마지막 Fully‑Connected 레이어에서 24개의 연속형 AU 값을 동시에 예측한다. 손실 함수는 각 출력에 대한 평균 제곱 오차(MSE)를 합산한 형태이며, 데이터는 80% 훈련, 10% 검증, 10% 테스트 비율로 분할하였다. 실험 결과, 평균 절대 오차(MAE)는 0.07 수준이며, 대부분의 AU에 대해 0.85 이상의 피어슨 상관계수를 기록, 기존 AU 검출·강도 추정 모델보다 우수한 성능을 보였다.

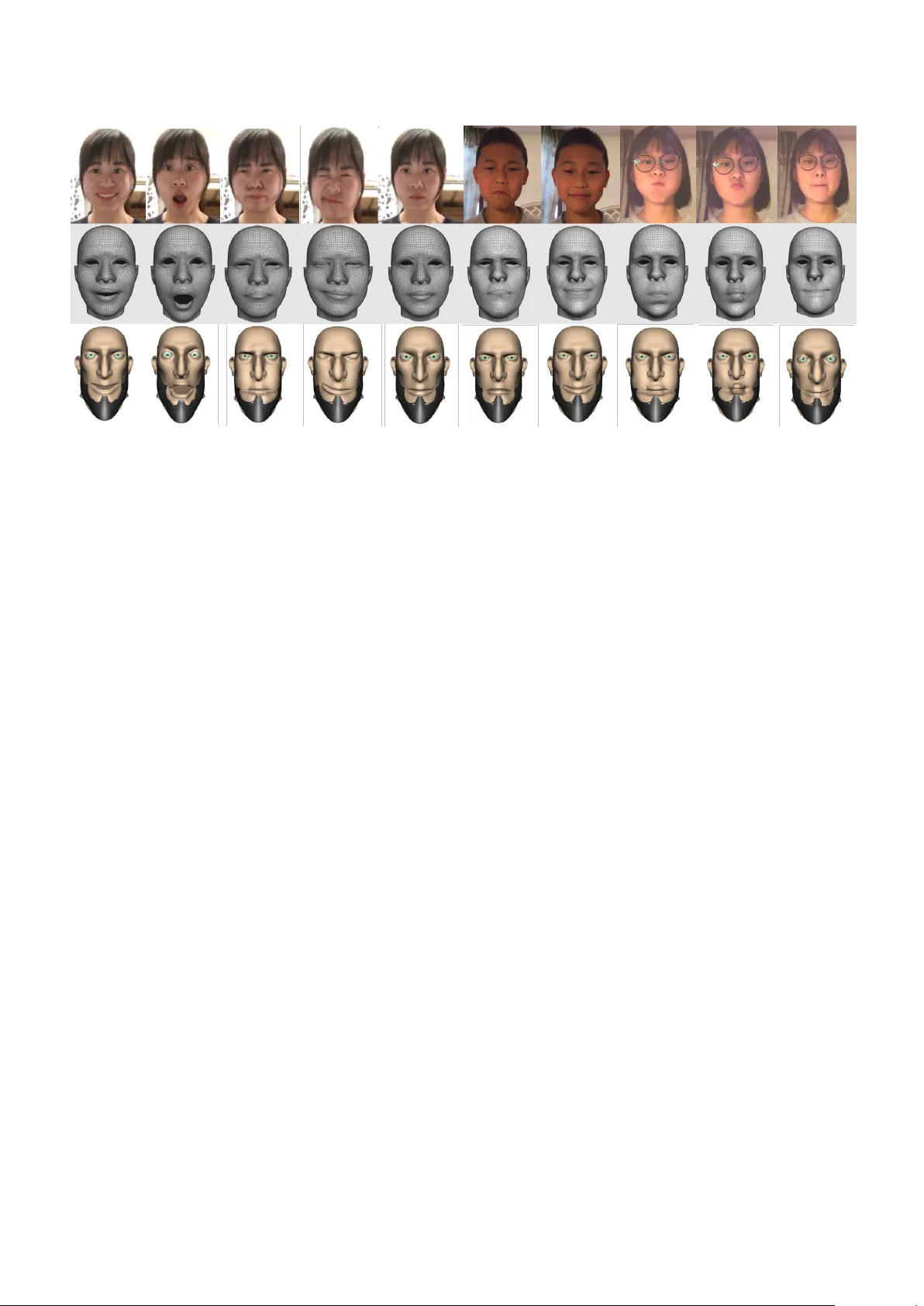

또한, 2D 영상에서 추출한 AU 값을 블렌드쉐이프 기반 3D 얼굴 모델에 적용하는 새로운 애니메이션 파이프라인을 제안한다. 24개의 블렌드쉐이프(중립형 + 24개의 AU 별 변형)를 선형 결합하여 가상 캐릭터의 표정을 실시간으로 생성한다. 이 방법은 3D 얼굴 재구성 단계가 필요 없으므로 연산량이 크게 감소하고, 실시간 인터랙션에 적합하다. 실험에서는 실제 피험자의 표정을 2D 영상에서 추출한 AU 값만으로 가상 캐릭터에 정확히 전달하는 모습을 시연하였다.

FEAFA 데이터셋은 공개 URL(http://www.iiplab.net/feafa/)을 통해 다운로드 가능하며, 라벨링 툴 및 데모 코드도 함께 제공한다. 논문은 데이터셋 구축, 라벨링 프로토콜, 베이스라인 회귀 모델, 3D 애니메이션 적용 사례 등 네 가지 주요 기여를 정리한다. 향후 연구에서는 다국적 피험자 확대, 더 높은 라벨링 정밀도(예: 0.001 단위) 확보, 그리고 AU 기반 감정 인식 및 행동 분석 등 다양한 응용 분야로 확장될 전망이다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기