포스트시냅스 전위 정규화, 새로운 일반화 전략

본 논문은 기존 L2 가중치 감소와는 다른 전역적인 정규화 기법인 포스트시냅스 전위 정규화(PSP)를 제안한다. PSP는 각 뉴런의 전후 시냅스 전위(z)를 직접 최소화함으로써 학습 과정에서 파라미터가 입력‑출력 관계 전체에 걸쳐 균형을 이루게 만든다. MNIST와 CIFAR‑10 실험에서 기존 L2 정규화보다 우수한 일반화 성능을 보이며, 특히 깊은 네트워크(ResNet‑18, MobileNet‑v2 등)에서 효과가 입증되었다.

저자: Enzo Tartaglione, Daniele Perlo, Marco Grangetto

본 논문은 딥러닝 모델의 일반화 성능을 향상시키기 위한 새로운 정규화 기법인 **포스트시냅스 전위 정규화(PSP)** 를 제안한다. 기존 연구에서는 데이터 증강, L2 가중치 감소, 드롭아웃, 배치 정규화, 엔트로피 기반 최적화 등 다양한 방법이 제시되었지만, 대부분은 파라미터 자체에 직접적인 제약을 가하거나 학습 과정에 추가적인 복잡성을 도입한다. 저자들은 L2 정규화가 실제로는 파라미터를 0에 가깝게 만들면서 동시에 각 뉴런의 **포스트시냅스 전위(z)** 도 0으로 수렴한다는 관찰을 통해, 전위 자체를 정규화 대상으로 삼는 것이 보다 직접적이고 전역적인 효과를 낼 수 있음을 제시한다.

### 이론적 배경 및 정규화 정의

- **표기법**: l번째 층, k번째 뉴런, θ_{l,k}는 해당 뉴런의 파라미터(가중치 w와 편향 b)이며, 전위 z_{l,k}=f_{l,k}(θ_{l,k}, y^{l-1}) 로 정의한다.

- **전통적인 L2 정규화**: R_{L2}=½ Σ_{l,k,j} θ_{l,k,j}² 로, 파라미터를 직접 축소한다. 업데이트 식은 θ←(1-λ)θ 로 간단히 표현된다.

- **PSP 정규화**: R_{PSP}=½ Σ_{l,k} z_{l,k}² 로, 전위 자체를 최소화한다. 체인 룰에 의해 파라미터에 대한 기울기는 ∂R/∂θ_{l,k,j}=z_{l,k}·∂z_{l,k}/∂θ_{l,k,j} 로 계산된다.

### 파라미터 업데이트와 전역성

식 (15)에서 보듯, 뒤쪽 층(p>l)의 정규화 항이 앞쪽 층까지 역전파되어 영향을 미친다. 이는 기존 L2가 **로컬**하게 파라미터를 억제하는 것과 달리, PSP는 **전역적인** 신호 흐름을 조절한다는 의미이다. 특히, 전위가 0에 가까워질수록 sigmoid·tanh 같은 비선형 함수의 미분값이 최대가 되며, ReLU의 경우 불연속점 근처에 머무르게 된다. 이러한 특성은 학습 과정에서 그래디언트가 안정적으로 흐르도록 돕고, “넓은 최소점”에 수렴하도록 유도한다.

### 실험 설정

- **데이터셋**: MNIST, Fashion‑MNIST, CIFAR‑10

- **모델**: LeNet‑5 (MNIST), ResNet‑18, MobileNet‑v2, All‑CNN‑C (CIFAR‑10)

- **훈련**: 표준 SGD, 학습률 η=0.1, 배치 100, λ값은 L2와 PSP 각각 1e‑4, 1e‑3 등 실험적으로 선택

- **구현**: PyTorch 1.1, NVIDIA Tesla P‑100 GPU

### 주요 결과

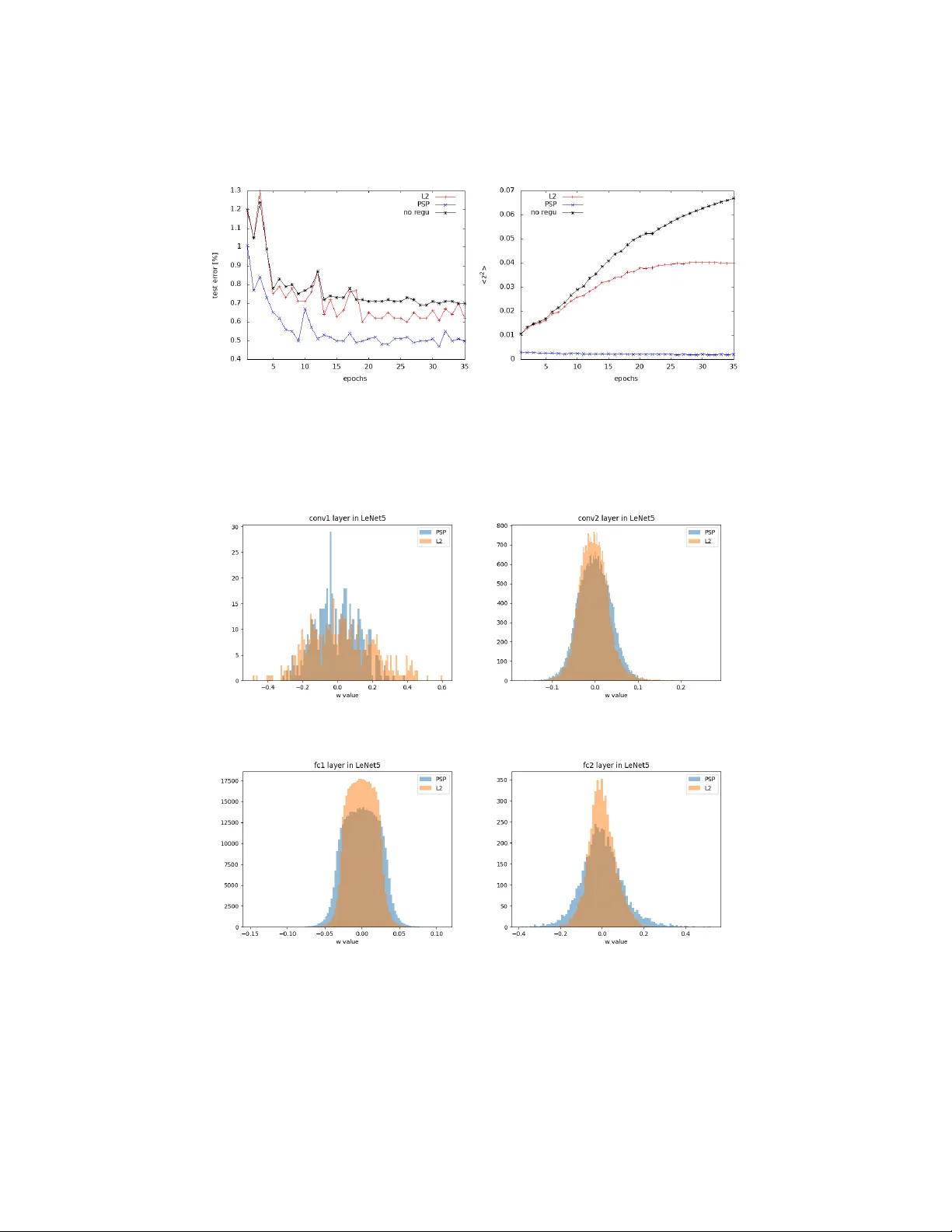

1. **MNIST (LeNet‑5)**

- 표준 SGD(정규화 없음) 오류 0.71%

- L2 정규화(λ=1e‑4) 오류 0.64%

- PSP(λ=1e‑3) 오류 0.50% (최고 0.46%)

- z² 평균값이 PSP에서 가장 낮게 유지되며, 학습 후에도 지속적으로 감소한다.

2. **CIFAR‑10**

- ResNet‑18: L2 대비 정확도 0.9% 향상

- MobileNet‑v2: L2 대비 정확도 1.1% 향상

- All‑CNN‑C: L2 대비 정확도 0.8% 향상

- 전위 제어(z²) 그래프는 PSP가 전체 네트워크에 걸쳐 전위값을 억제함을 보여준다.

3. **파라미터 분포**

- L2는 파라미터를 0 주변에 강하게 압축하지만, PSP는 파라미터 스케일을 크게 제한하지 않는다. 대신 전위값을 낮게 유지함으로써 모델 용량을 유지하면서 과적합을 방지한다.

### 논문의 의의와 한계

- **의의**: 정규화 항을 파라미터가 아닌 전위에 두어 전역적인 학습 안정성을 제공한다. 이는 기존 L2와는 다른 관점의 정규화이며, 특히 깊은 네트워크에서 뒤쪽 층의 정규화가 앞쪽 층까지 영향을 미치는 구조적 장점을 갖는다.

- **한계**: 실험이 이미지 분류에 국한되어 있으며, λ 선택에 대한 민감도 분석이 부족하다. 또한 전위 계산이 추가 연산을 요구하므로 매우 큰 모델에서는 약간의 계산 오버헤드가 발생할 수 있다.

### 향후 연구 방향

- 다양한 도메인(자연어 처리, 시계열, 강화학습 등)으로 확장 검증

- 자동 λ 튜닝 혹은 메타러닝과 결합하여 정규화 강도를 동적으로 조절

- 전위 정규화와 기존 정규화(드롭아웃, 배치 정규화 등)의 시너지 효과 탐색

- 이론적으로 “전위가 0에 가까워질 때의 미분값 최적화”가 일반화와 어떤 수학적 관계가 있는지 심층 분석

본 논문은 정규화 기법에 새로운 시각을 제공하며, 전위 기반 정규화가 실제 딥러닝 모델의 일반화 향상에 기여할 수 있음을 실험적으로 입증한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기