ECON: 정밀 노멀 맵 기반 3D 인간 복장 재구성

초록

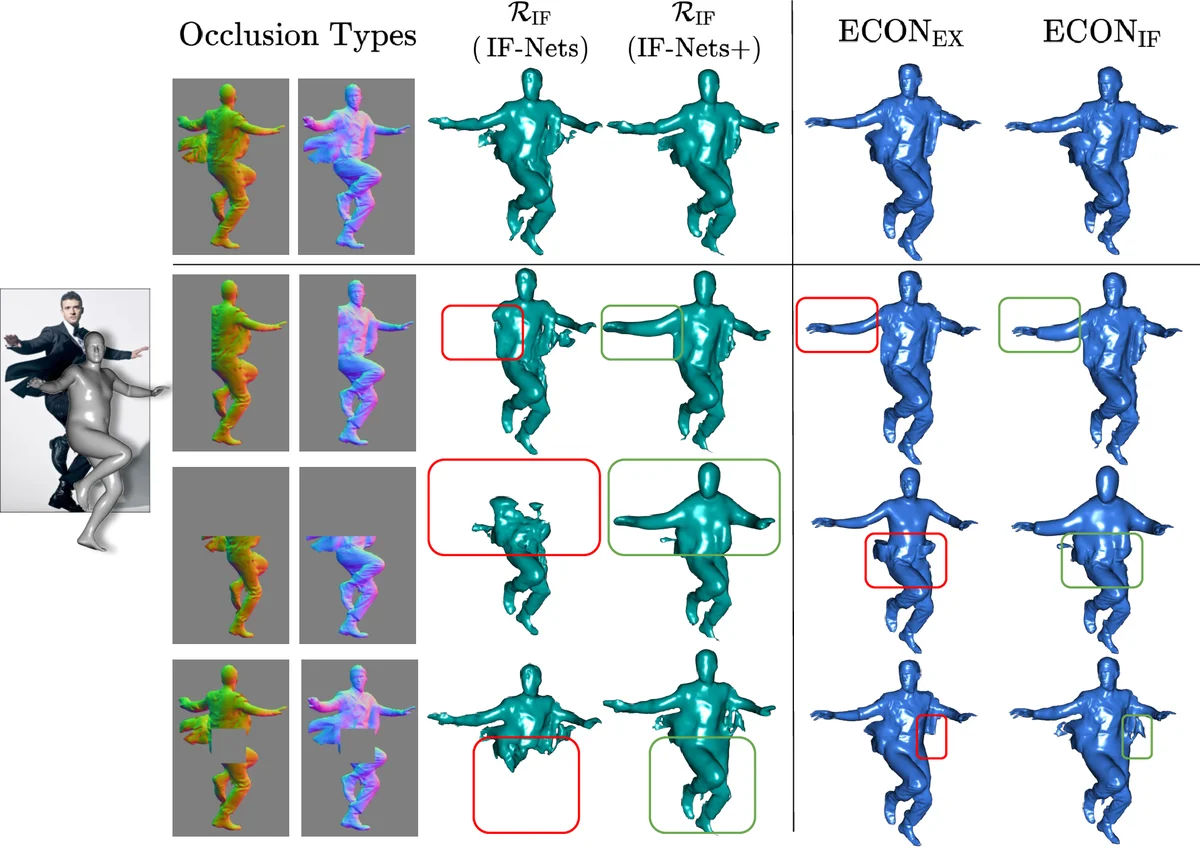

ECON은 이미지에서 고해상도 2D 노멀 맵을 추출하고, 이를 2.5D 전·후면 표면(d‑BiNI)으로 변환한 뒤 SMPL‑X 몸통 모델을 캔버스로 활용해 두 표면을 정합한다. 누락된 영역은 인페인팅으로 복원하여, 자유형 의복과 복잡한 포즈에서도 높은 사실성을 가진 3D 인간 모델을 생성한다. CAPE와 RenderPeople 데이터셋에서 정량·정성 평가가 기존 방법을 크게 앞선다.

상세 분석

본 논문은 3D 인간 복장 복원 분야에서 암시적 함수(Implicit Function)와 명시적 파라메트릭 모델(SMPL‑X)의 장점을 융합한 새로운 파이프라인을 제안한다. 기존 IF 기반 접근법은 자유형 지오메트리를 잘 표현하지만, 새로운 포즈나 넓은 옷감에 대해 불안정한 결과(예: 부착되지 않은 팔다리, 왜곡된 형태)를 보인다. 반면, SMPL‑X와 같은 명시적 모델은 몸통을 강력히 제약하지만, 옷이 몸통을 벗어나는 경우 세부 표현이 제한된다. ECON은 두 접근법의 한계를 보완하기 위해 세 가지 핵심 아이디어를 도입한다. 첫째, 현재 딥러닝 네트워크가 3D 전체를 직접 예측하기보다 2D 정밀 맵(특히 노멀 맵)을 추정하는 데 더 강력하다는 점을 활용한다. 이를 위해 이미지에서 전면과 후면 각각에 대한 고해상도 노멀 맵을 별도 네트워크로 예측한다. 둘째, 예측된 노멀 맵을 깊이와 결합해 2.5D 표면(d‑BiNI)을 복원한다. 이 표면은 전·후면 각각에 대해 높은 디테일을 유지하지만, 전체 몸통을 포괄하지 못하는 불완전성을 가진다. 셋째, SMPL‑X 모델을 “캔버스”로 사용해 전·후면 d‑BiNI를 정합한다. SMPL‑X는 이미지 기반 피팅을 통해 얻어지며, 전·후면 표면의 좌표계를 일치시키는 정합 매트릭스를 제공한다. 정합 후 남는 구멍이나 가려진 영역은 3D 인페인팅 네트워크를 통해 복원한다. 이 과정에서 얼굴·손이 노이즈가 심할 경우, SMPL‑X에서 제공하는 정제된 파트로 교체할 수 있다. 기술적으로는 (1) 노멀 맵 예측을 위한 U‑Net 기반 인코더‑디코더, (2) 노멀‑깊이 통합을 위한 다중 스케일 포인트 클라우드 재구성, (3) SMPL‑X 정합을 위한 비선형 최적화, (4) 3D 인페인팅을 위한 Voxel‑GAN 구조를 결합한다. 실험에서는 CAPE와 RenderPeople 데이터셋에서 정량적 지표(MAE, Chamfer Distance)와 사용자 설문을 통해 기존 IF‑only, SMPL‑only, 그리고 최신 혼합 방식보다 현저히 높은 정확도와 시각적 리얼리즘을 입증한다. 특히, 느슨한 옷감(스커트, 망토)이나 극단적인 포즈에서도 손실 없는 디테일 복원이 가능함을 보여준다. 이와 같이 ECON은 2D 정밀 예측과 3D 구조 정합을 효율적으로 결합함으로써, 자유형 복장과 복잡한 포즈를 동시에 다룰 수 있는 새로운 패러다임을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기