QubitHD: 확률적 이진화로 HD 컴퓨팅 가속

초록

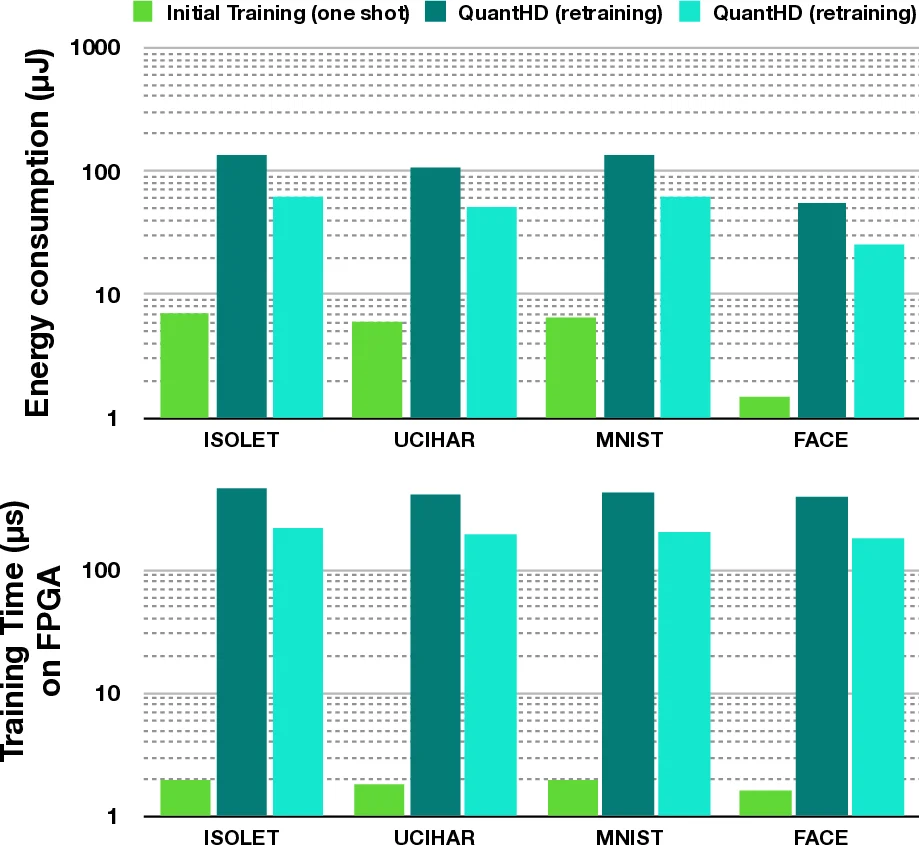

QubitHD는 고차원(HD) 컴퓨팅 기반 머신러닝에서 기존의 이진화 방식이 초래하는 정확도 손실을 최소화하면서 에너지 효율과 학습 속도를 크게 향상시키는 새로운 알고리즘이다. 확률적 이진화 함수를 도입해 비이진 모델의 기대값을 유지하고, FPGA 구현을 통해 기존 HD 모델 대비 학습 시간 95 % 단축·에너지 효율 65 % 개선을 달성하였다.

상세 분석

본 논문은 뇌 영감을 받은 고차원(HD) 컴퓨팅이 에너지 효율적인 경량 학습에 적합하지만, 실용적인 정확도를 확보하려면 부동소수점 혹은 정수형 표현이 필요하다는 기존 한계를 지적한다. 이를 해결하기 위해 저자들은 양자 비트의 측정 과정을 모방한 ‘확률적 이진화(stochastic binarization)’ 기법을 제안한다. 기존 QuantHD가 단순히 부호만을 기준으로 이진화하는 반면, QubitHD는 임계값 b를 기준으로 |x|≤b 구간에서 x/b 비율에 따라 +1 또는 -1로 확률적으로 선택한다. 이 방식은 이진화된 값의 기대값이 원래 실수값과 일치하도록 설계돼, 비이진 모델과 거의 동일한 표현력을 유지한다. 또한, 이진화 후에는 코사인 유사도 대신 해밍 거리 계산을 사용해 연산 복잡도를 크게 낮춘다. 알고리즘은 인코딩 → 초기 학습 → 확률적 이진화 → 재학습의 네 단계로 구성되며, 재학습 과정에서 학습률 α와 랜덤성 도입으로 지역 최소점에 빠지는 현상을 완화한다. FPGA 구현에서는 비트 연산 중심의 파이프라인을 활용해 전력 소모를 최소화하고, 이진화 단계에서 추가적인 연산 자원을 거의 요구하지 않는다. 실험 결과, 다양한 데이터셋(인간 활동, 얼굴, 텍스트)에서 QubitHD는 비이진 HD 모델 대비 정확도 격차를 평균 38.8 % 감소시켰으며, 학습 수렴 시간을 30‑50 % 단축했다. 에너지 효율은 기존 HD 모델 대비 평균 56배, 속도는 8배 향상됐으며, BNN·MLP와 비교했을 때도 학습·추론 속도가 50배 이상 빠르면서 정확도는 동등 수준을 유지한다. 이러한 결과는 확률적 이진화가 HD 컴퓨팅의 에너지·성능 트레이드오프를 근본적으로 개선할 수 있음을 보여준다.

댓글 및 학술 토론

Loading comments...

의견 남기기